openclaw + ollama本地模型(不消耗token) + 飞书部署教程

本文详细介绍了在Windows和Mac系统上本地部署Ollama大语言模型的完整流程。主要内容包括:1)Ollama的下载安装与验证;2)常用模型推荐及运行方法;3)API调用与网络配置;4)通过WSL2安装OpenClaw实现飞书机器人对接;5)日常使用与维护指南。文章提供了针对不同电脑配置的模型选择建议,详细说明了安装过程中可能遇到的问题及解决方案,并给出了推荐的技能扩展方案。该教程帮助用户快

可能有些图片加载不出来,详细的访问公众号搜木子恩观看

废话不多说直接步入正题!!!

windows,mac为例,云端部署私信发教程

一、ollama本地模型安装

1、下载 Ollama

打开官网:

https://ollama.com/

点击 Download

选择:

-

Windows

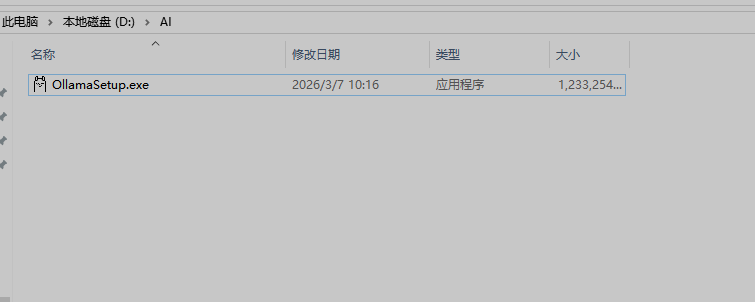

下载后会得到安装包:

2、安装

双击安装:

OllamaSetup.exe安装流程非常简单:

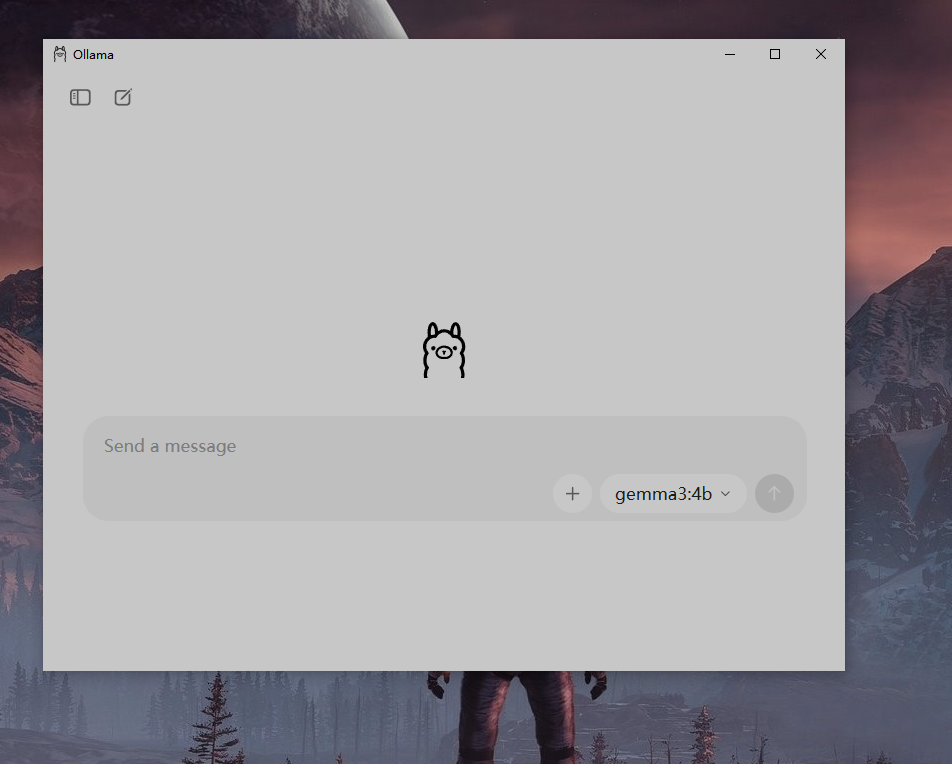

Next → Install → Finish安装后出现窗口

安装完成后 Ollama会自动启动服务。

默认运行端口:

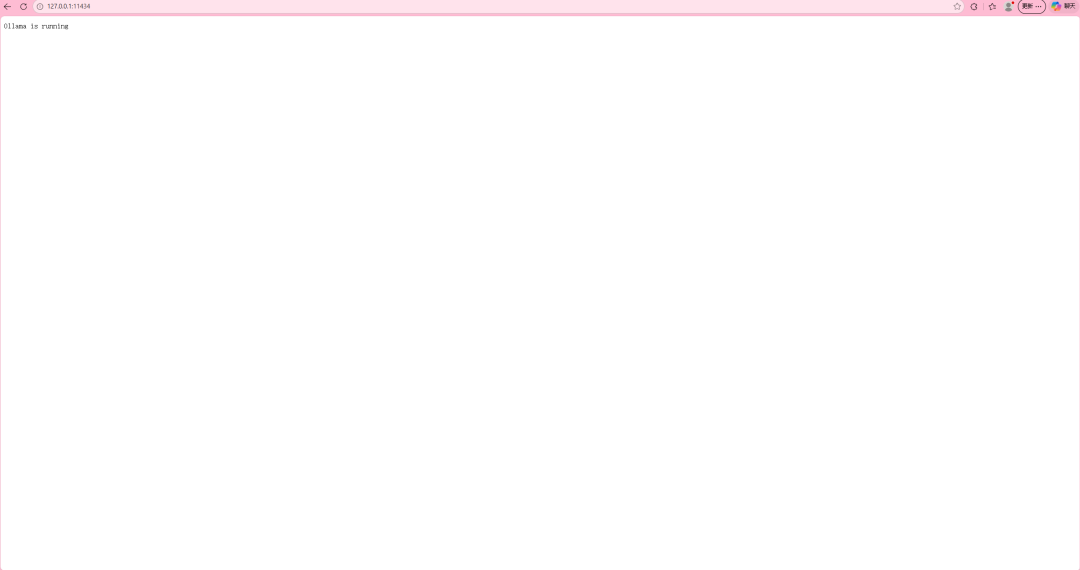

http://localhost:114343、验证是否安装成功

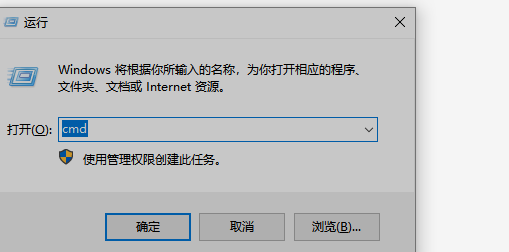

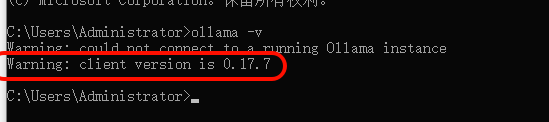

打开 CMD 或 PowerShell(快捷键win+r输入cmd然后回车)

输入:

ollama -v

这就已经成功了

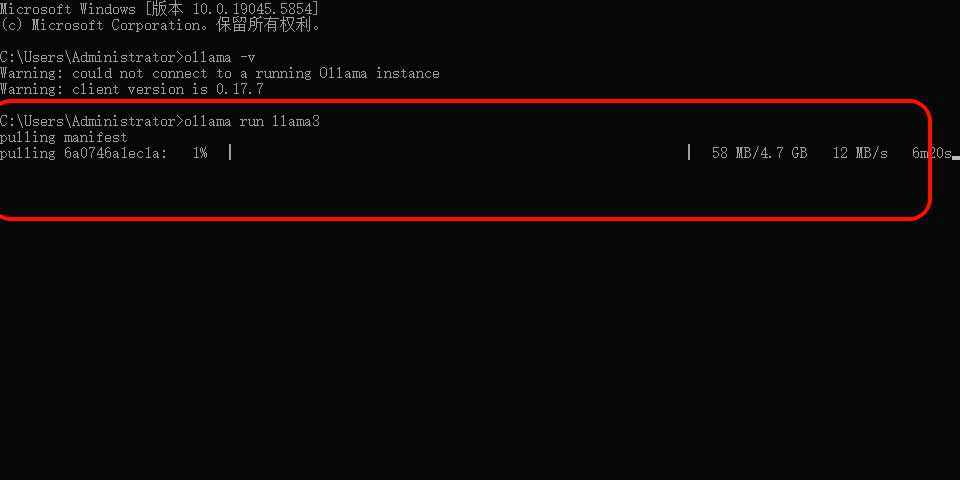

4、运行第一个大模型

推荐第一个运行(先跑通然后为大家推荐怎么配置最合适):

-

LLaMA 3

命令:

ollama run llama3

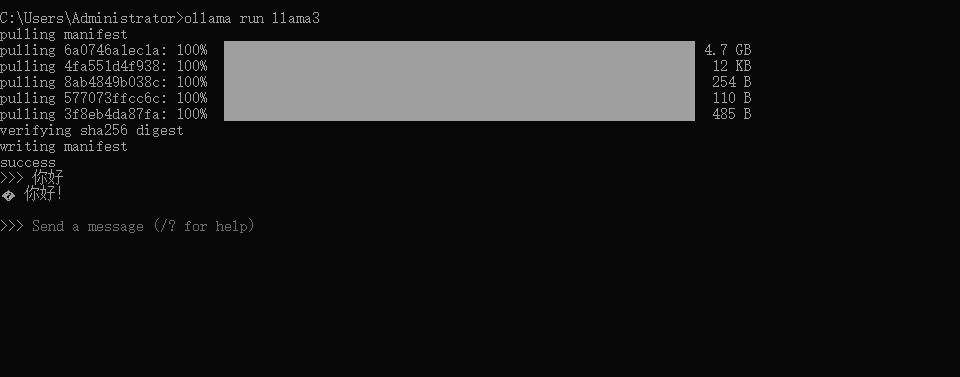

第一次运行会:

自动下载模型自动加载模型

模型大小大概:

4GB-5GB之间下载完成后就能聊天:

>>> hello输入 /bye 退出对话

5、常用模型推荐(需要根据不同使用自行配置不懂得可以咨询我,给你最优推荐)

可以运行这些模型:

聊天模型

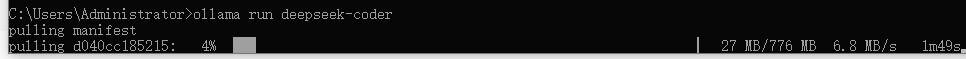

ollama run llama3ollama run qwen2编程模型

ollama run deepseek-coder或者

ollama run qwen2.5-coder

推理模型

ollama run deepseek-r1

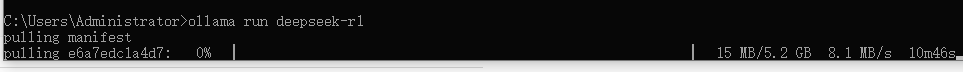

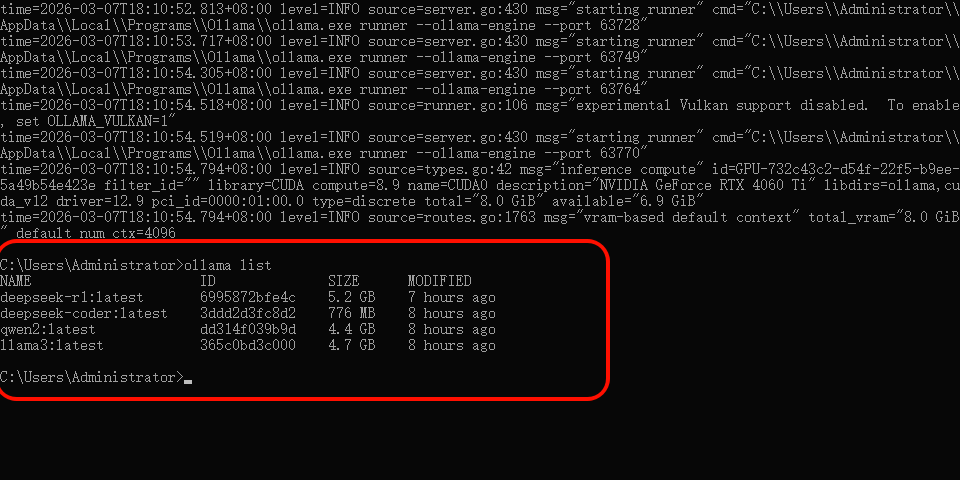

6、查看已安装模型

ollama list

7、删除模型

ollama rm llama38、Ollama API(开发使用)

Ollama自带 API:

http://localhost:11434/api/generate例如:

curl http://localhost:11434/api/generate端口和监听地址都是可以修改的主要有 3 种方式

修改监听地址

Ollama通过环境变量控制:OLLAMA_HOST例如改成:0.0.0.0:8080Windows CMD:set OLLAMA_HOST=0.0.0.0:8080ollama serve访问地址就变成:http://localhost:8080/api/generate

局域网设备访问你的 Ollama

设置:set OLLAMA_HOST=0.0.0.0:11434ollama serve然后用你的电脑 IP 访问:http://192.168.1.xx:11434/api/generate手机或其他电脑也能调用。

反向代理(生产环境推荐)

如果你做 AI应用 / Web服务,一般不会直接暴露11434。而是用:NginxCaddy代理。例如:https://ai.example.com代理到:http://localhost:11434Nginx示例:location /api/ {proxy_pass http://127.0.0.1:11434;}

注意:API路径不能改

/api/generate/api/chat/api/tags

这些 API路径是固定的,不能修改。

只能改:

-

host

-

port

-

域名代理

很多开发框架可以直接接入,例如:

-

LangChain

-

LlamaIndex

9、推荐模型

如果你电脑配置一般:

推荐:

llama3:8bqwen2.5:7bphi3

需要内存:

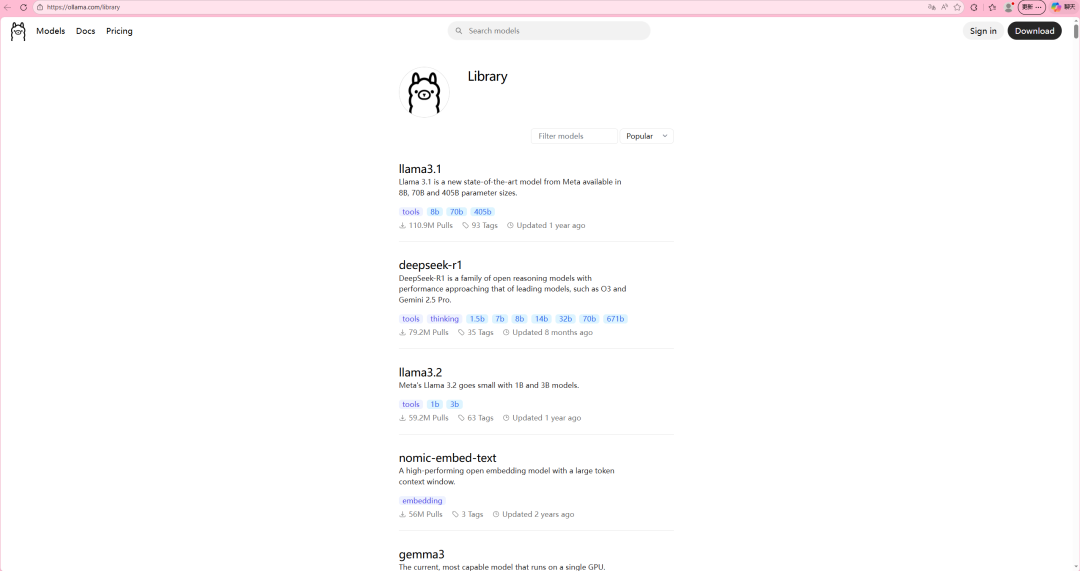

8GB - 16GB10、Ollama 模型库

所有模型:

https://ollama.com/library

里面有:

-

聊天模型

-

编程模型

-

多模态模型

-

embedding模型

现在就可以本地跑 ChatGPT 类模型了

下面给大家一个Ollama模型推荐 + 电脑配置对照表

先看电脑配置,再选模型。因为模型越大,对 内存 / 显存 / 硬盘要求越高

第一梯队(需要 服务器或多GPU)

|

模型 |

参数规模 |

特点 |

|---|---|---|

|

DeepSeek-R1 |

600B+ MoE |

推理能力最强 |

|

Qwen3 |

235B |

多语言能力强 |

|

GLM-5 |

400B |

推理 + 编程强 |

|

Llama 3.3 |

70B |

通用能力强 |

这些模型在 benchmark 上接近或达到顶级闭源模型水平。

但 普通电脑基本跑不了。

第二梯队(适合 4090 / Mac Studio / AI服务器。)

|

模型 |

参数 |

用途 |

|---|---|---|

|

Qwen2.5 32B |

32B |

中文最强 |

|

DeepSeek-R1 32B |

32B |

推理 |

|

Mixtral 8x7B |

56B MoE |

综合能力 |

|

Llama 3 70B |

70B |

通用聊天 |

开发者常用

第三梯队(普通电脑最佳,适合 16GB 内存电脑)

|

模型 |

参数 |

能力 |

|---|---|---|

|

Llama3 8B |

8B |

最均衡 |

|

Mistral 7B |

7B |

速度快 |

|

Gemma 2 / 3 |

9B |

写作 |

|

Phi-3 Mini |

3B |

轻量 |

Llama3 8B 在本地模型中最流行,可在 8-16GB RAM 上运行并达到接近GPT-4的水平

电脑配置 vs 模型推荐

|

电脑配置 |

推荐模型 |

能力 |

|---|---|---|

|

4GB RAM |

Phi-3 / Qwen 0.6B |

简单问答 |

|

8GB RAM |

Mistral 7B |

GPT3级 |

|

16GB RAM |

Llama3 8B / Gemma 9B |

GPT4 |

|

32GB RAM |

Qwen2.5 14B |

GPT3.5+ |

|

64GB RAM |

Qwen2.5 32B |

GPT4 early |

|

GPU 24GB |

DeepSeek-R1 32B |

GPT4 |

|

多GPU |

Llama3 70B |

GPT4+ |

显存越大,可以运行的模型越大

不同用途最佳模型

本地 ChatGPT

llama3qwen2.5gemma3

AI编程助手

deepseek-coderqwen2.5-codercode-llama

AI Agent / 推理

deepseek-r1qwqqwen3

RAG知识库

nomic-embed-textbge-large

推荐的 Ollama 模型组合

开发者常用组合:

聊天:qwen2.5推理:deepseek-r1代码:deepseek-coder向量:nomic-embed

这套可以做:

-

本地GPT

-

AI Agent

-

私有知识库

-

AI编程助手

如果有更高的电脑配置还不懂怎么配置私信我发配置给你最佳配置

二、openclaw安装

注意:

windows版本采用WSL 2安装

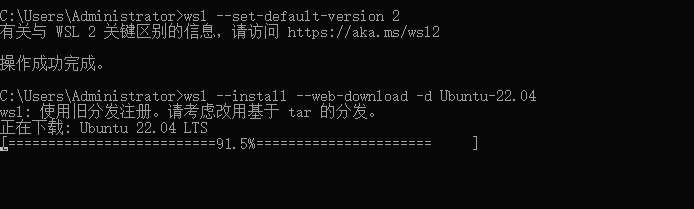

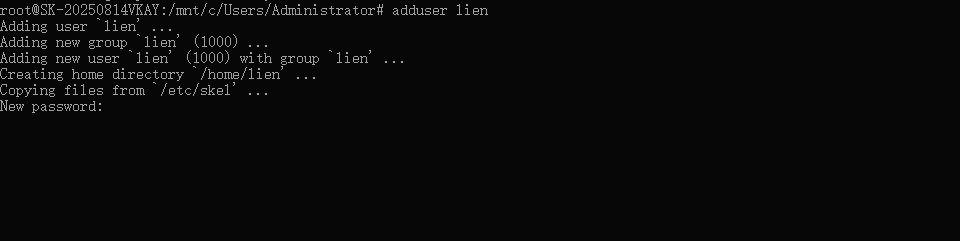

WSL 2安装步骤

wsl --install然后重启电脑

再次打开shell执行

wsl--set-default-version2wsl--install--web-download-dUbuntu-22.04wsl-l-v

依次执行

如果卡住的话建议关闭重新打开执行

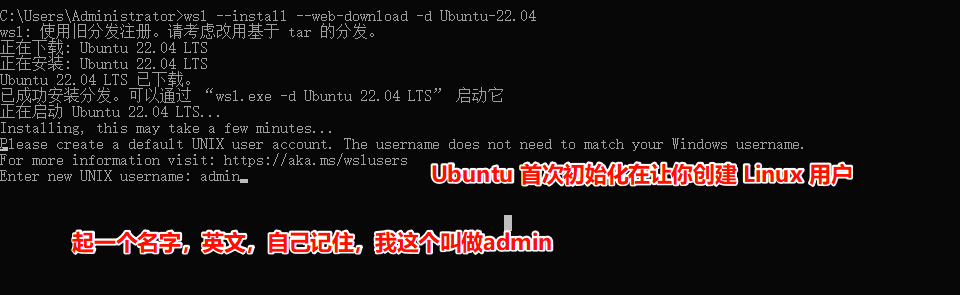

wsl -d Ubuntu-22.04默认用户补充执行

输密码时屏幕不显示字符

后面如果出现这些信息:

Full Name []:Room Number []:Work Phone []:Home Phone []:Other []:

都可以直接一路按回车跳过。最后输入:

Y

确认创建。

给这个用户 sudo 权限

继续执行:

usermod -aG sudo lienlien是我自己起的名字要换成你们自己的

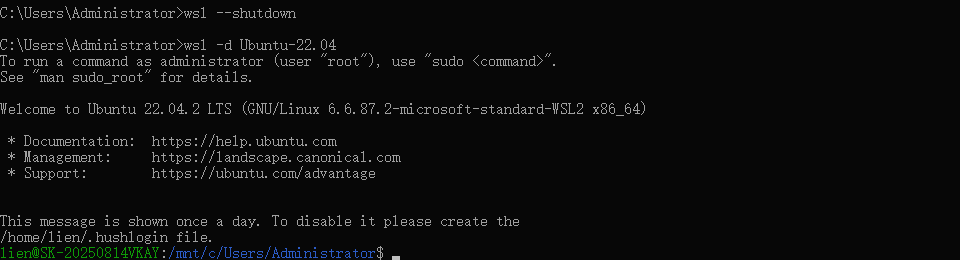

设置它为默认登录用户

执行:

printf "[user]\ndefault=lien\n" > /etc/wsl.conf

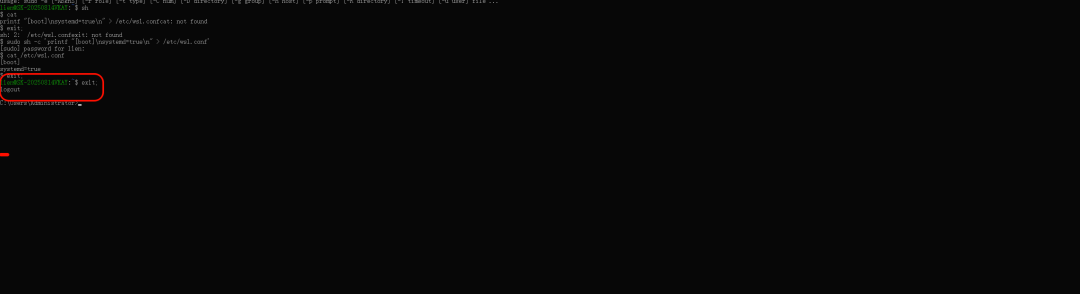

退出并重启 WSL

先退出 Ubuntu:

exit

然后回到 Windows PowerShell,执行:

wsl --shutdown

和

wsl -d Ubuntu-22.04

如果正常,你应该会看到类似:

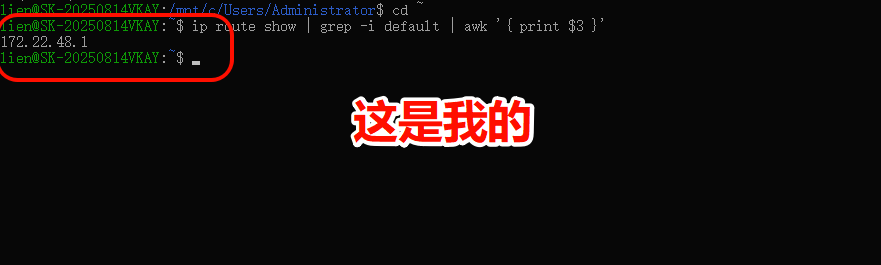

lien@SK-20250814VKAY:~$

这就说明普通用户配置好了。

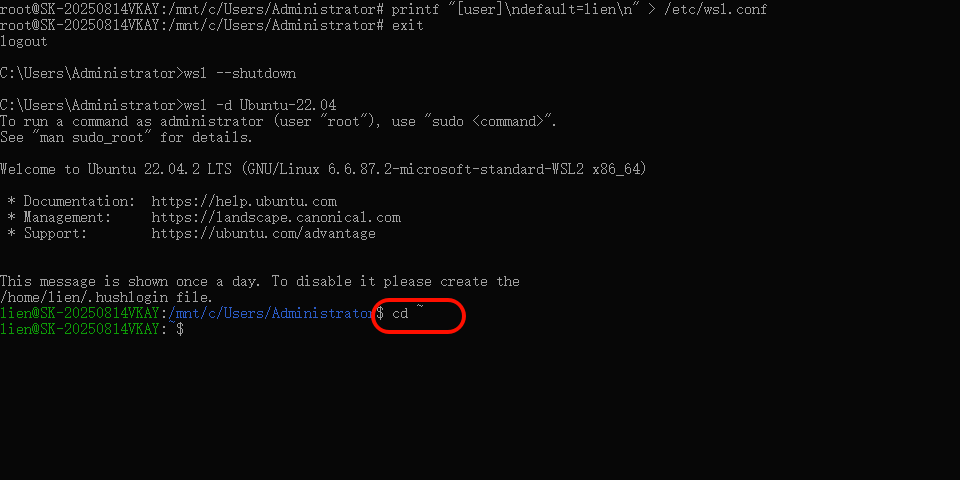

接下来直接安装 OpenClaw。

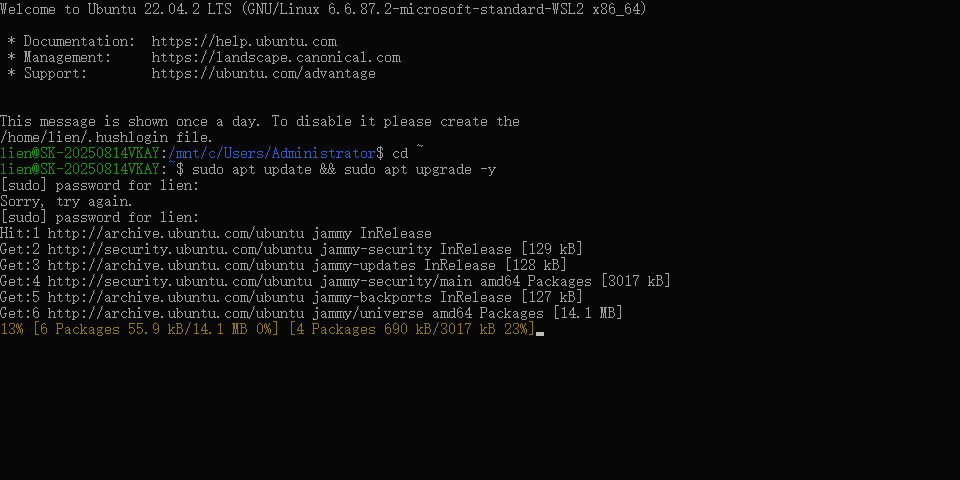

先执行这组:

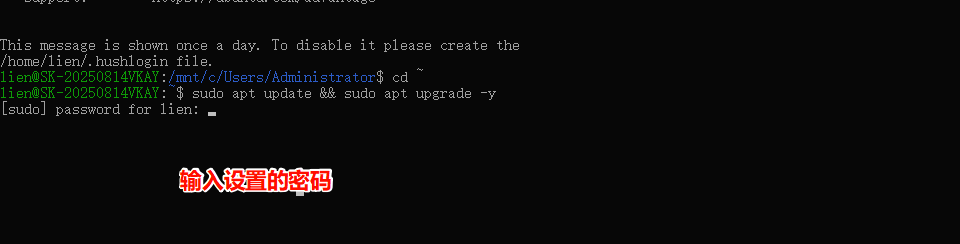

一定先要先执行这个

cd ~

sudo apt update && sudo apt upgrade -y

密码不会显示的,输入后直接回车就行了(过程有点慢一定要等执行完)

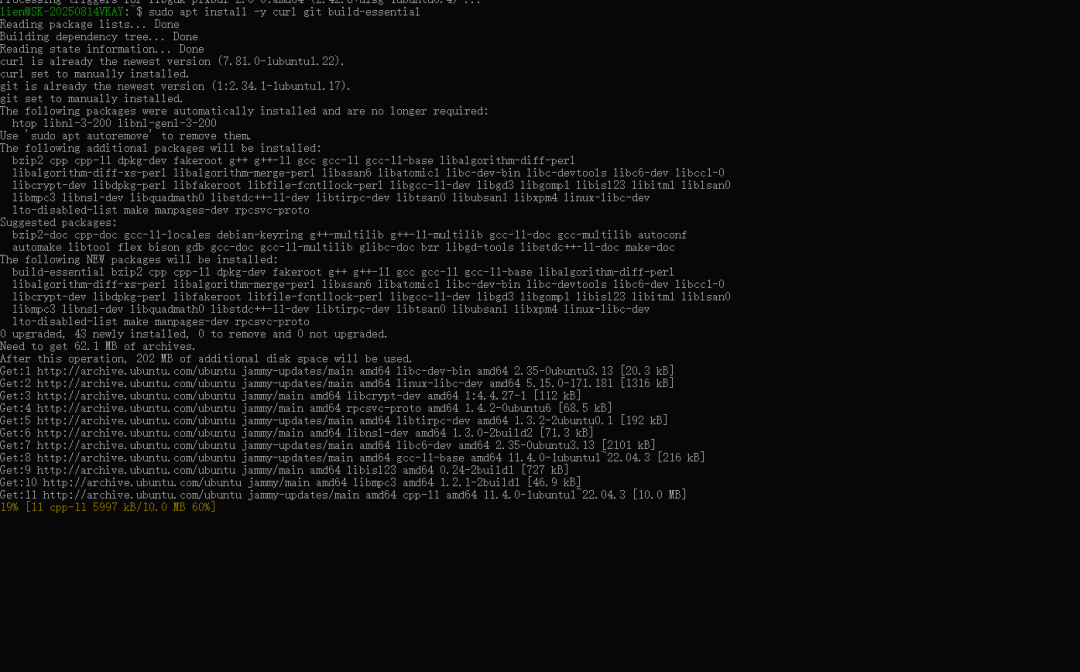

sudo apt install -y curl git build-essential (等待执行完毕)

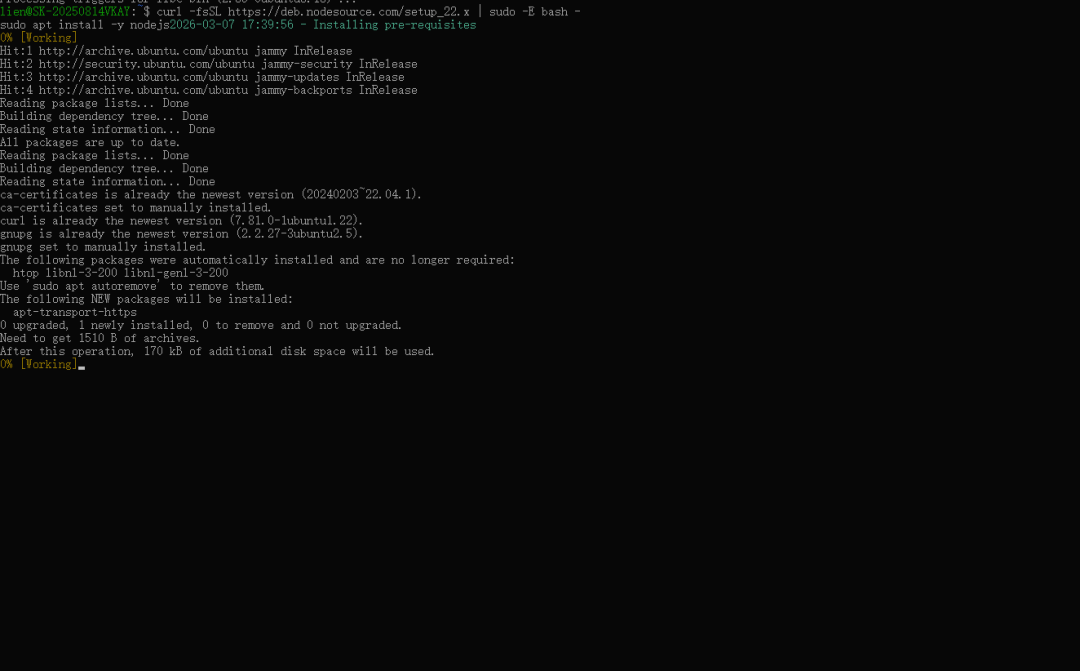

curl -fsSL https://deb.nodesource.com/setup_22.x | sudo -E bash - sudo apt install -y nodejs

(上面命令一次性复制粘贴执行)

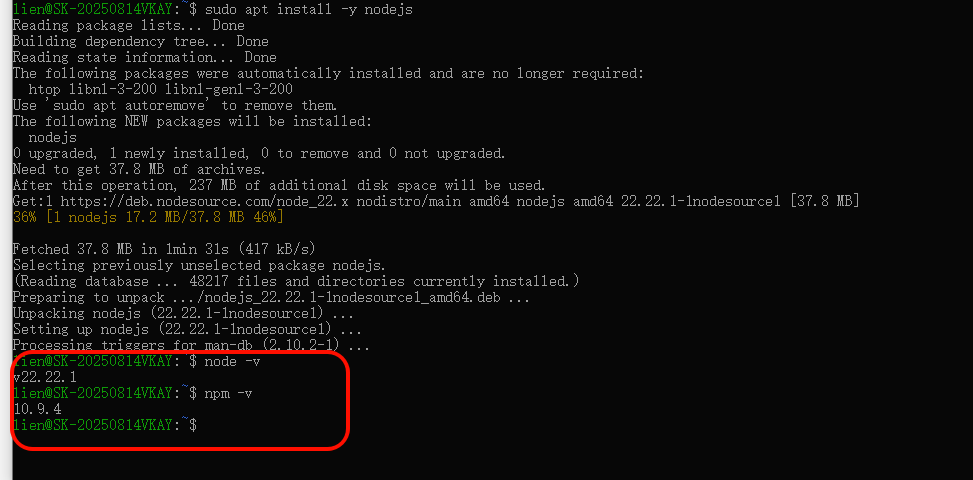

依次执行:

node -v

npm -v

确认 node -v 是 v22.x.x 之后,再执行:

npm install -g openclaw@latest

如果 npm install -g 提示权限问题,就改用:

sudo npm install -g openclaw@latest

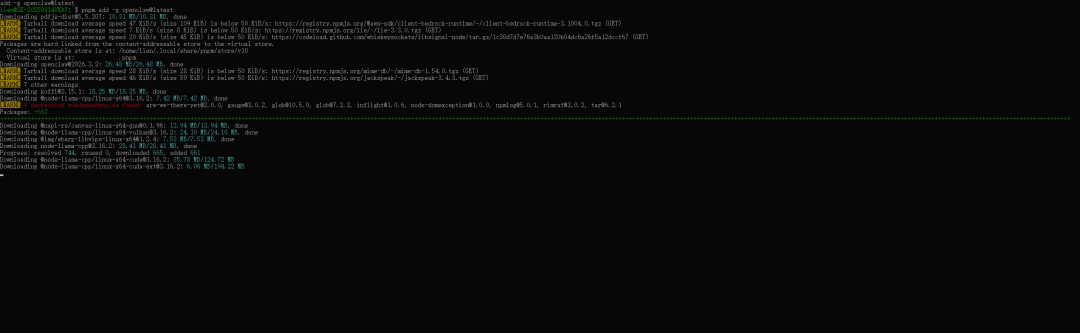

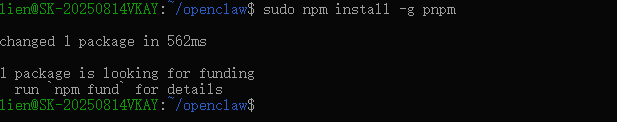

如果npm太慢就改用pnpm

在 Ubuntu 里执行:

pnpm setup

它执行完后,再执行:

source ~/.bashrc

然后检查:

pnpm bin -gecho$PATH

再安装 OpenClaw:

pnpm add -g openclaw@latest

装完再试:

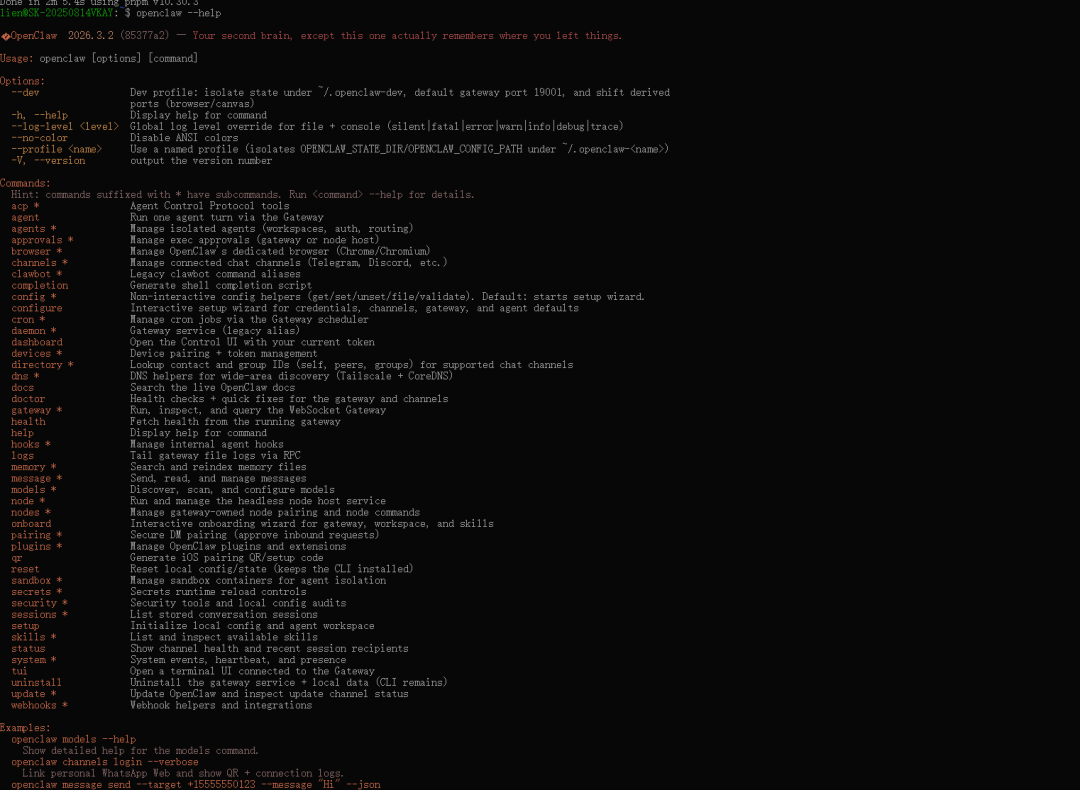

openclaw --help

openclaw --help

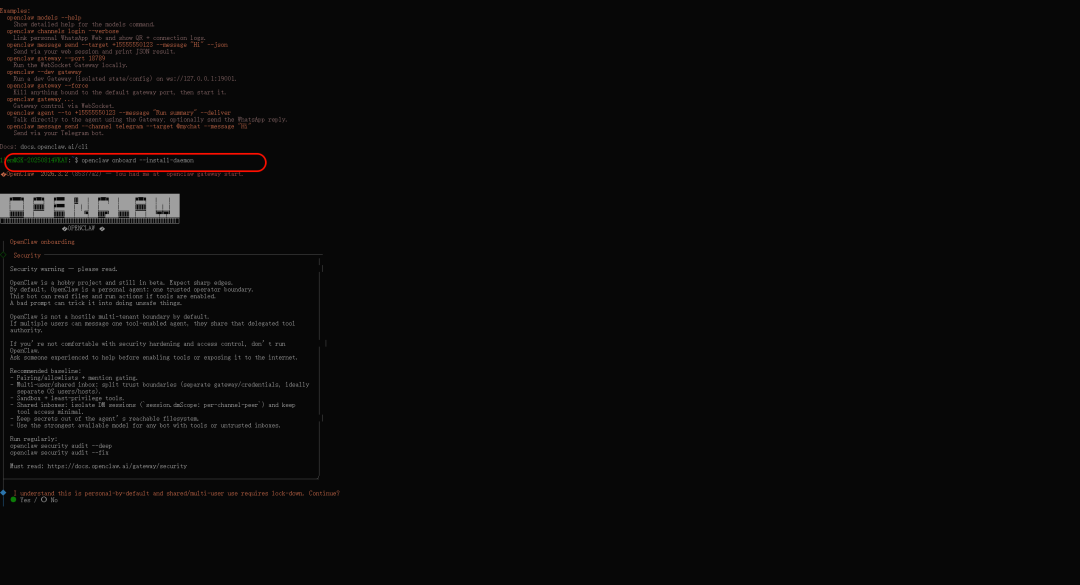

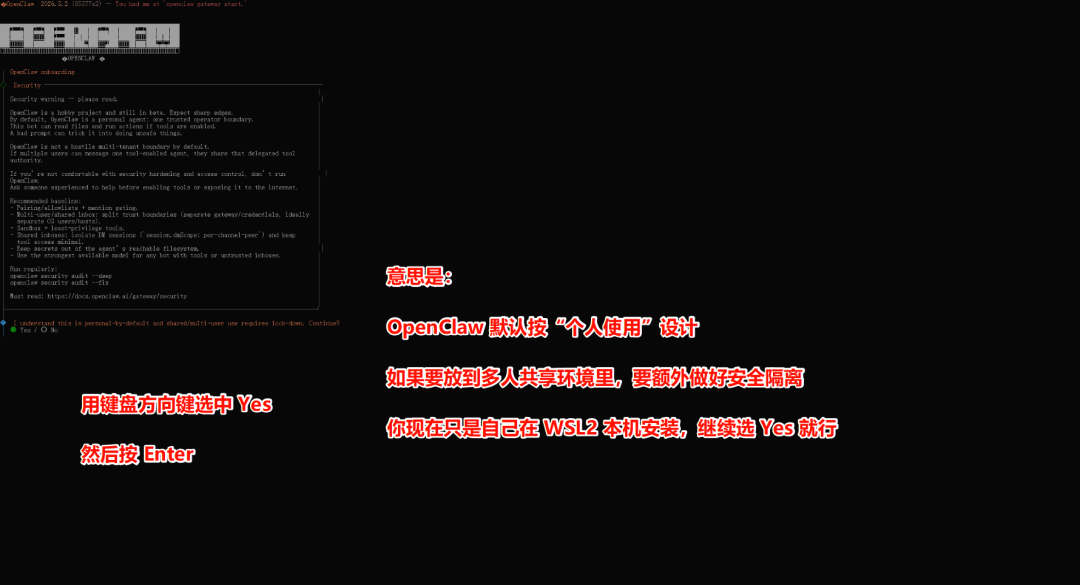

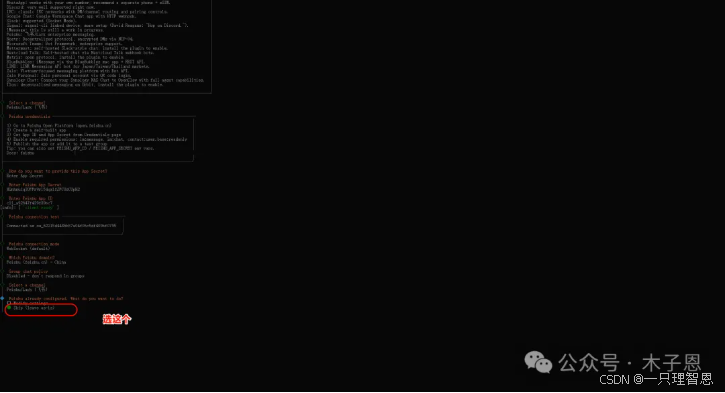

openclaw onboard --install-daemon

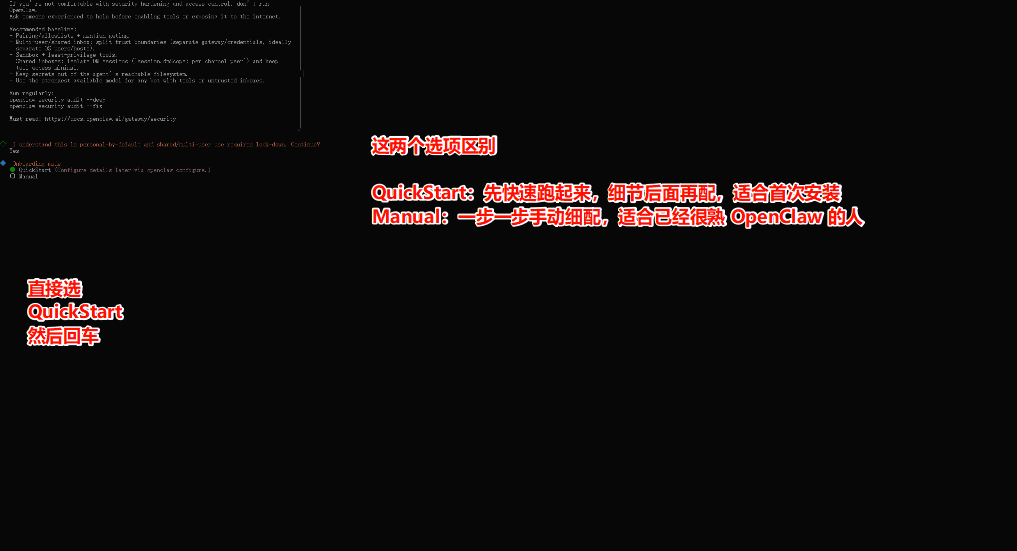

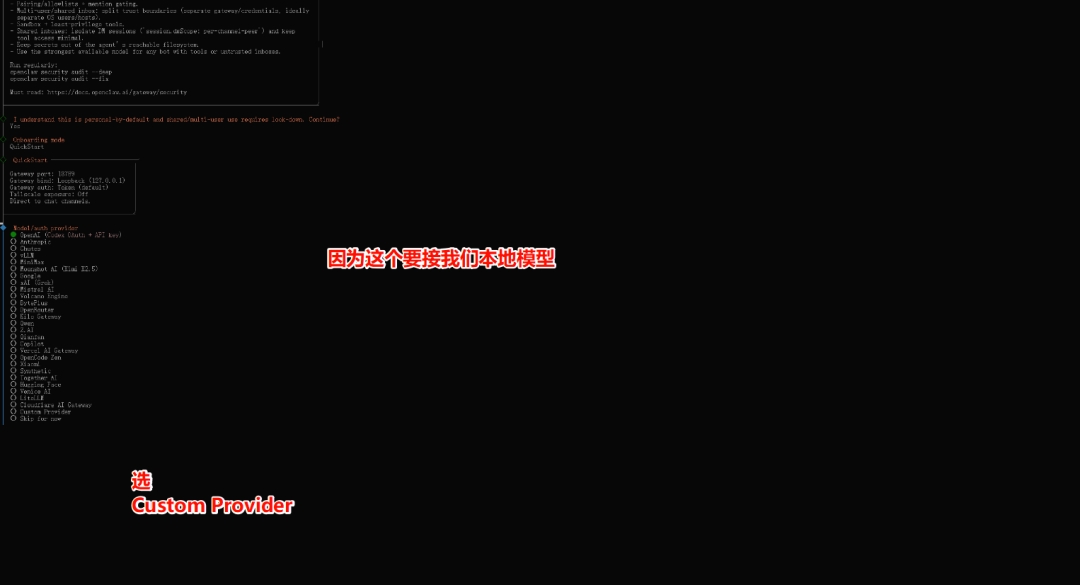

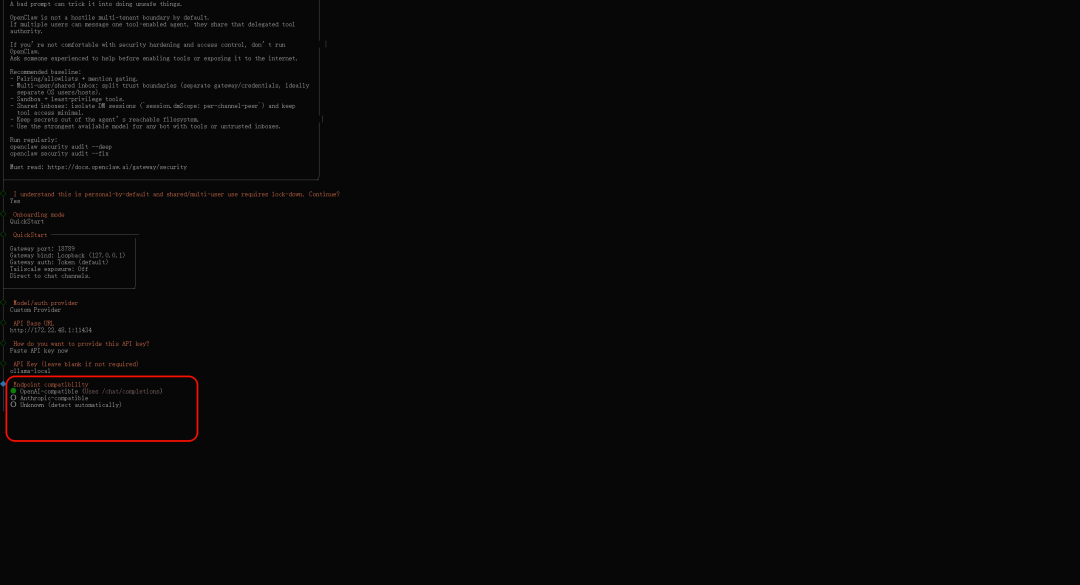

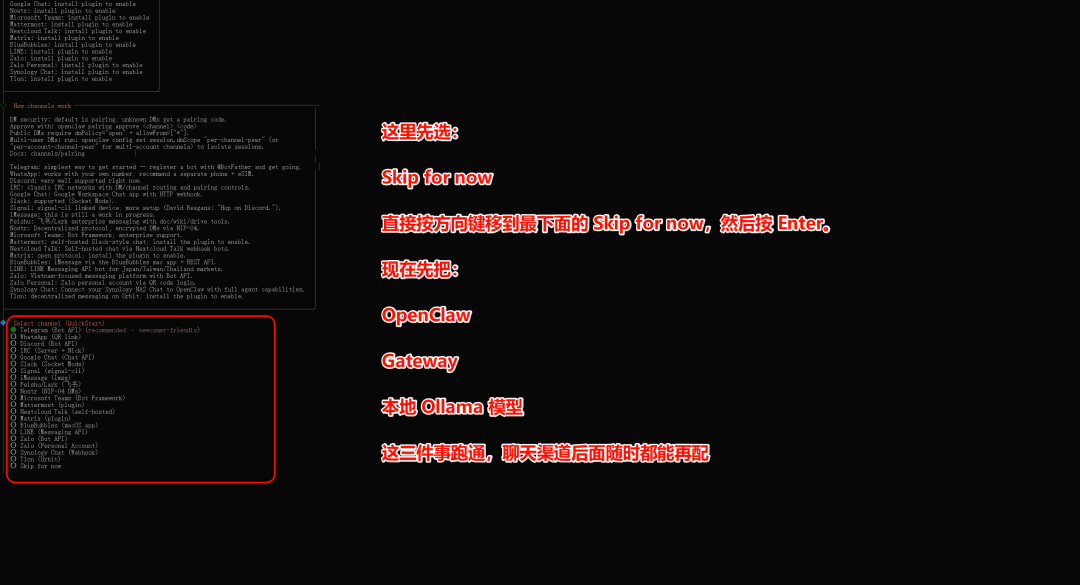

选择后会这样

不要着急动,先挨个执行

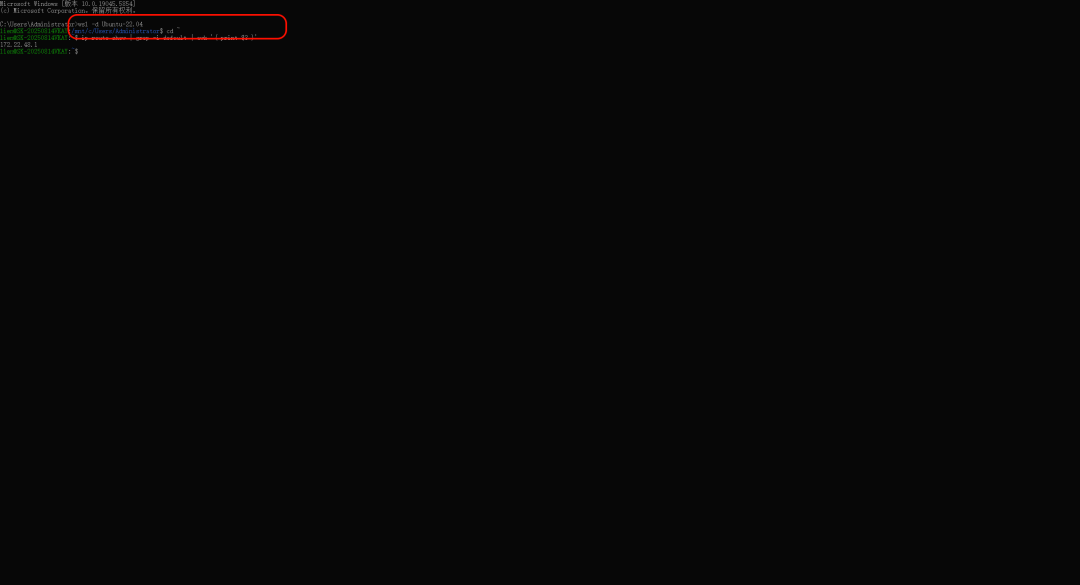

wsl -d Ubuntu-22.04

cd ~

然后执行

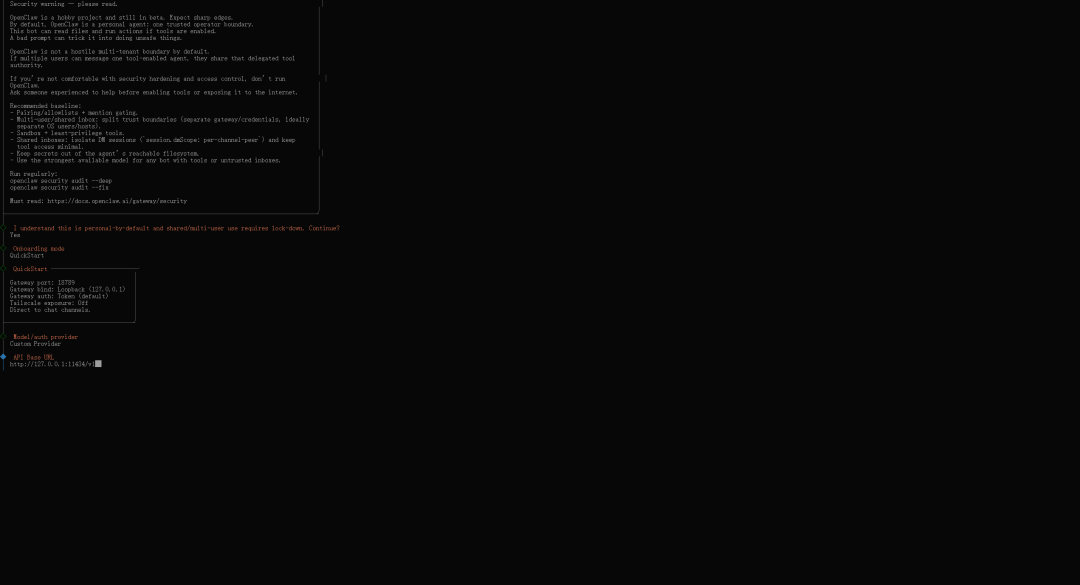

ip route show | grep -i default | awk '{ print $3 }'

获取自己ip

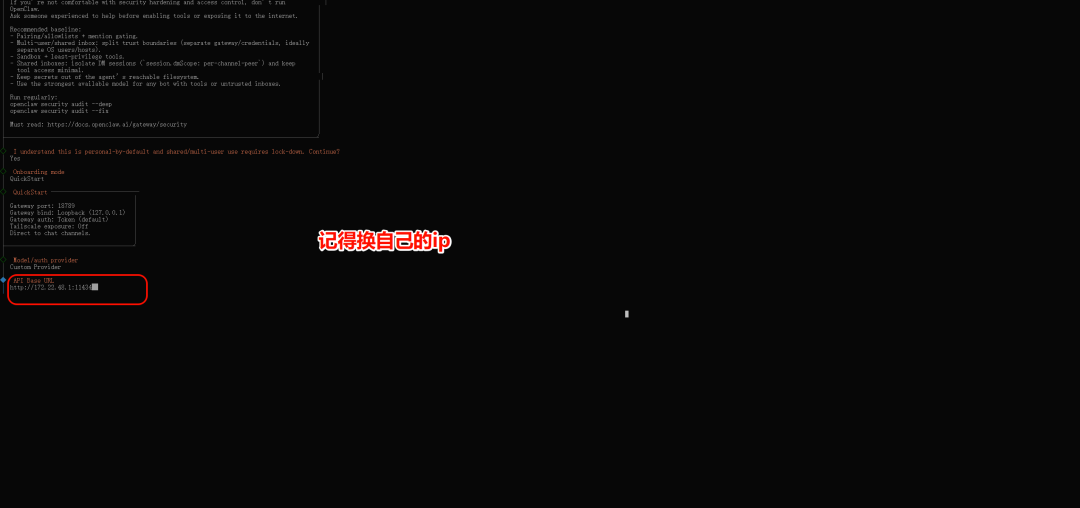

填地址

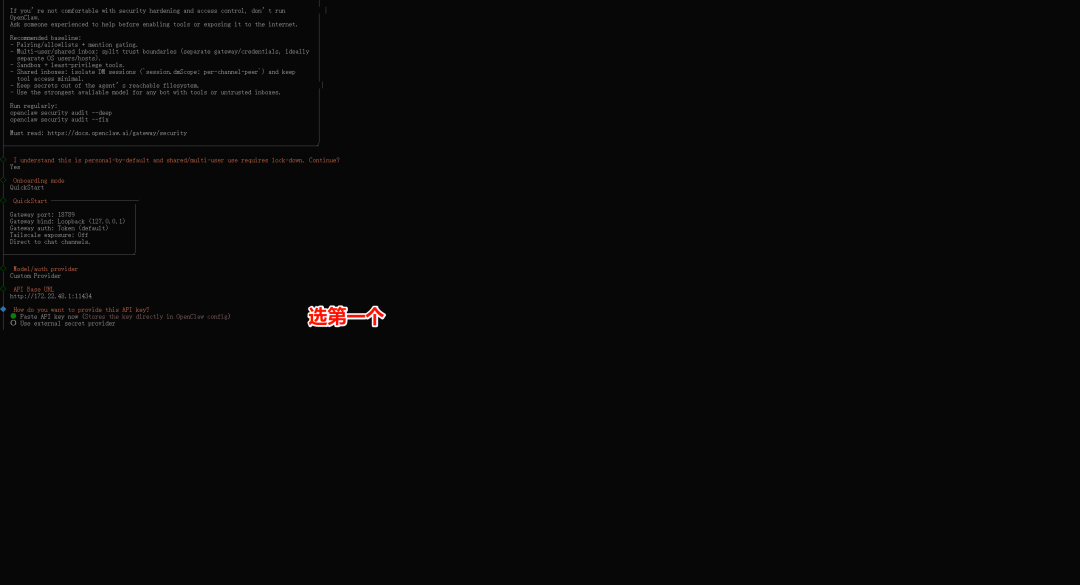

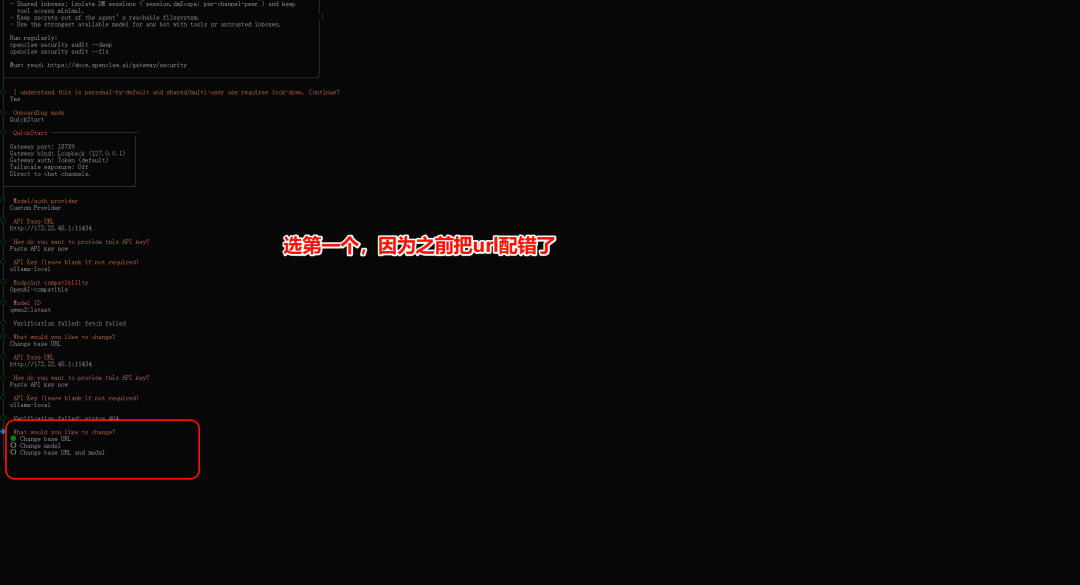

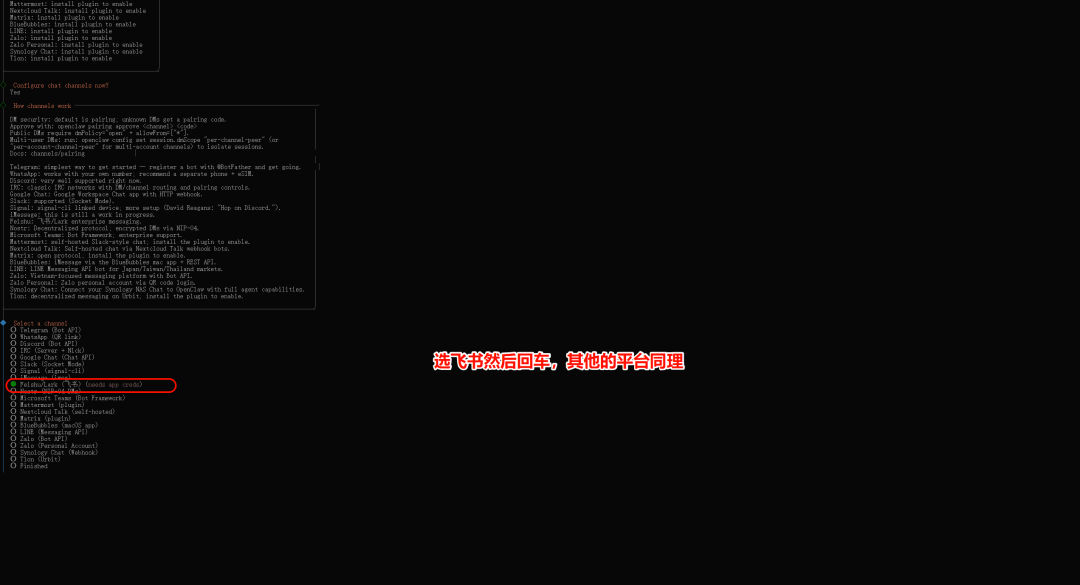

这里选第一个:

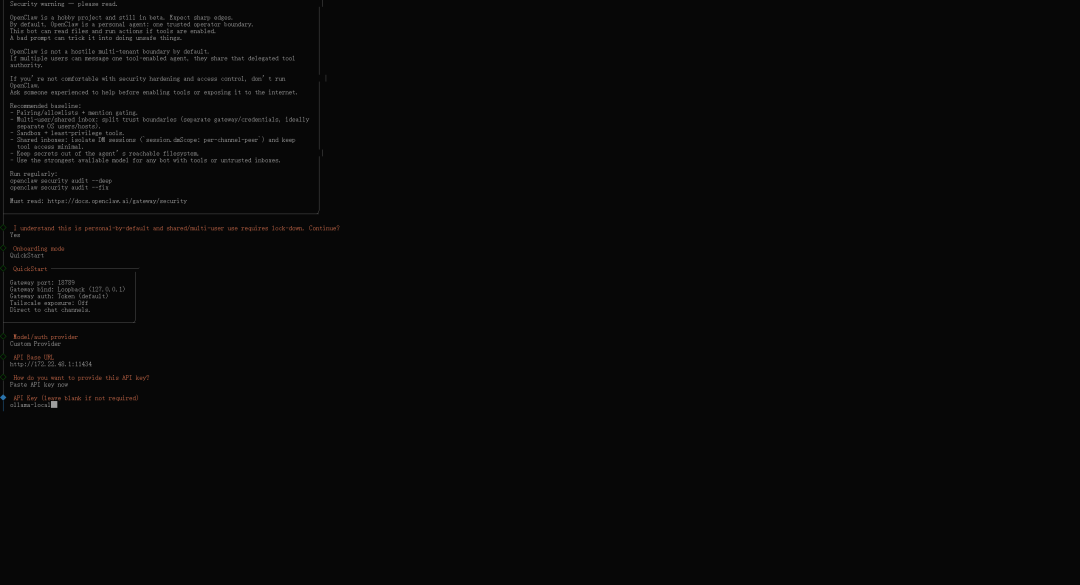

Paste API key now

直接按 Enter。

下一步如果让你输入 API key,就填:

ollama-local

这只是本地 Ollama 的占位值,不是真实云厂商密钥

这里选:

OpenAI-compatible

保持当前选中,直接按 Enter。

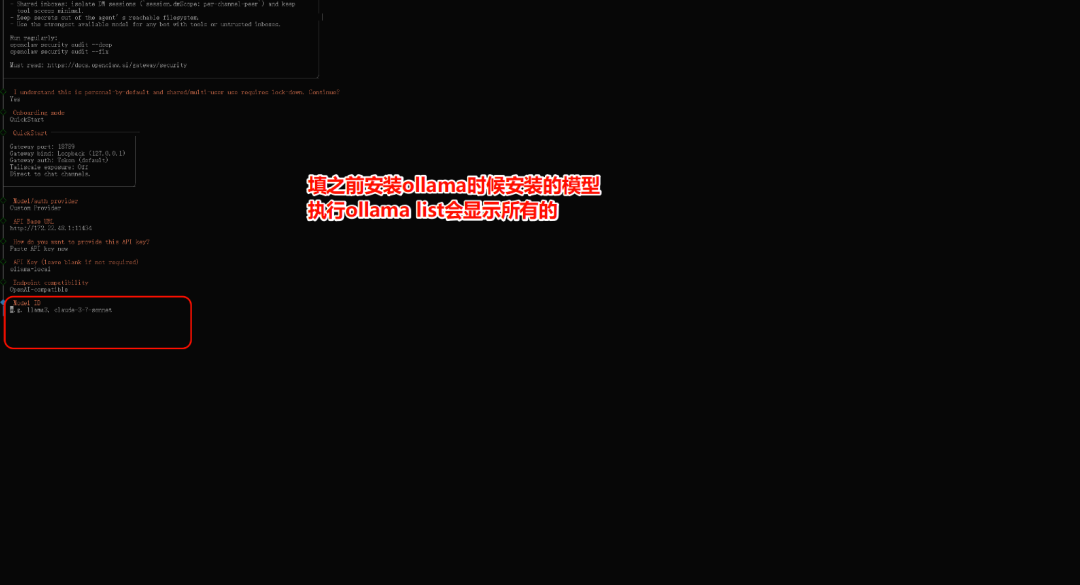

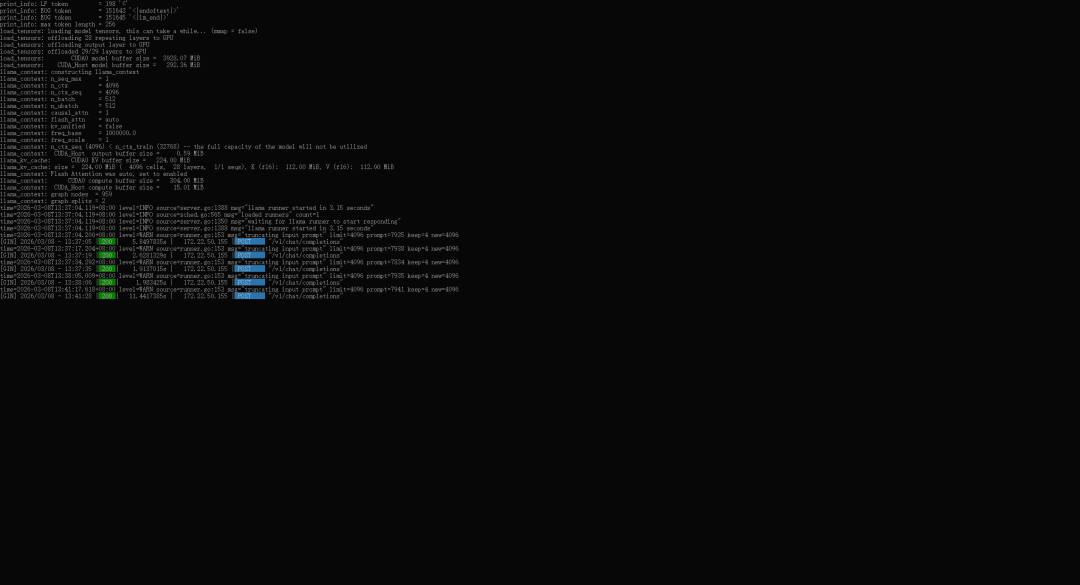

这是安装allama的时候演示安装的

我演示的时候选择的是

qwen2:latest

所以在 Model ID 那里输入:

qwen2:latest

然后按 Enter。

根据自己的安装情况填写

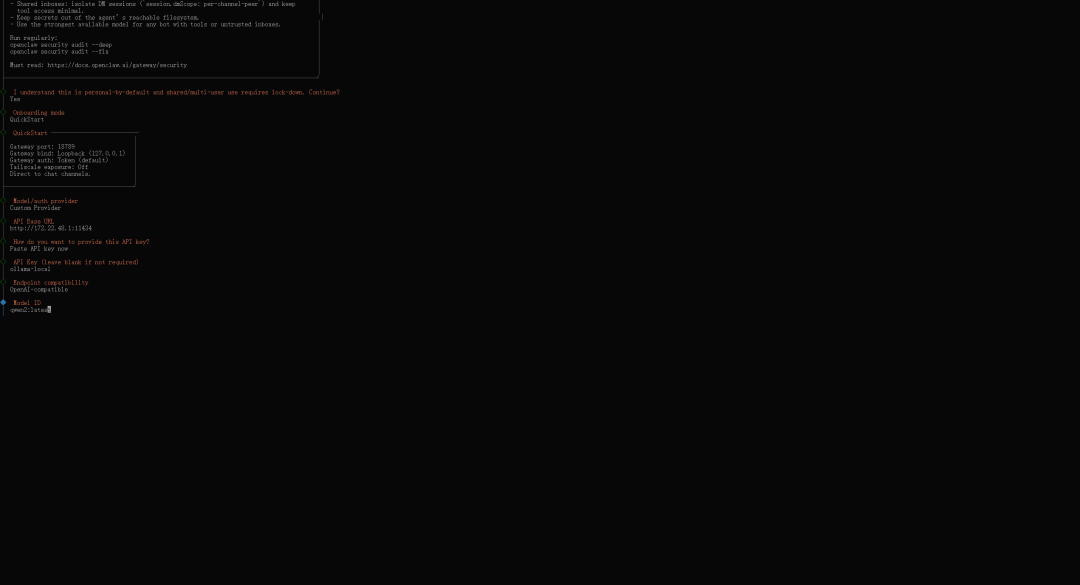

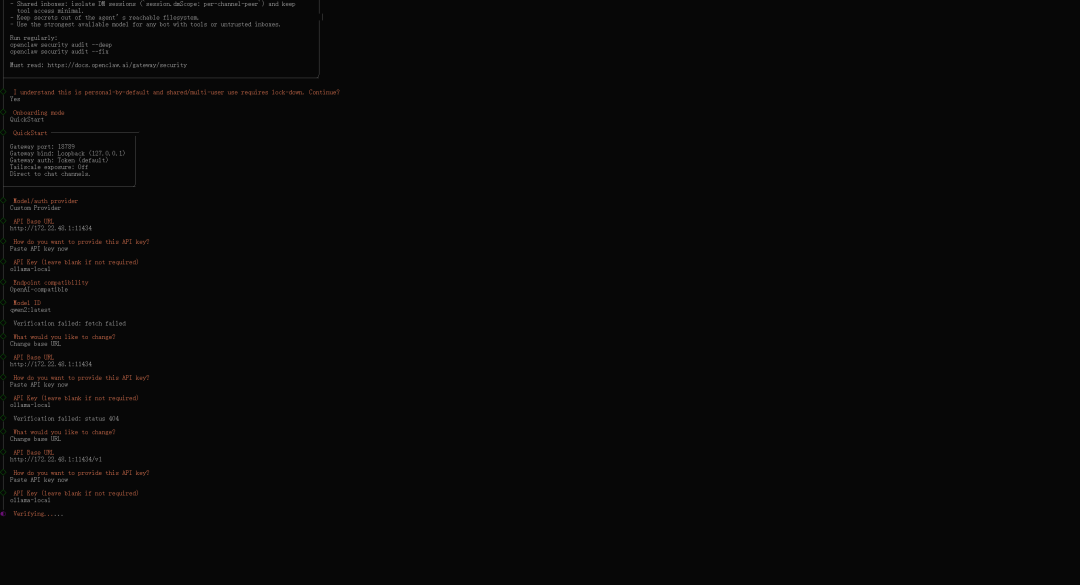

在 OpenClaw 当前这一步,选:

Change base URL

然后把现在的:

http://172.22.48.1:11434

改成:

http://172.22.48.1:11434/v1

然后后面保持:

-

API Key:

ollama-local

已经成功了

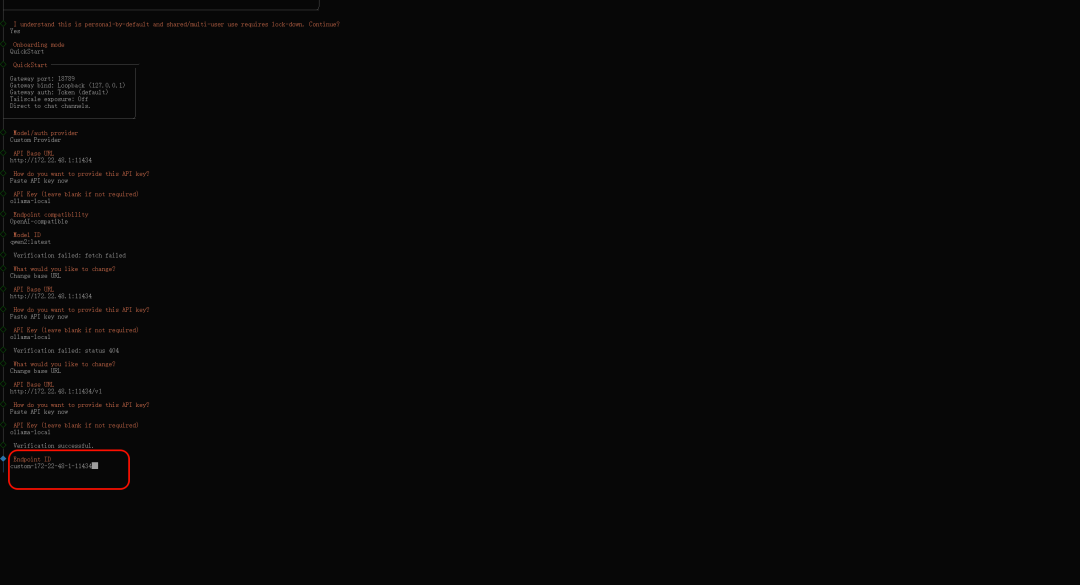

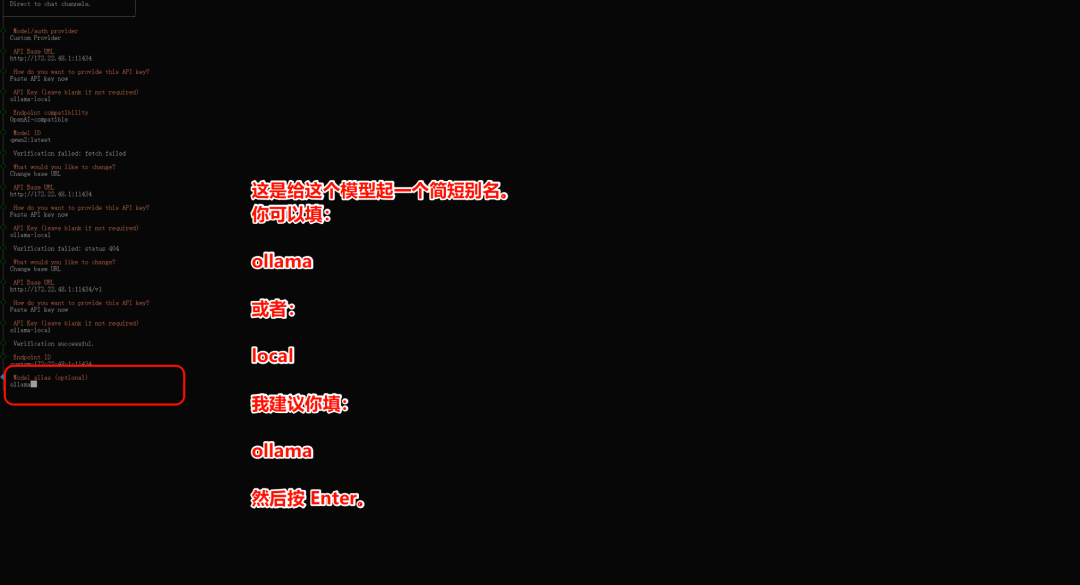

现在这个

Endpoint IDcustom-172-22-48-1-11434

你直接按 Enter 就行,保持默认值。

这是 OpenClaw 给你这条模型连接配置起的一个名字,相当于:

-

这条连接的唯一标识

-

后面在配置里区分不同模型接口用的

-

你不用改也没问题

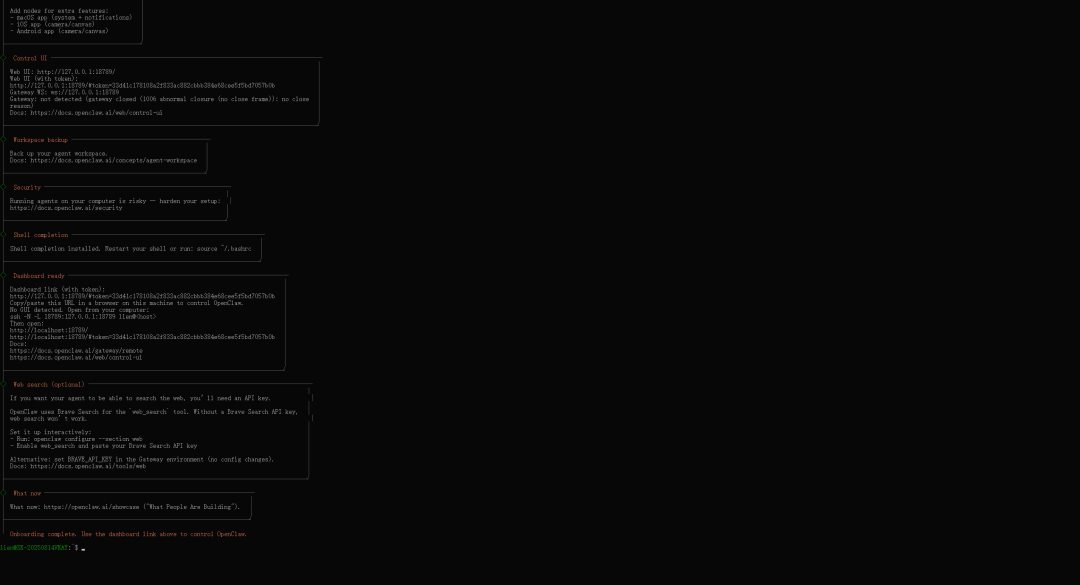

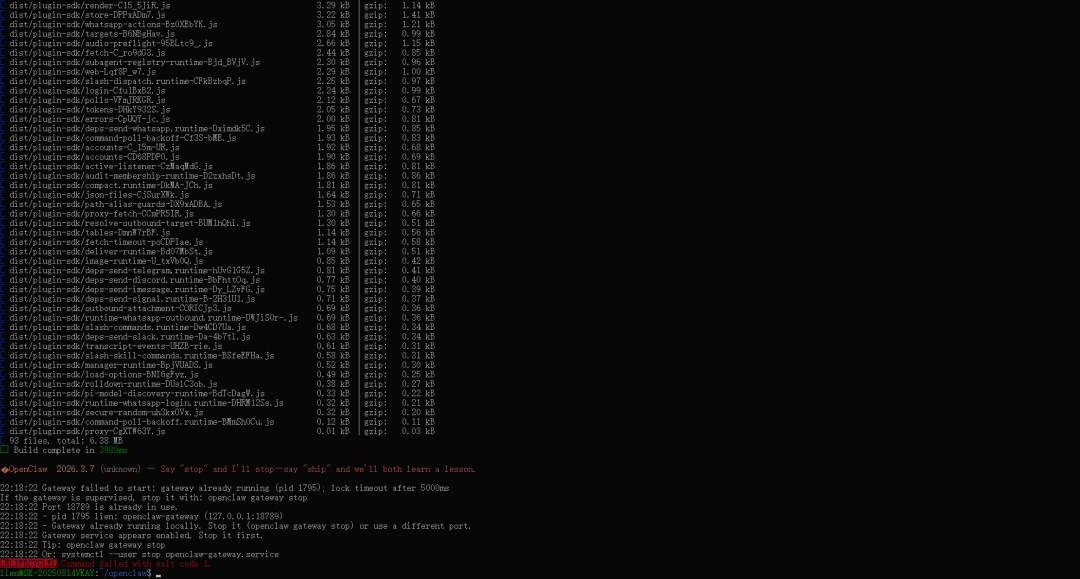

好了,已经装成功并完成初始化了。

图里几个关键信号都说明已经跑起来了:

-

Onboarding complete -

Dashboard ready -

有本地控制台地址:

-

http://localhost:18789/

-

-

已经生成 token

-

当前回到命令行提示符了

然后执行

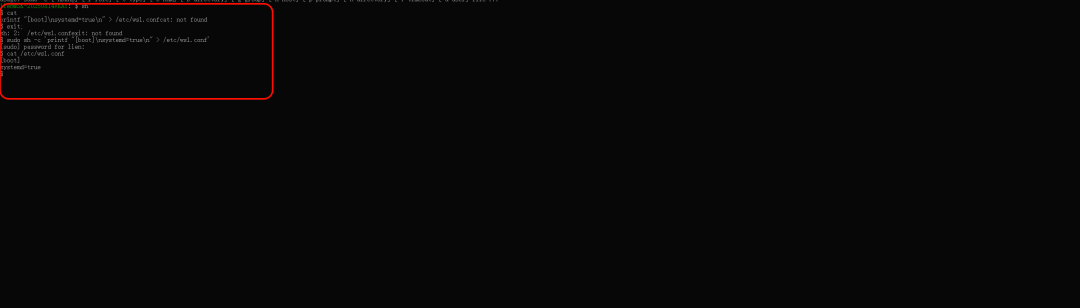

第一步:在 Ubuntu 里开启 systemd

执行:

sudo sh -c 'printf "[boot]\nsystemd=true\n" > /etc/wsl.conf'

然后检查文件

cat /etc/wsl.conf

正常应该看到:

[boot]systemd=true

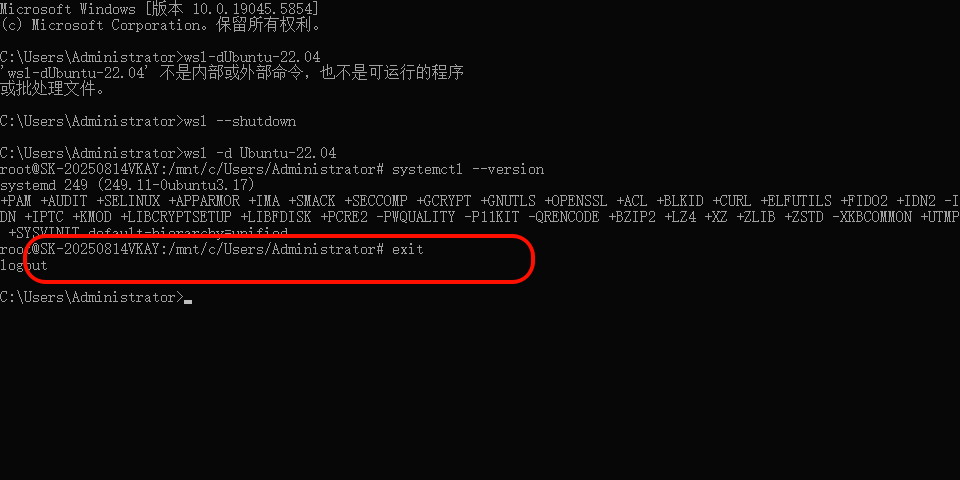

第二步:退出 Ubuntu

执行:

exit;

第三步:回到 Windows PowerShell,彻底重启 WSL

执行:

wsl--shutdown

然后重新进入 Ubuntu:

wsl -d Ubuntu-22.04

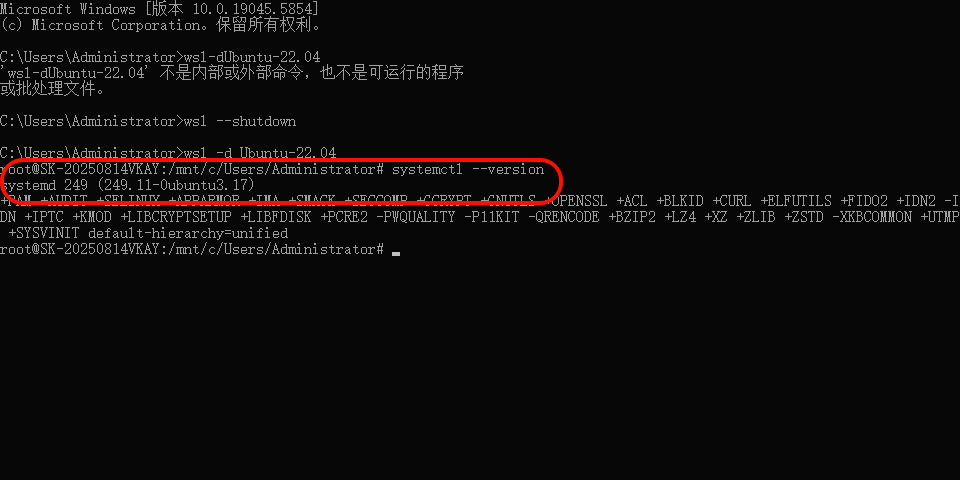

第四步:重新检查 systemd

进 Ubuntu 后执行:

systemctl --version

如果这里能正常显示版本信息,就说明 systemd 开好了。

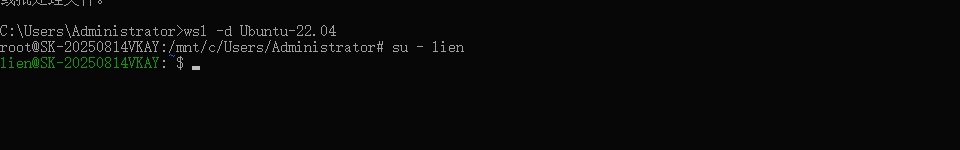

先退出 root

在当前 Ubuntu 里执行:

exit

如果退出后回到 Windows,再进 Ubuntu:

wsl -d Ubuntu-22.04

正常应该回到:

lien@SK-20250814VKAY:~$

如果进去后还是 root,就执行:

su - lien

如果提示密码,就输入你之前给 lien (自己设置的名字)设置的那个 Linux 密码。

注意:lien是因为默认用户起的名字是lien,实际中用你们自己的

进去普通用户后,执行命令测试是否可用:

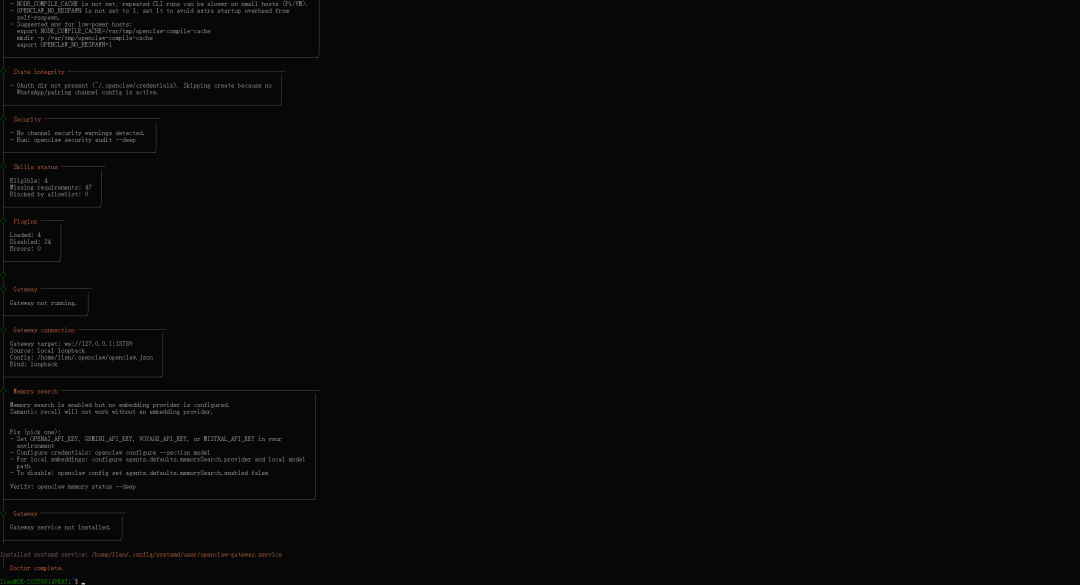

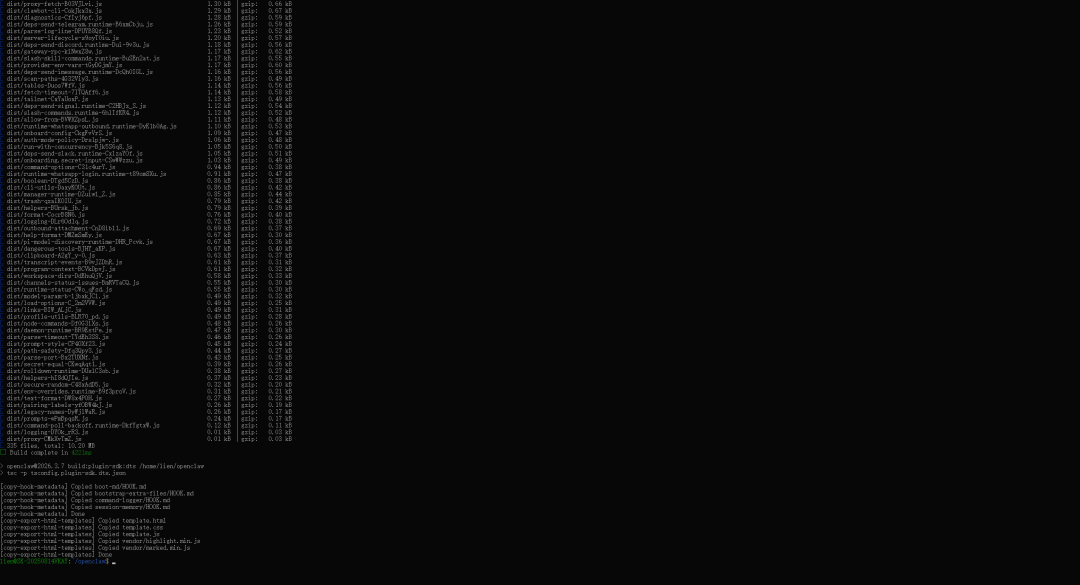

openclaw doctor --repair等待一段时间后出现如下情况说明正常的

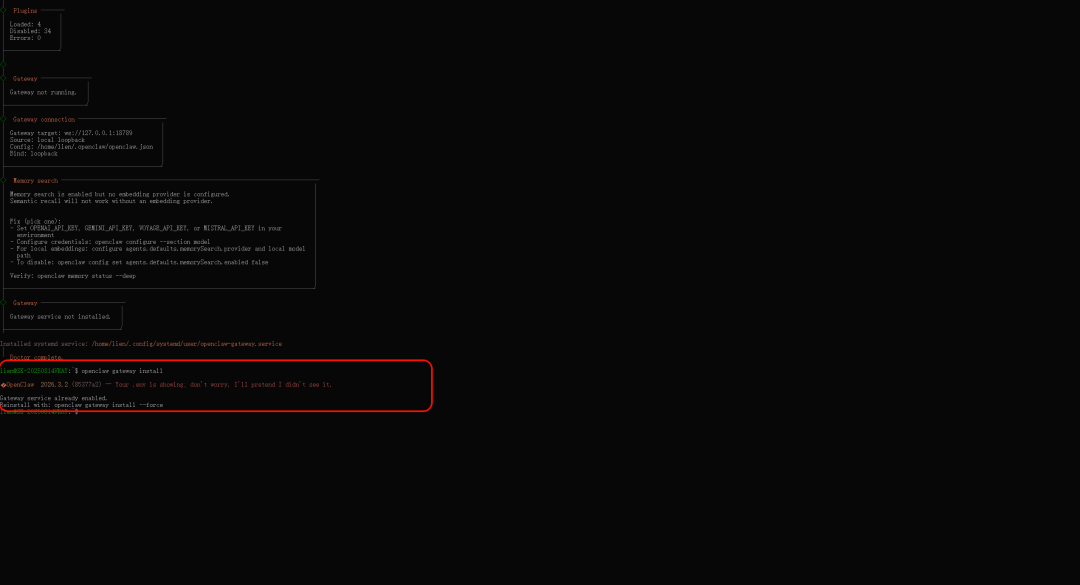

执行:

openclaw gateway install

说明服务装了,但还没启动

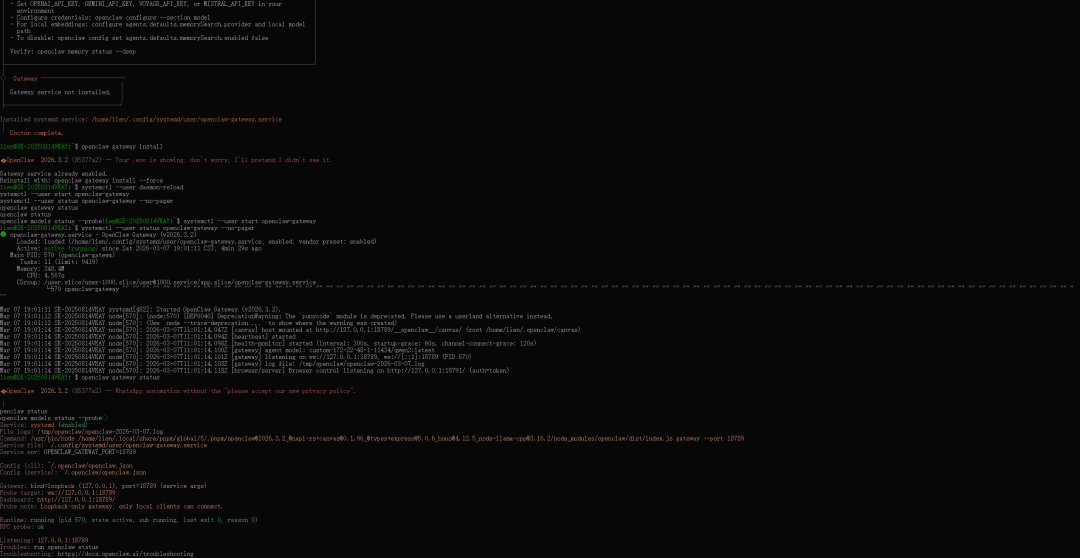

执行:

systemctl --user daemon-reload

systemctl --user start openclaw-gateway

systemctl --user status openclaw-gateway --no-pager

openclaw gateway status

openclaw status

openclaw models status --probe

复制全部的命令一次性执行,如图这就ok了

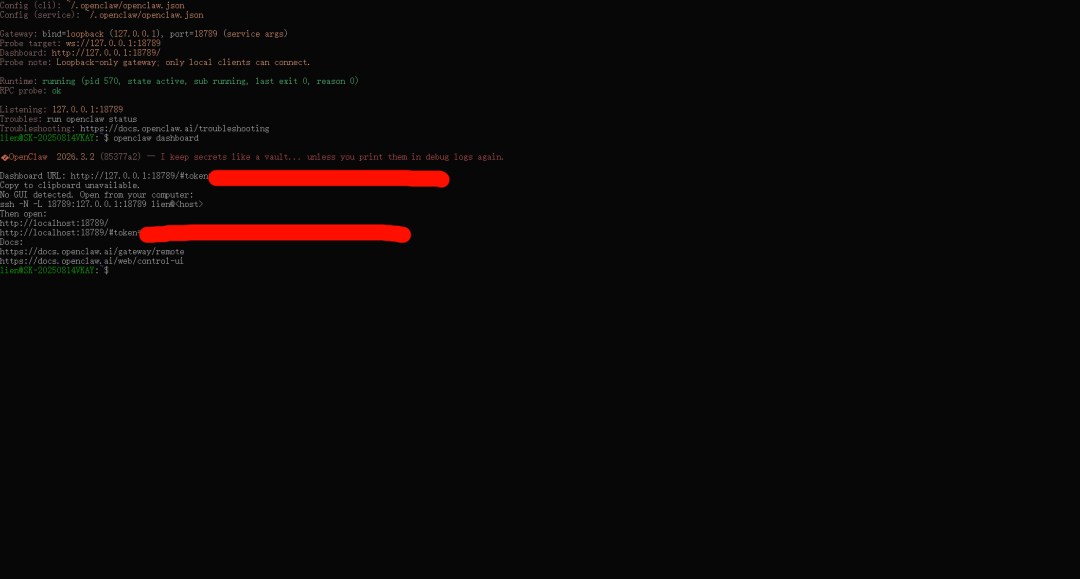

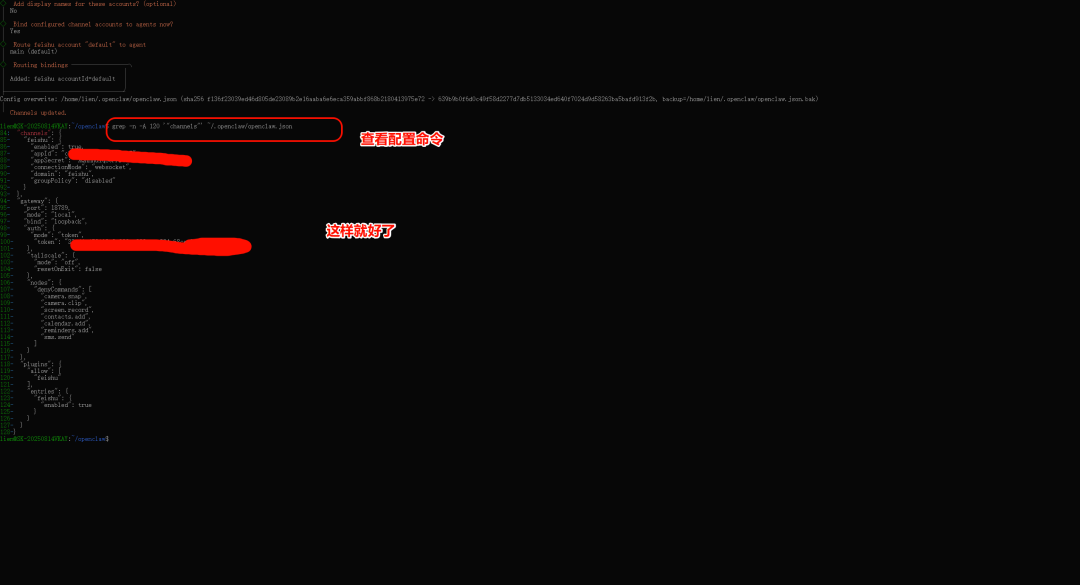

在 WSL 里执行:

openclaw dashboard

根据自己输出的链接打开不要用我的,用自己的

18789+2才能浏览器打开(18791)

要复制完整链接到 Windows 浏览器打开。

不要打开这个:

http://localhost:18789

要打开它输出的完整地址,也就是这一条:

http://localhost:18789/#token=自己的

或者这条也可以:

http://127.0.0.1:18789/#token=自己的

如果打不开请执行

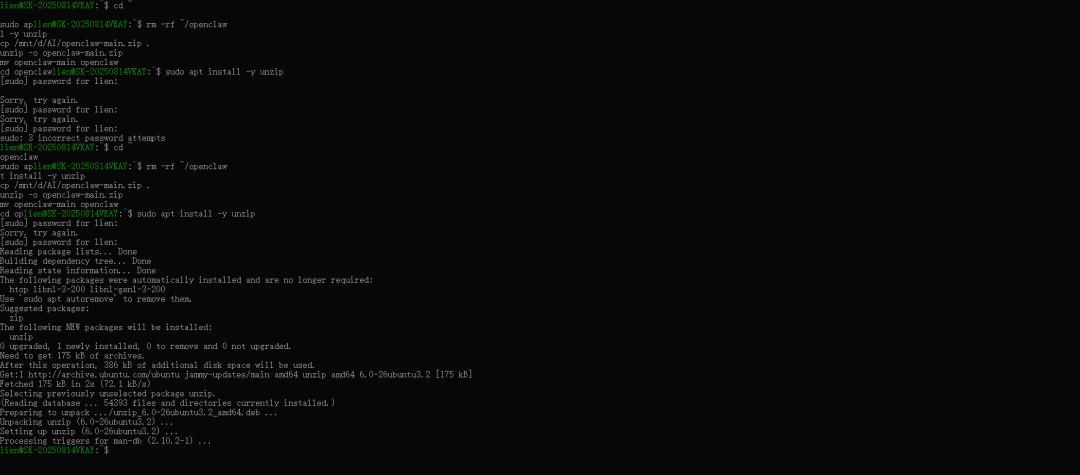

cd ~

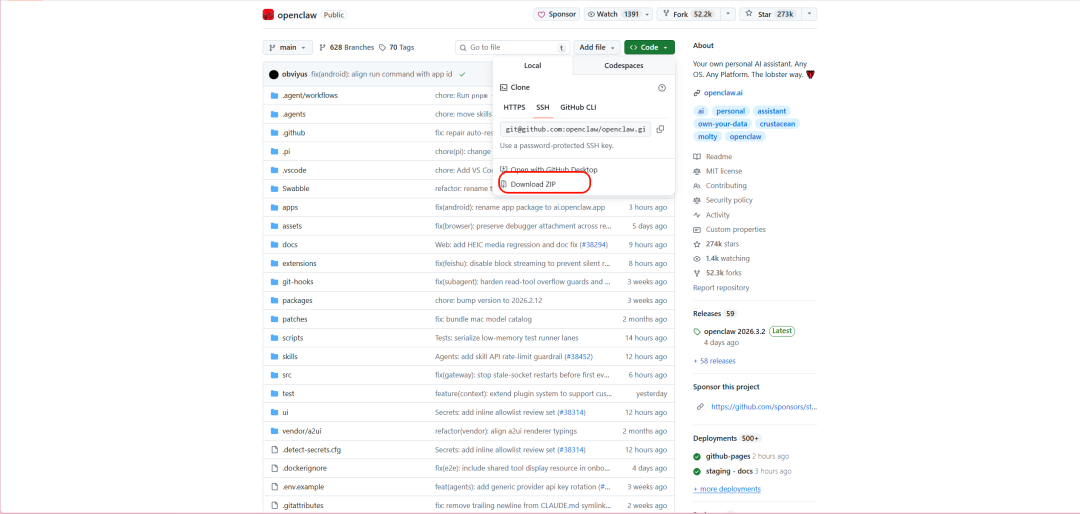

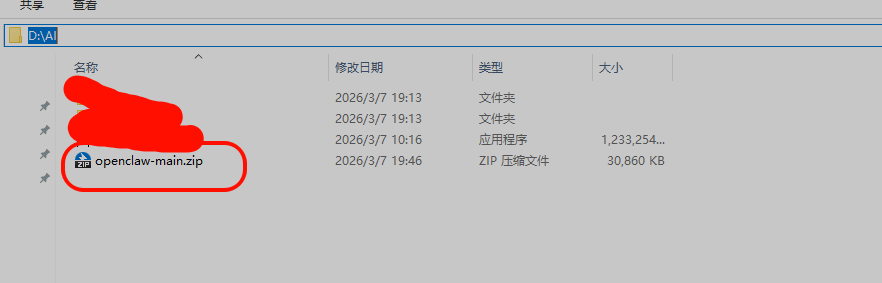

rm -rf ~/openclaw

sudo apt install -y unzip

cp /mnt/d/AI/openclaw-main.zip .

unzip -o openclaw-main.zip

mv openclaw-main openclaw

cd openclaw

注意:

/d/AI/openclaw-main.zip . 是文件目录

下载

openclaw-main.zip的目录换成自己的

全复制执行

确认是否在 ~/openclaw 目录里

执行

cd ~

ls

ls /mnt/d/AI

cp /mnt/d/AI/openclaw-main.zip .

unzip -o openclaw-main.zip

mv -f openclaw-main openclaw

ls

cd ~/openclaw

pwd

这样就对了

然后执行

sudo npm install -g pnpm

pnpm -v

![]()

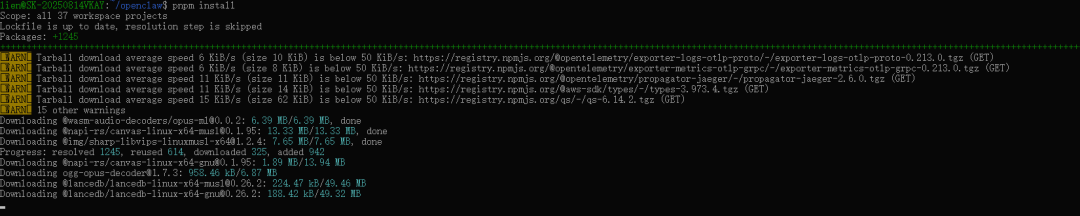

pnpm install (等执行完毕)

pnpm ui:build (构建 Dashboard 前端)

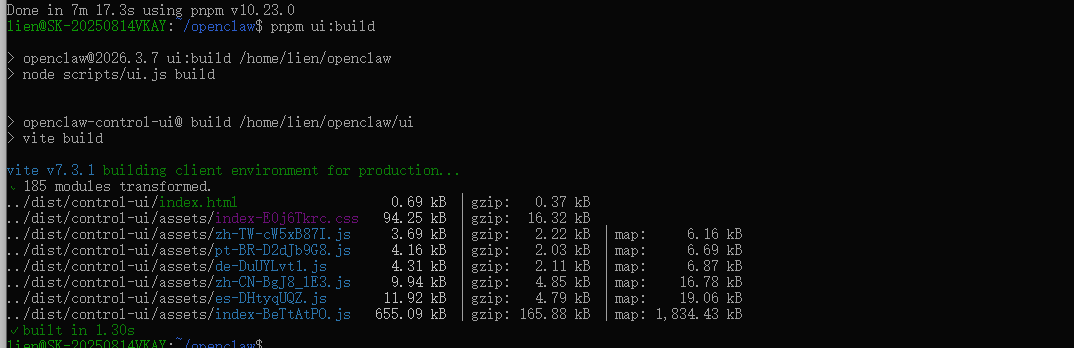

pnpm build (构建源码版 OpenClaw)

如果两条都成功

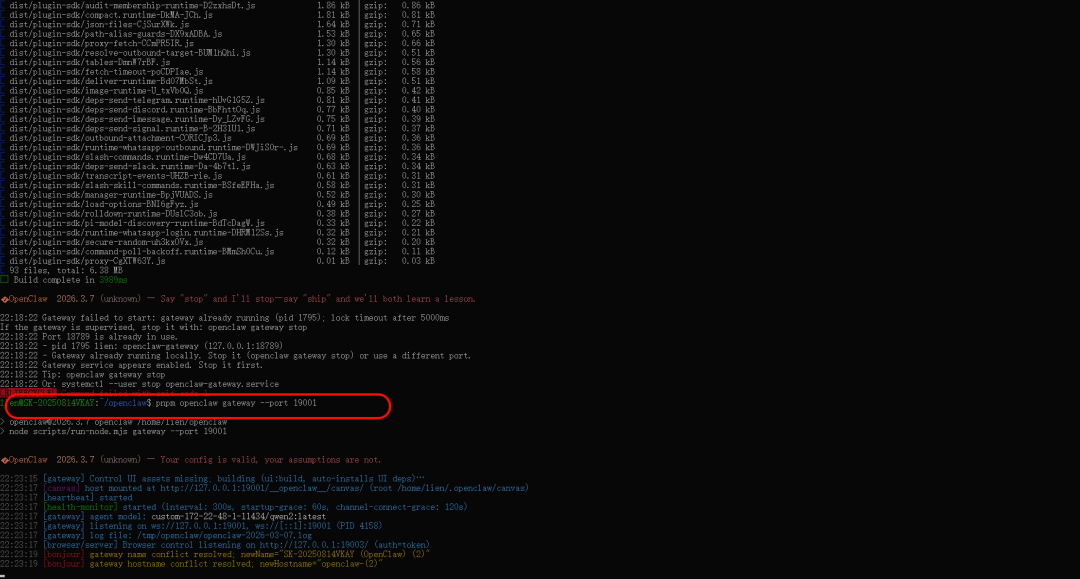

接着执行:

pnpm openclaw gateway --port 18789

正常,这不是新报错,意思是:

-

你源码版已经构建成功了

-

但 18789 端口已经被之前的 OpenClaw gateway 占用了

-

所以源码版没法再抢这个端口

你现在有两种走法。

方案 1:最省事,换个端口跑源码版

直接在 ~/openclaw 目录执行:

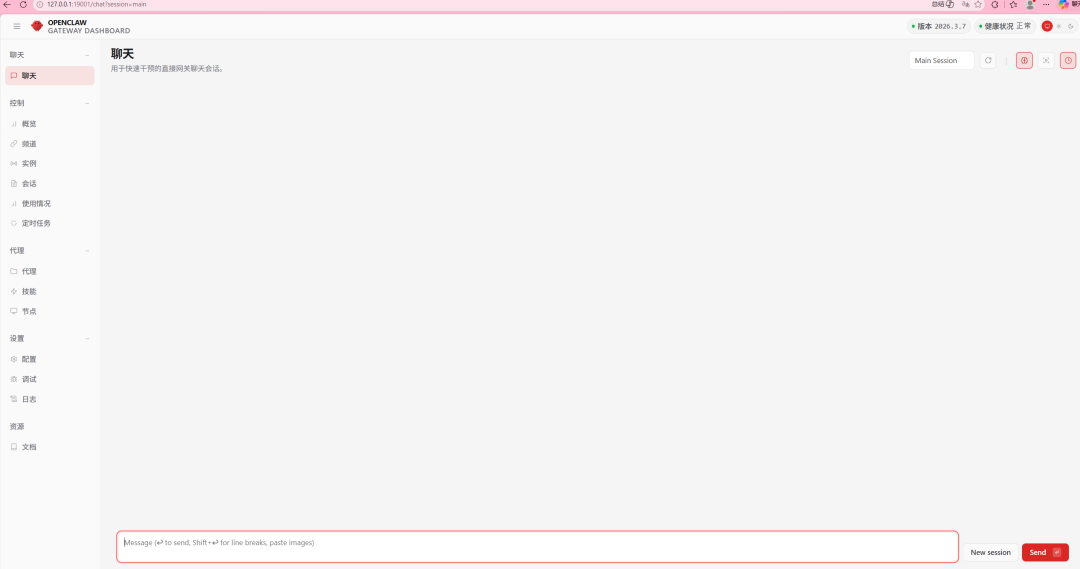

pnpm openclaw gateway --port19001

然后浏览器打开:

http://127.0.0.1:19001/

如果它给你 token,就用带 token 的完整链接打开。

你现在先打开这个:

http://127.0.0.1:19001/

如果需要 token,就用:

http://127.0.0.1:19001/#token=你的token

怎么拿 19001 这套的 token

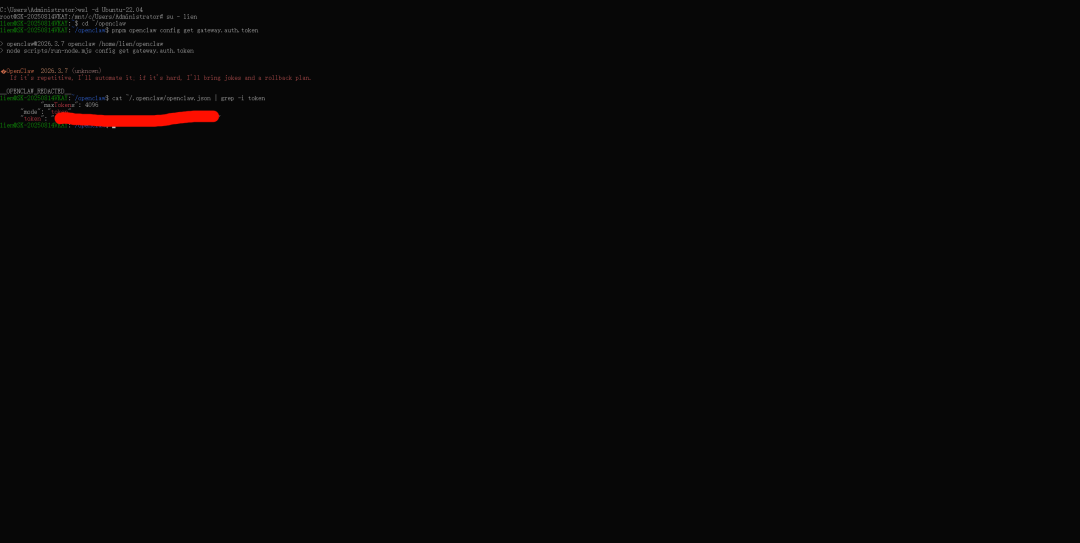

保持这个 pnpm openclaw gateway --port 19001 窗口别关。另开一个新的 WSL 窗口,进源码目录后执行:

cd ~/openclawpnpm openclaw dashboard --port19001

如果这个子命令不认,再试:

cd ~/openclawpnpm openclaw config get gateway.auth.token

方案 2:停掉旧的 18789 服务,再让源码版占用 18789

如果你就是想继续用 18789,那先停旧服务:

openclaw gateway stopsystemctl --userstop openclaw-gateway

然后再启动源码版:

cd ~/openclawpnpm openclaw gateway --port18789

再打开:

http://127.0.0.1:18789/

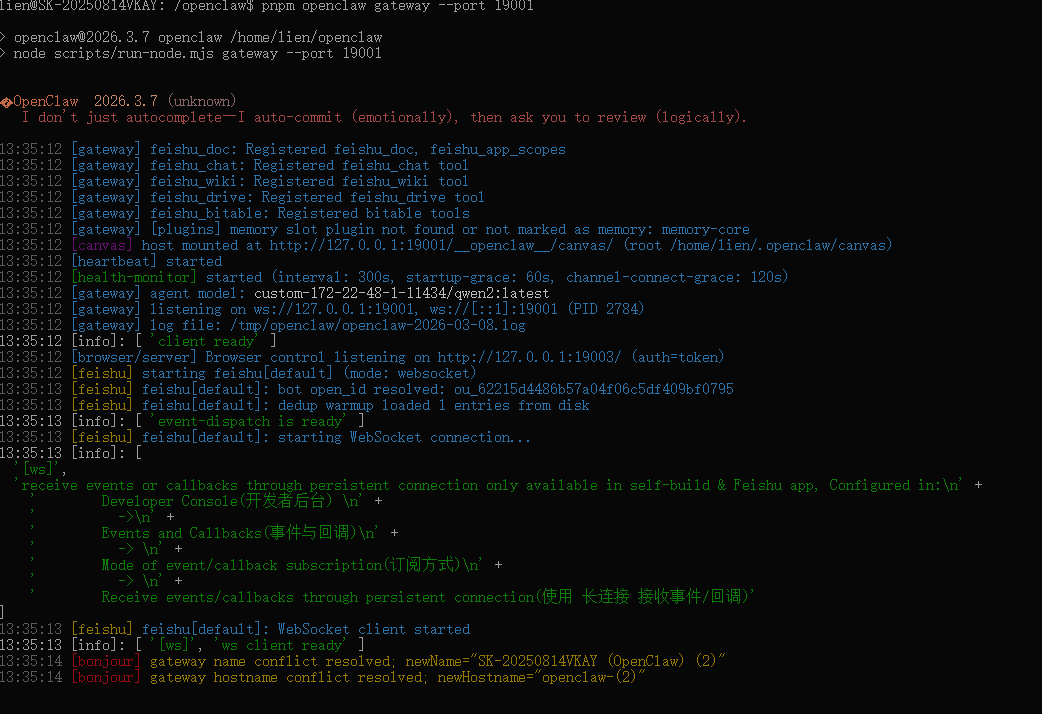

你现在跑通的是 源码版 19001。后面要用这套 Dashboard,记住启动方式就是在 ~/openclaw 目录执行:

pnpm openclaw gateway --port19001

然后浏览器打开:

http://127.0.0.1:19001/

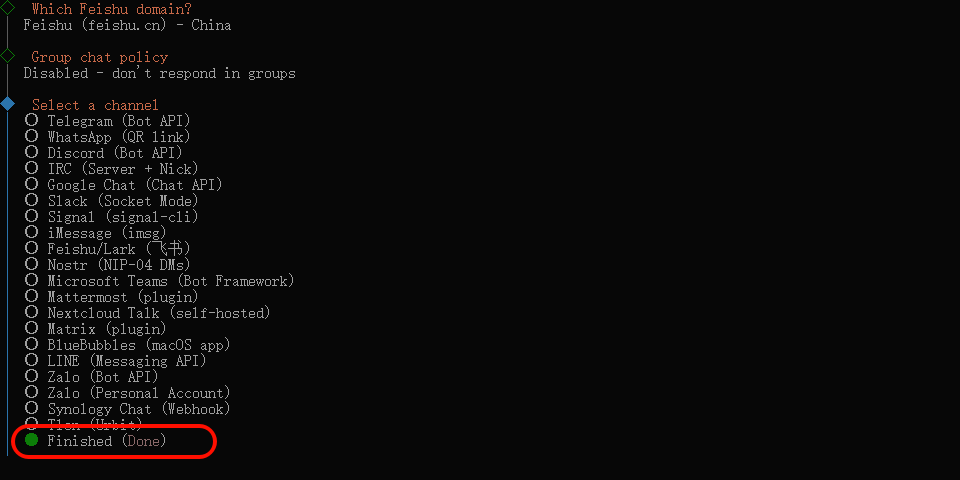

后面就是部署飞书或者企业微信了

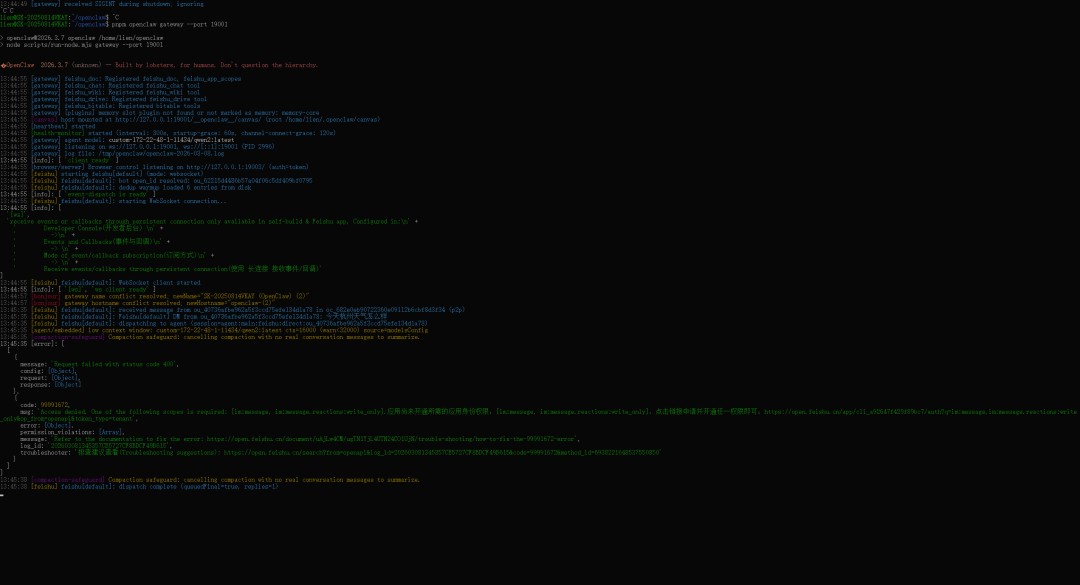

飞书为例

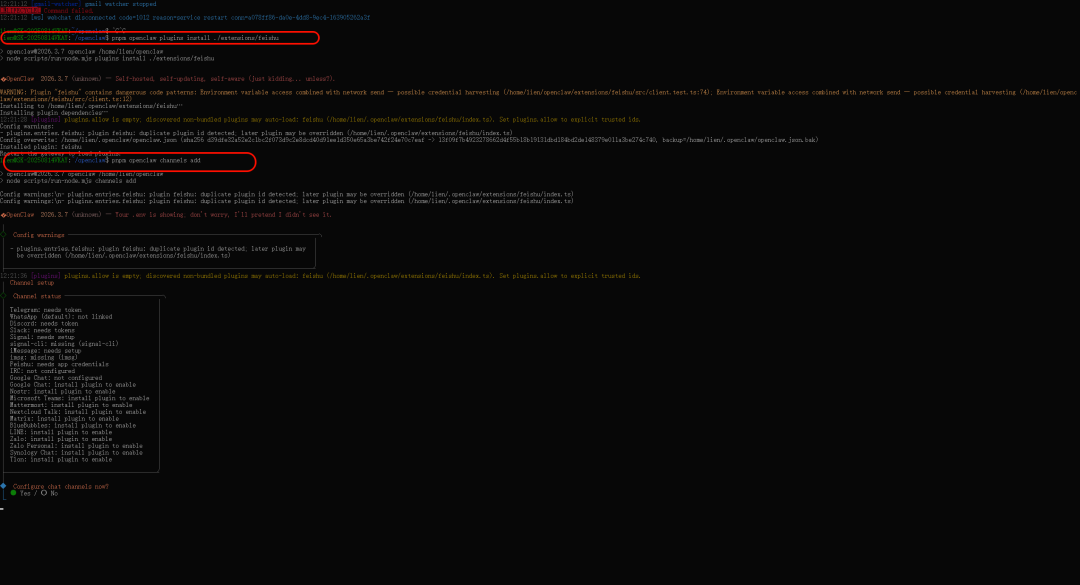

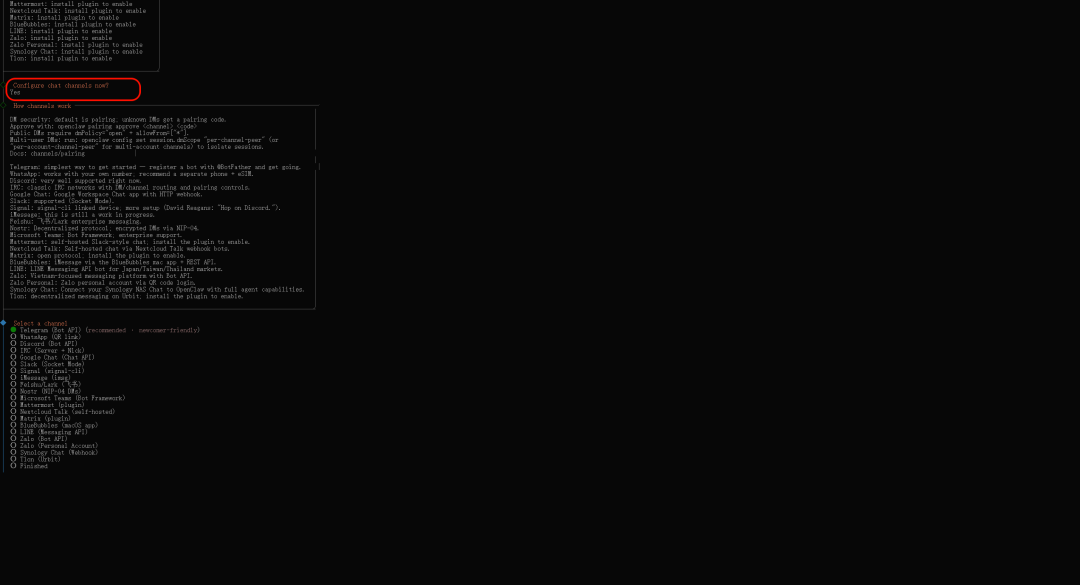

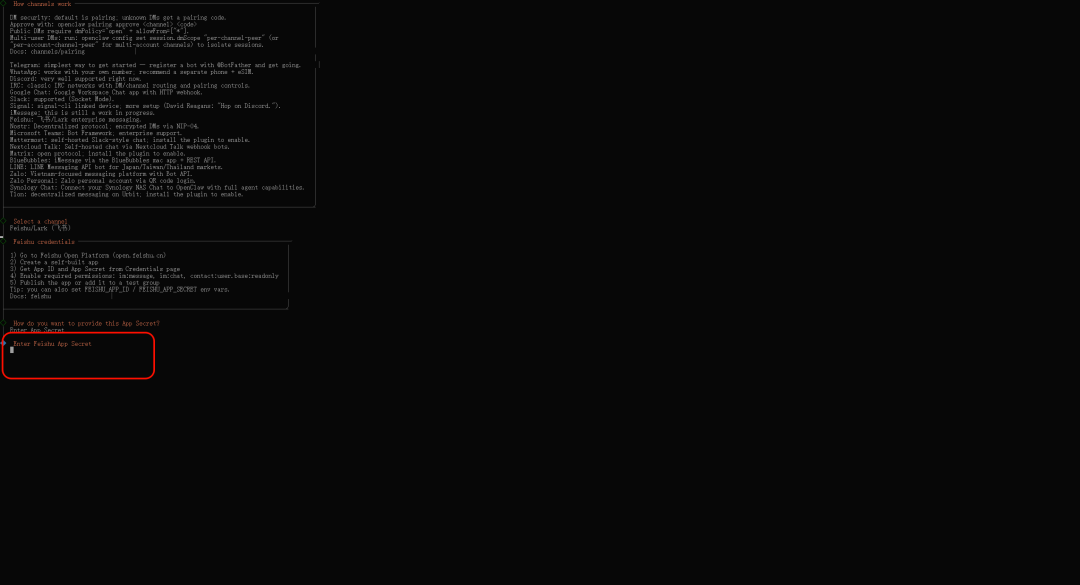

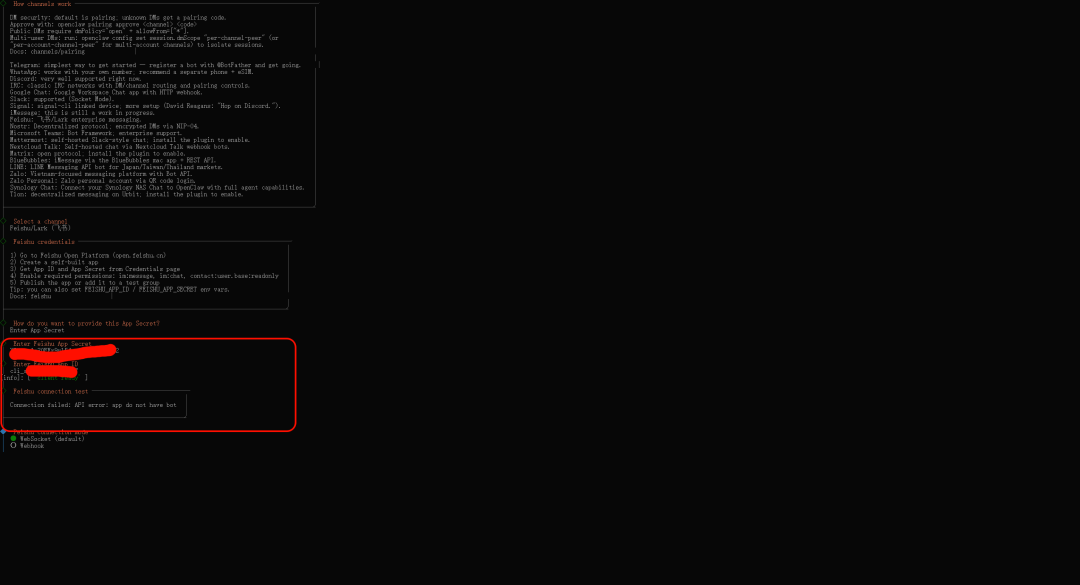

执行 (依次执行)

cd ~/openclaw

pnpm openclaw plugins install ./extensions/feishu

pnpm openclaw channels add

先别填

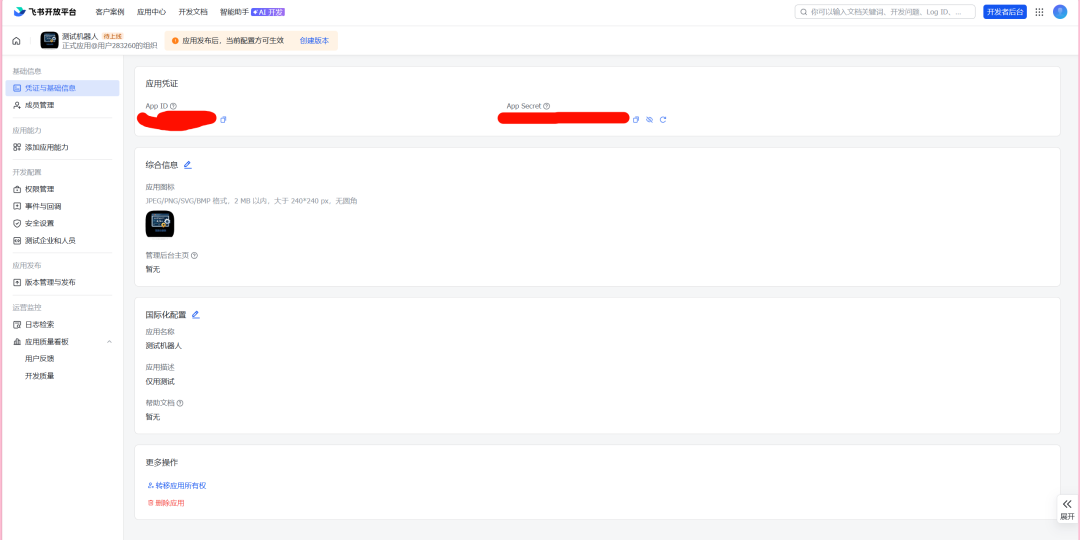

来到https://open.feishu.cn/app?lang=zh-CN

-

进入你创建的 企业自建应用

-

找到 凭证与基础信息

-

复制:

-

App ID -

App Secret

-

-

要把真实的 App Secret 粘贴到这里

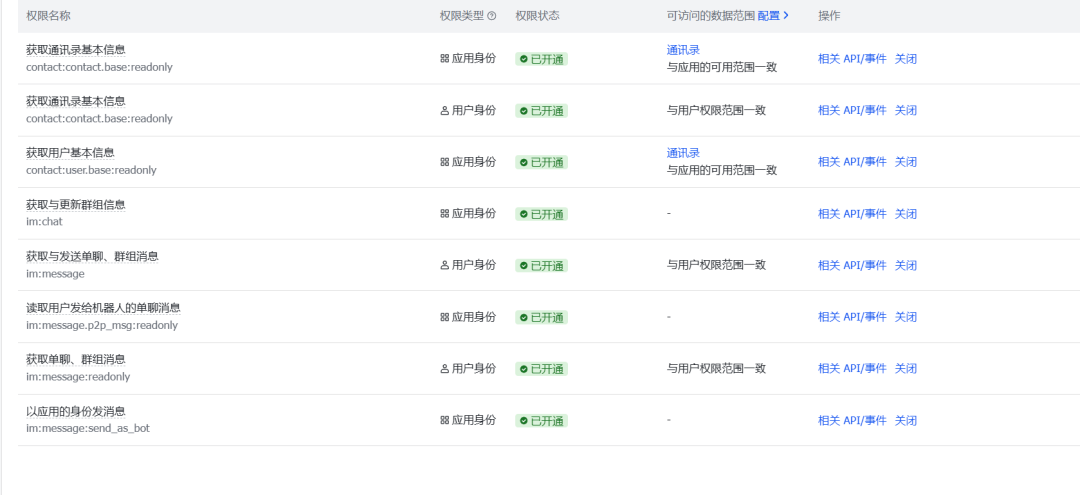

添加机器人

然后开通权限-至少这几个都要开

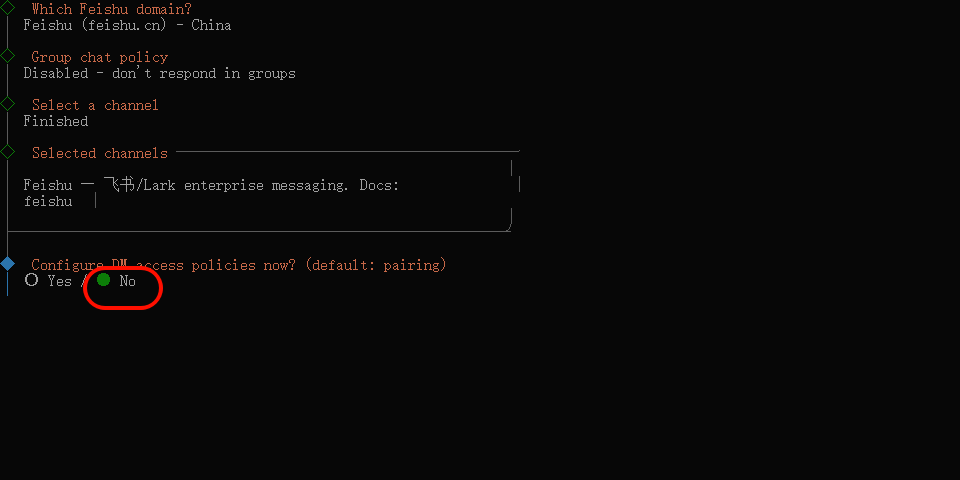

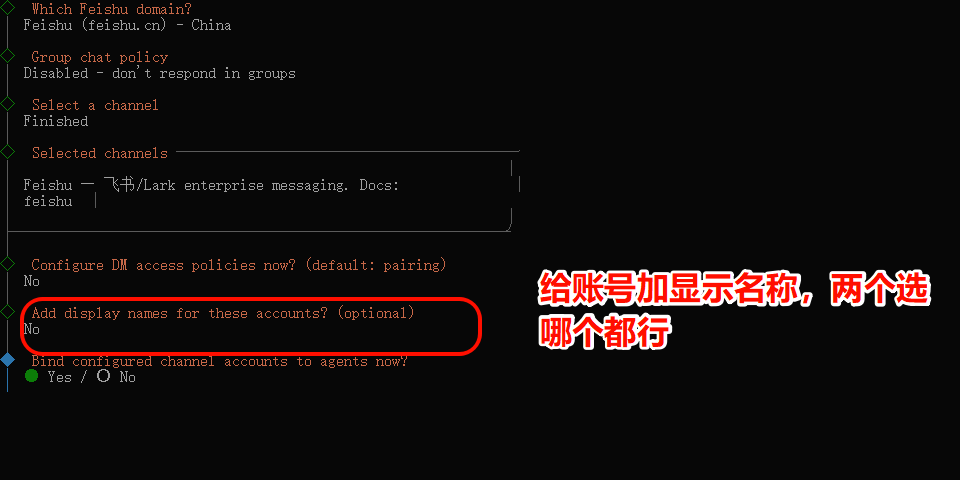

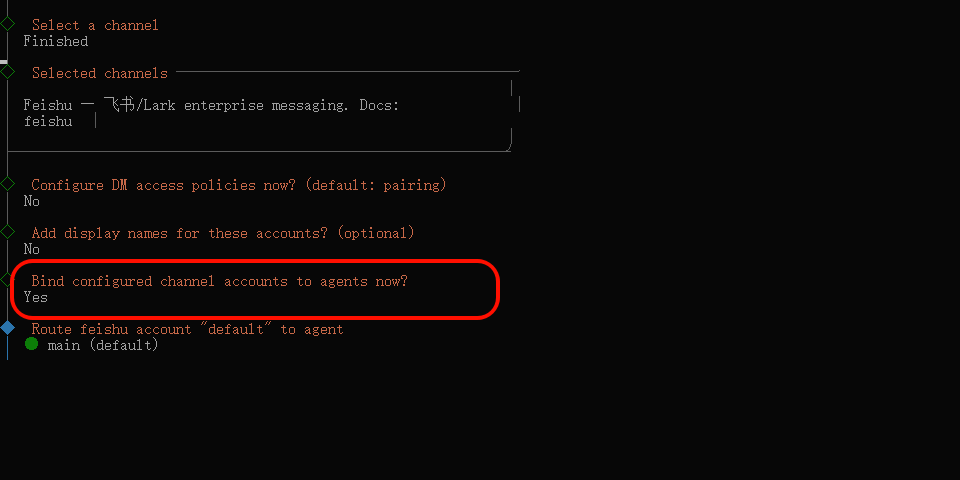

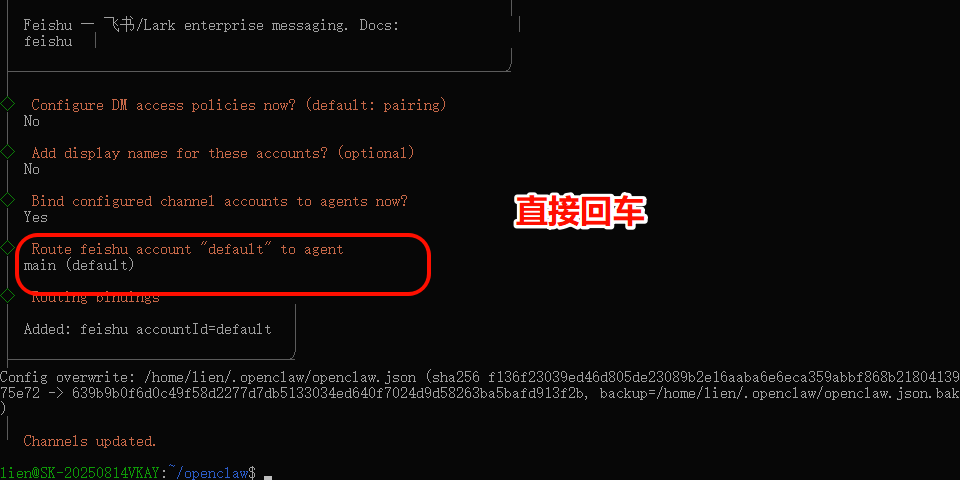

然后回终端继续

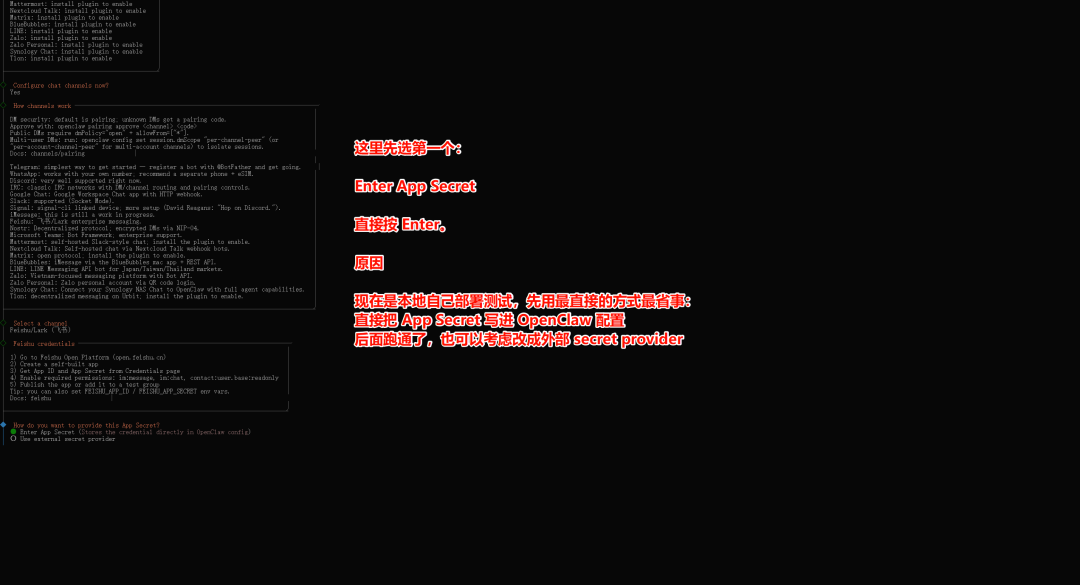

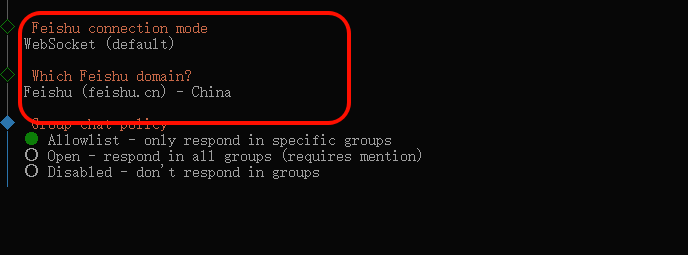

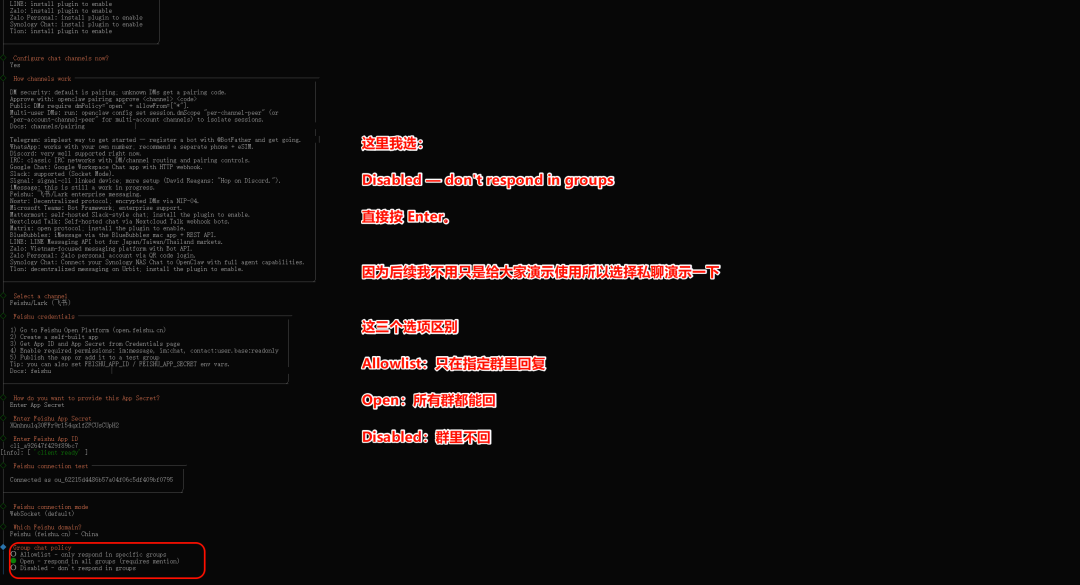

在刚才那个 OpenClaw 终端里,保持:

-

Feishu connection mode 选

WebSocket (default)

然后按 Enter 继续。

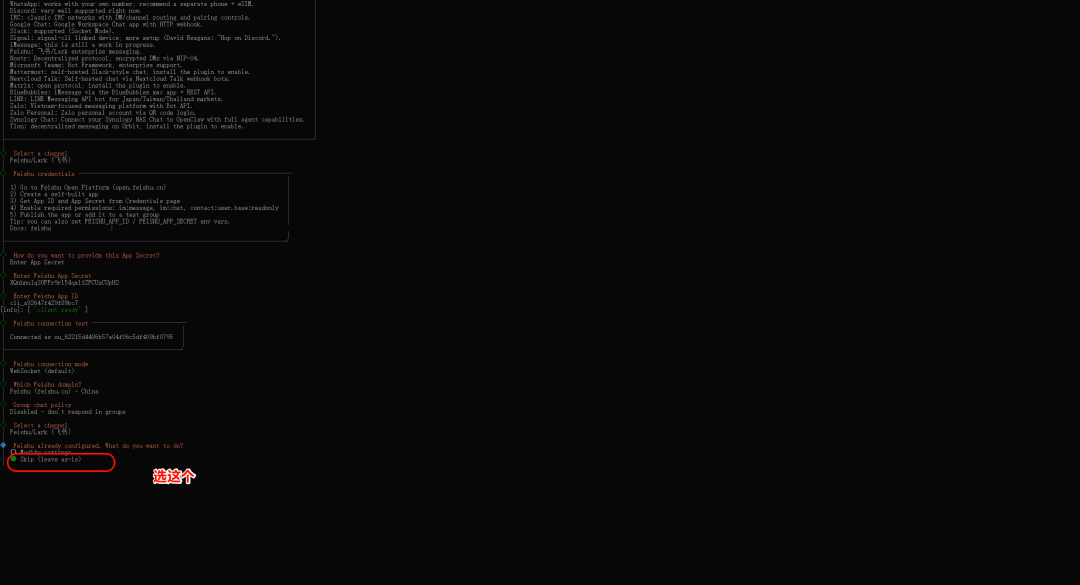

选完 Skip 之后:

退出这个添加向导

-

回到

~/openclaw

-

启动源码版网关:

cd ~/openclaw

pnpm openclaw gateway --port 19001

保持这个窗口不要关。

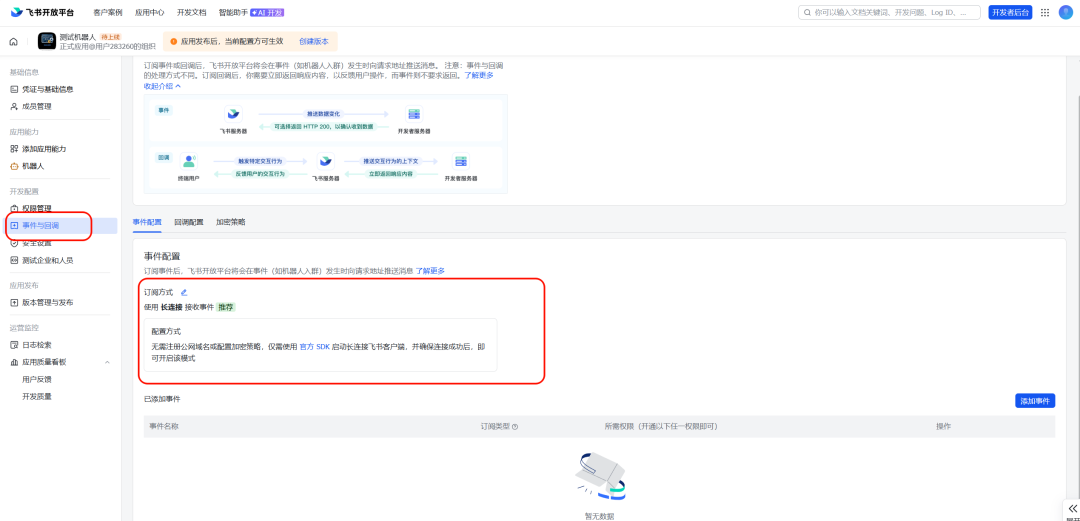

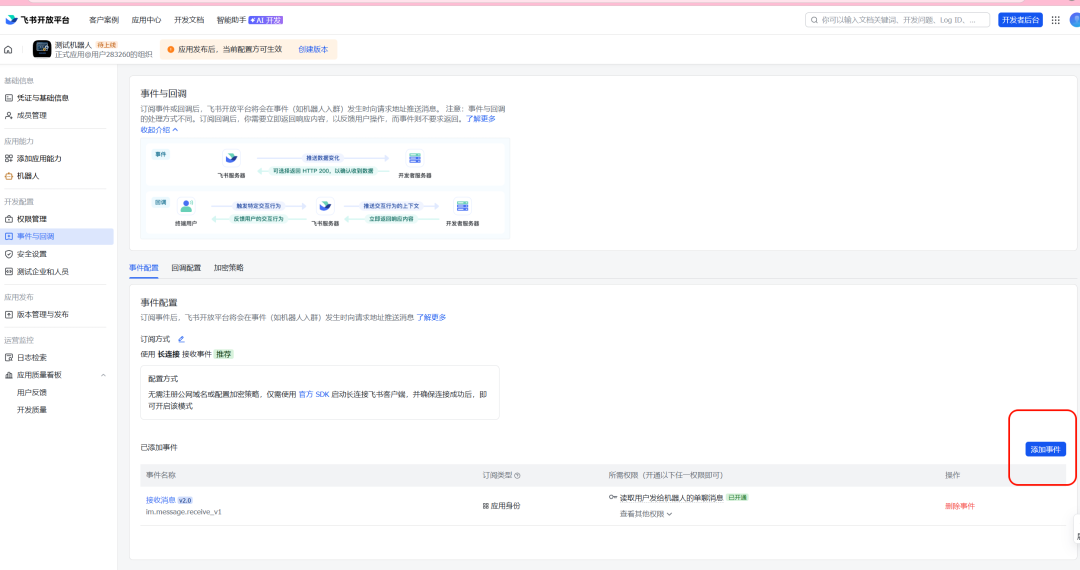

然后回飞书后台

使用长连接接收事件点“保存”

点“添加事件”

添加这个事件:

im.message.receive_v1

4)保存事件列表

然后继续做两件事

5)去“权限管理”确认权限

至少确认这些已经有:

-

im:message -

im:chat -

contact:user.base:readonly

如果有更细的消息读写权限,也都开上。

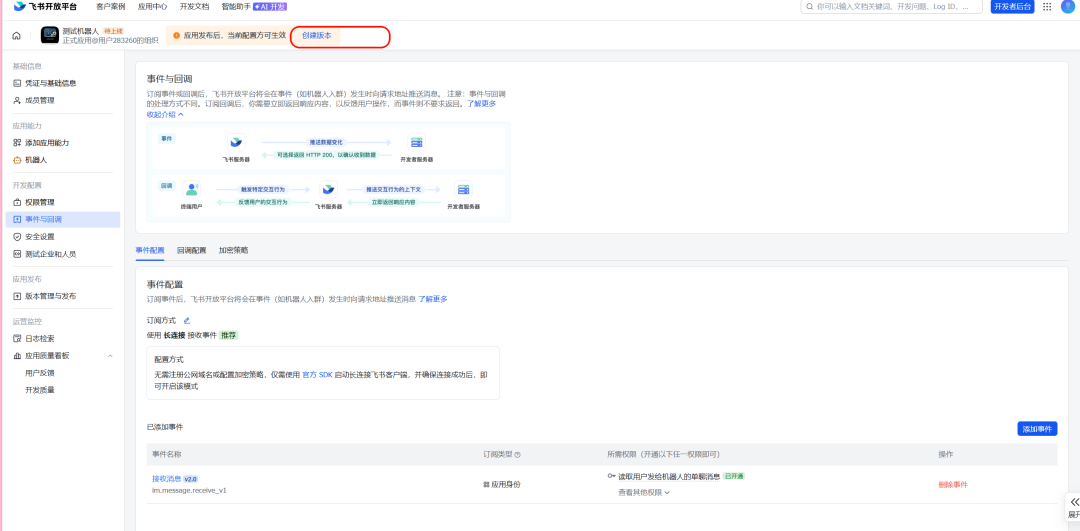

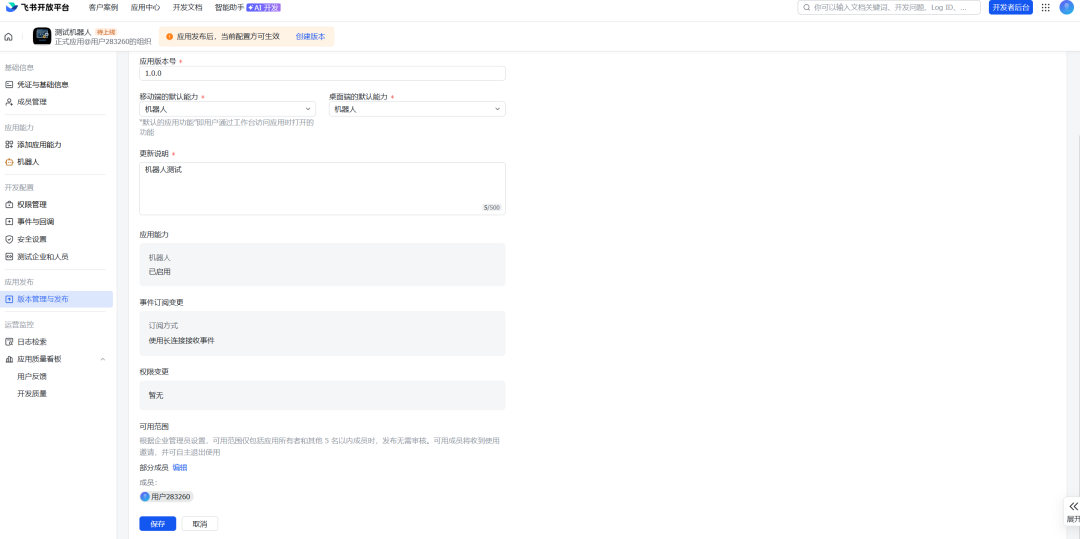

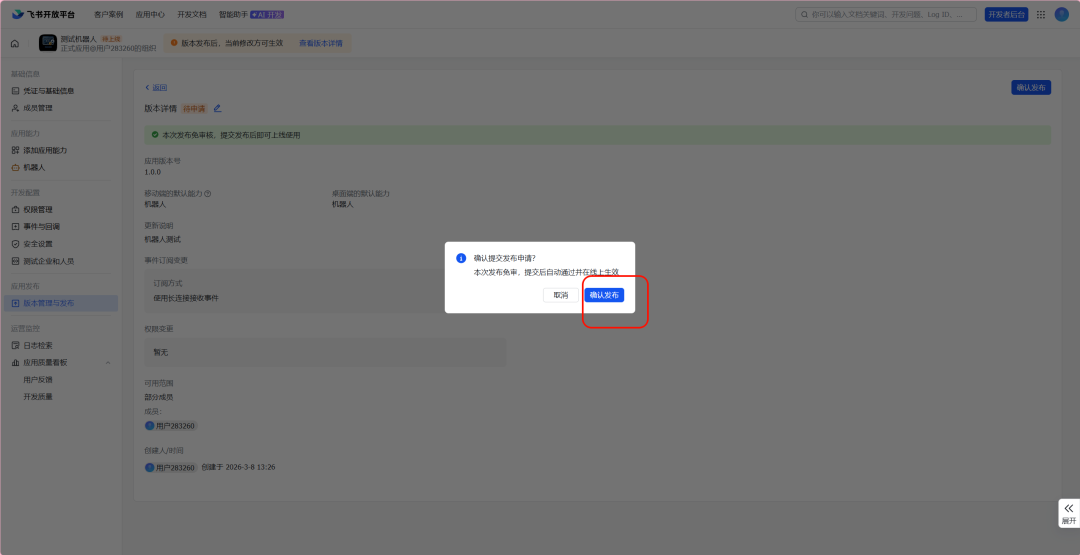

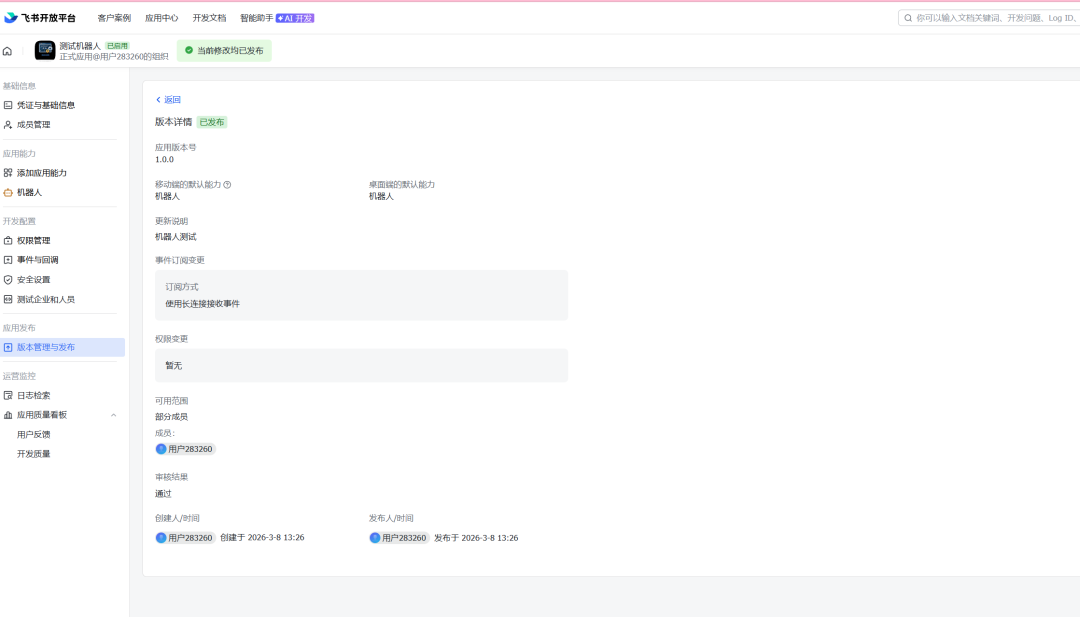

6)去“版本管理与发布”

创建版本并发布。

不发布的话,很多配置不会真正生效。

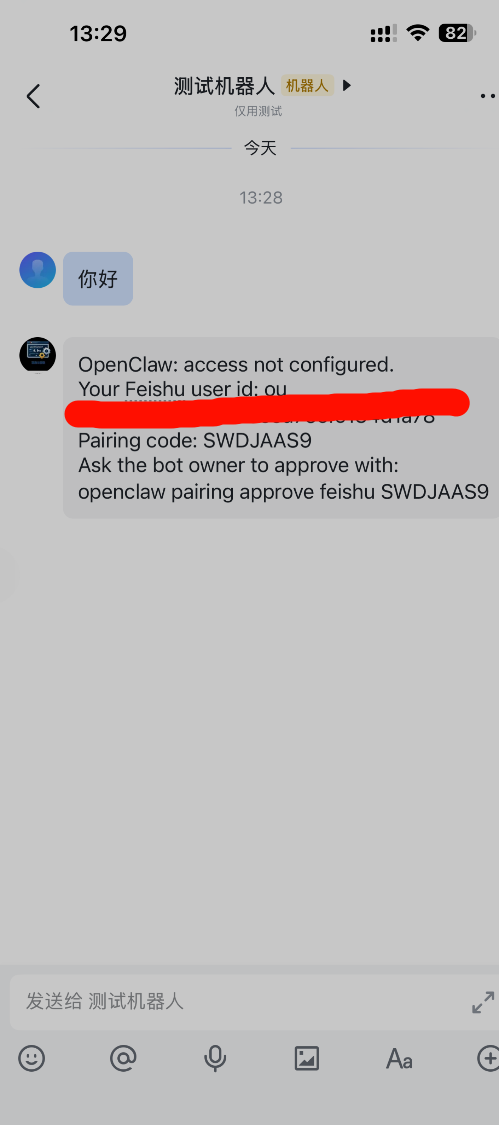

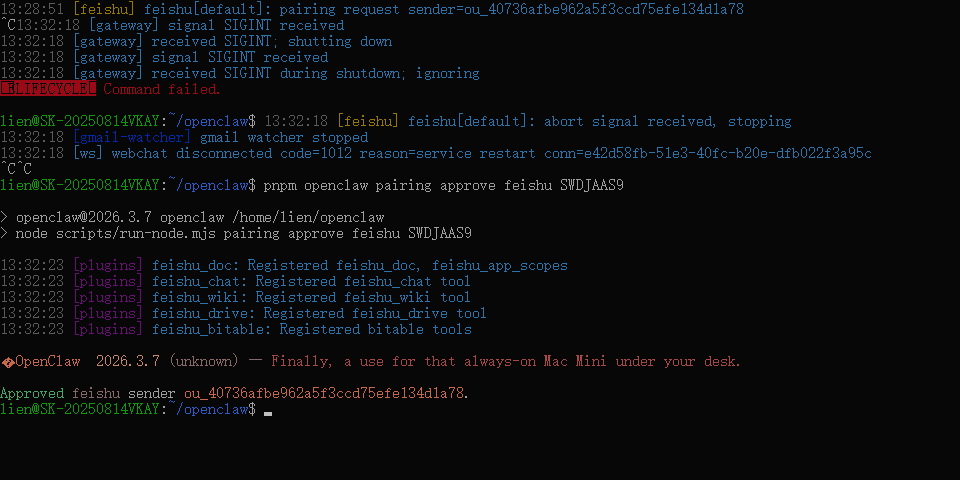

还要批准配对一下

例如我的

飞书里收到的是:

Pairing code: SWDJAAS9

终端确认收到了:

pairing request sender=ou_40736afbe962a5f3ccd75efe134d1a78

然后执行

cd ~/openclaw

pnpm openclaw pairing approve feishu SWDJAAS9

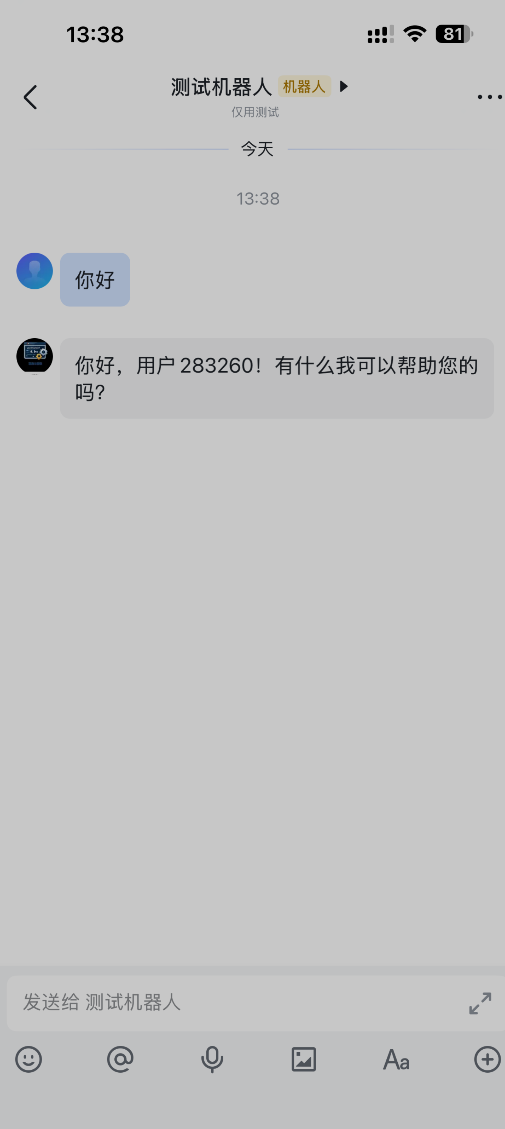

记得要启动一下

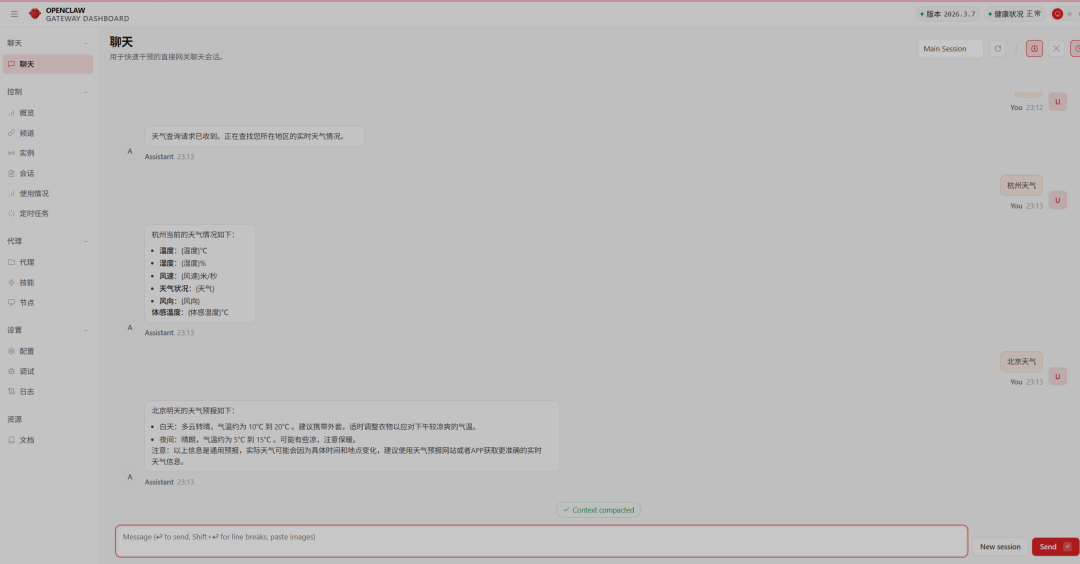

然后回到飞书里,再给机器人发一句

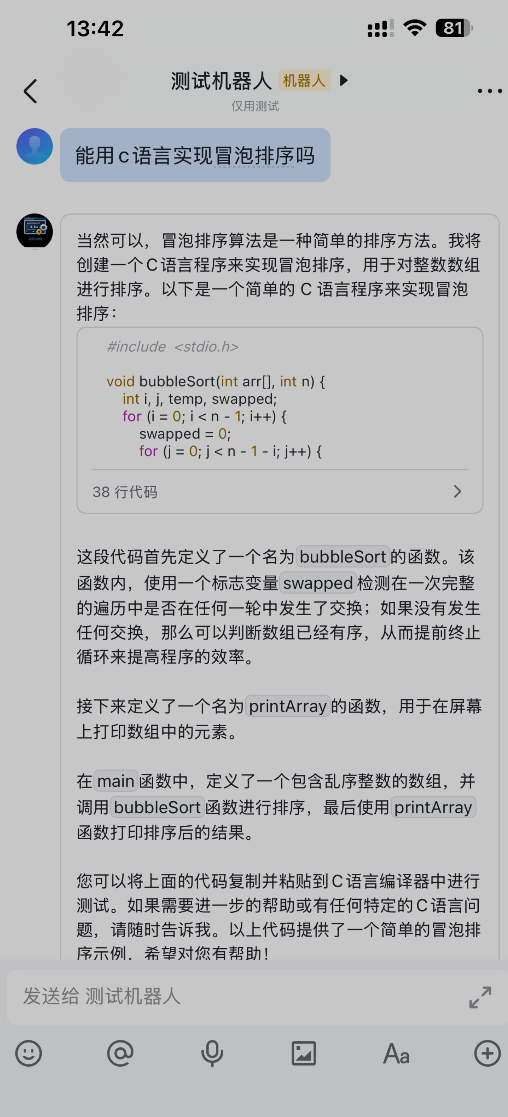

大模型正常

小龙虾正常(权限提示可以后续根据自己需要配置然后发布生效)

至此搭建完成✿✿ヽ(°▽°)ノ✿

需要注意的是:每次使用必须大模型和小龙虾全部启动

一、现在这套架构

-

OpenClaw 源码版:WSL2 Ubuntu 里运行

-

Ollama:Windows 原生运行

-

飞书渠道:WebSocket 长连接

-

OpenClaw Dashboard:

19001 -

Browser control:

19003 -

当前模型:

qwen2:latest

二、日常启动顺序

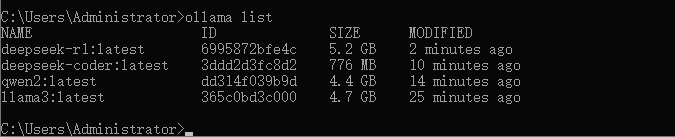

1)先启动 Windows 上的 Ollama

在 Windows CMD 里:

set OLLAMA_HOST=0.0.0.0:11434ollama serve

如果想看模型列表:

ollama list

这个窗口不要关。

2)启动 WSL Ubuntu

在 Windows 里:

wsl-dUbuntu-22.04

如果进去是 root,切换到普通用户:

su- lien

3)进入 OpenClaw 项目目录

cd ~/openclaw

4)启动 OpenClaw Gateway

pnpm openclaw gateway --port19001

这个窗口不要关。

正常启动时,你会看到类似

-

feishu[default]: starting WebSocket connection... -

WebSocket client started -

ws client ready

这说明:

-

OpenClaw 已启动

-

飞书长连接已建立

-

飞书机器人可以收消息了

5)打开 Dashboard

浏览器打开:

http://127.0.0.1:19001/

三、日常停止方式

1)停止 OpenClaw

在运行 pnpm openclaw gateway --port 19001 的那个终端里:

Ctrl + C

2)停止 Ollama

在 Windows 里运行 ollama serve 的窗口按:

Ctrl + C

3)关闭 WSL

在 Windows 里:

wsl--shutdown

四、最常用命令

查看 OpenClaw 状态

cd ~/openclawpnpm openclaw status

更详细:

cd ~/openclawpnpm openclaw status --deep

查看模型状态

cd ~/openclawpnpm openclaw models status

探测模型可用性:

cd ~/openclawpnpm openclaw models status --probe

看日志

持续看日志:

cd ~/openclawpnpm openclaw logs --follow

如果你主要看飞书,也可以配合 grep:

cd ~/openclawpnpm openclaw logs --follow | grep-i feishu

本地 CLI 测试一轮 agent

cd ~/openclawOPENCLAW_GATEWAY_PORT=19001 pnpm openclaw agent --local--to+10000000001--message"你好"

批准飞书 pairing

如果飞书第一次私聊返回 pairing code,就执行:

cd ~/openclawpnpm openclaw pairing approve feishu <CODE>

把 <CODE> 换成飞书里看到的码。

五、你这套飞书的关键配置

你现在已经写进配置的核心内容是:

-

channels.feishu.enabled = true -

connectionMode = websocket -

domain = feishu -

groupPolicy = disabled

这表示:

-

飞书已启用

-

使用 WebSocket 长连接

-

走中国区飞书

-

群聊默认不回复,只测私聊

六、飞书日常测试方法

最简单测试

在飞书里给机器人发:

你好

或:

请只回复两个字:成功

代码能力测试

请用 Python 写一个冒泡排序

指令跟随测试

请只回复:会,我可以写代码。

七、常见问题与处理

1)飞书发消息没反应

先看 OpenClaw 网关窗口是否还开着。

如果 gateway 关了:

cd ~/openclawpnpm openclaw gateway --port19001

再看日志里有没有

-

feishu[default]: starting WebSocket connection... -

WebSocket client started -

ws client ready

如果没有,说明飞书长连接没起来。

2)飞书后台保存不了“事件与回调”

常见原因是:

-

OpenClaw 还没真正连上飞书长连接

-

飞书后台检测不到应用连接

处理方式:

-

先启动 OpenClaw gateway

-

看到

ws client ready -

再回飞书后台点保存

3)第一次私聊提示 “access not configured”

这不是坏了,是默认私聊策略 pairing 在起作用。

飞书里会给你一条类似:

Pairing code: XXXXXXXX

然后在 WSL 里批准:

cd ~/openclawpnpm openclaw pairing approve feishu XXXXXXXX

4)回复里显示“用户 283260”这种数字,不够自然

这是因为飞书联系人权限不够。

去飞书开放平台 权限管理 里补至少一个:

contact:contact.base:readonly

补完后:

-

创建新版本

-

发布应用

这样后面更有机会显示真实昵称,而不是数字用户标识。

5)Dashboard 能打开,但回答偶尔很乱

这类情况你前面已经遇到过,本质上多半是:

-

当前 UI 会话状态脏了

-

内部 tool call 被前台显示

-

当前聊天页偶尔走偏

处理办法

-

点

New session -

或直接刷新页面

-

然后重新开始一轮简单对话

6)OpenClaw 回答偶尔像程序报错

如果看到类似:

-

session_status -

Validation failed for tool "message" -

unknown session ID

这通常不是 Ollama 坏了,而是:

-

Dashboard 当前会话状态有问题

-

tool 路由走偏了

优先:

-

刷新 Dashboard

-

新开会话

-

再测试

7)飞书插件重复加载

你前面已经修过一次。以后如果再看到:

duplicate plugin id detected

优先检查:

-

~/.openclaw/extensions/feishu -

~/openclaw/extensions/feishu

源码版最稳做法是:

-

保留源码目录里的

~/openclaw/extensions/feishu -

不要再保留重复 install 副本

8)飞书连接有了,但后台还提示权限不足

你前面日志里出现过这类错误:

Access denied...required scopes:contact:contact.base:readonly...

这说明:

-

飞书机器人能连上

-

但部分联系人/用户信息权限不够

通常不一定会阻止基本聊天,但会影响:

-

用户昵称读取

-

某些用户/联系人相关功能

处理办法:

-

去飞书后台补权限

-

创建新版本

-

发布应用

八、推荐你的固定日常启动模板

Windows 端

set OLLAMA_HOST=0.0.0.0:11434ollama serve

WSL 端

su- liencd ~/openclawpnpm openclaw gateway --port19001

浏览器

http://127.0.0.1:19001/

飞书

直接给机器人发消息测试。

九、推荐你的固定排查模板

先看模型

cd ~/openclawpnpm openclaw models status --probe

再看整体状态

cd ~/openclawpnpm openclaw status --deep

再看飞书日志

cd ~/openclawpnpm openclaw logs --follow | grep-i feishu

十、一句话速查版

启动 OpenClaw

cd ~/openclawpnpm openclaw gateway --port19001

Dashboard

http://127.0.0.1:19001/

批准飞书 pairing

cd ~/openclawpnpm openclaw pairing approve feishu <CODE>

看状态

cd ~/openclawpnpm openclaw status --deep

停止

Ctrl + C

补充-安装skills(根据自己需要安装配置,我这里做个参考)

1)GitHub 系

要让 OpenClaw 更像工程助手,GitHub 系最值。

重点是:

-

gh-issues -

gitgrep -

github

这类通常先装 GitHub CLI。

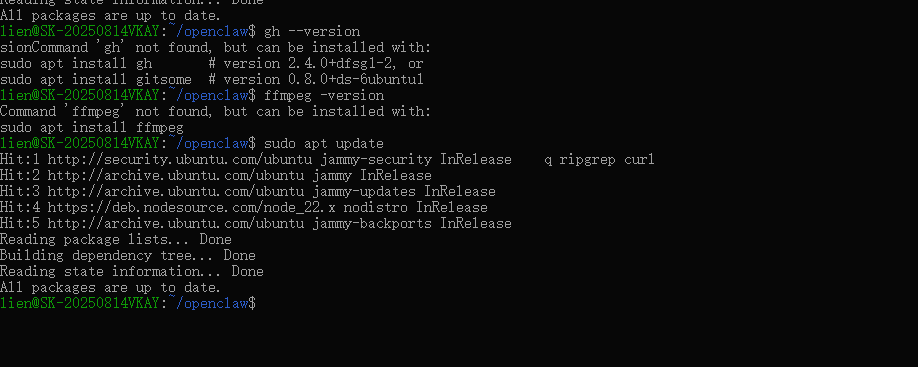

先检查有没有:

gh --version

如果没有,再装。

2)视频帧提取

这个通常只要有 ffmpeg 就更容易启用。

检查:

ffmpeg -version

3)xurl / 通用 API 调用

能扩展很多服务能力。

4)coding-agent 深用

先补这一批通用依赖

在 Ubuntu 里执行:

sudo apt updatesudo apt install -y gh ffmpeg jq ripgrep curl

这几个分别对应

-

gh:GitHub 相关 skills -

ffmpeg:视频/音频/帧提取相关 skills -

jq:很多 CLI/JSON 处理会用到 -

ripgrep:搜索类能力常用 -

curl:通用网络/API 调试常用

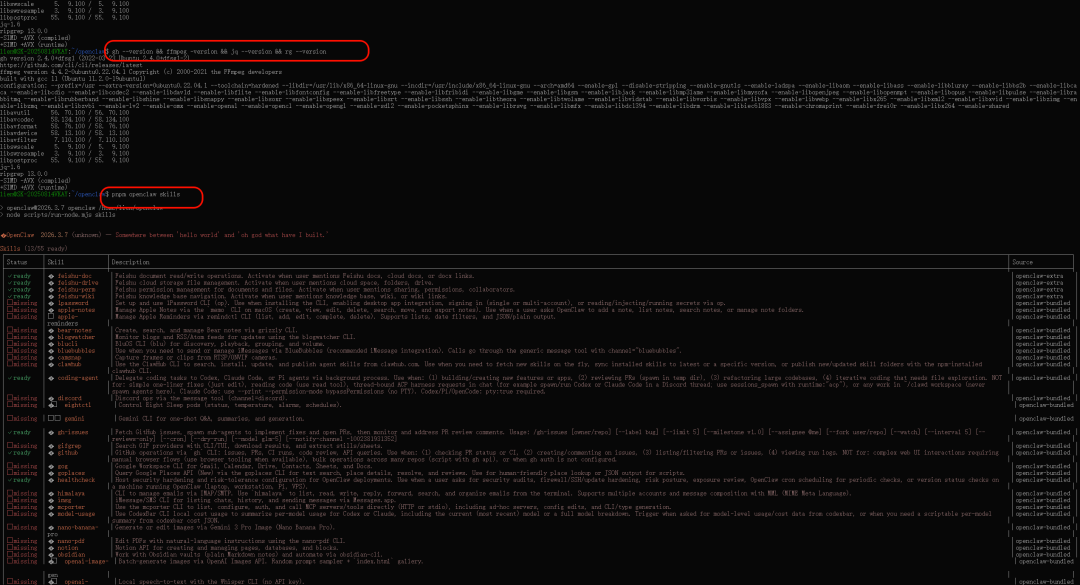

装完立刻验证

执行:

gh --versionffmpeg -versionjq --versionrg --versioncurl--version

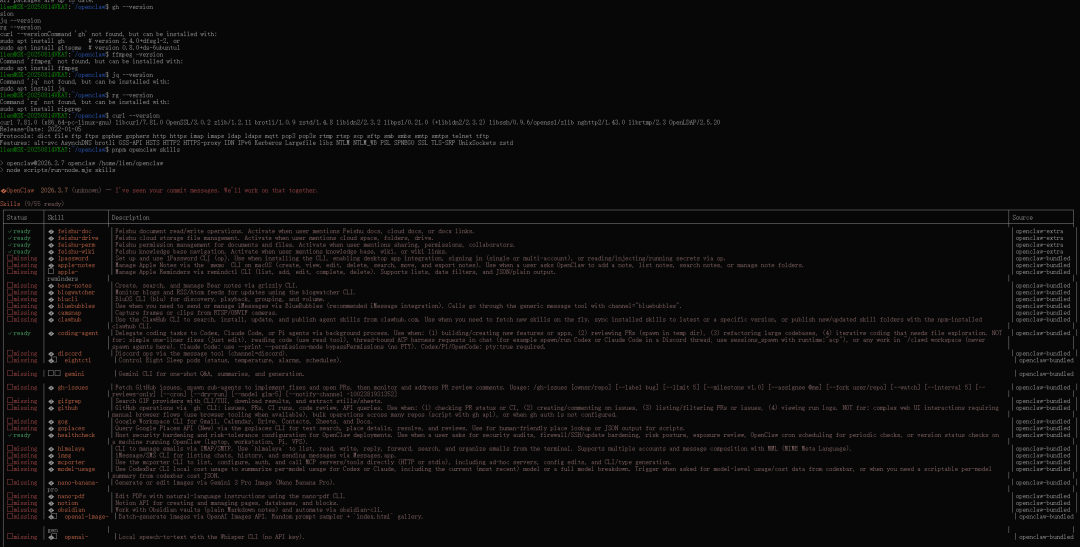

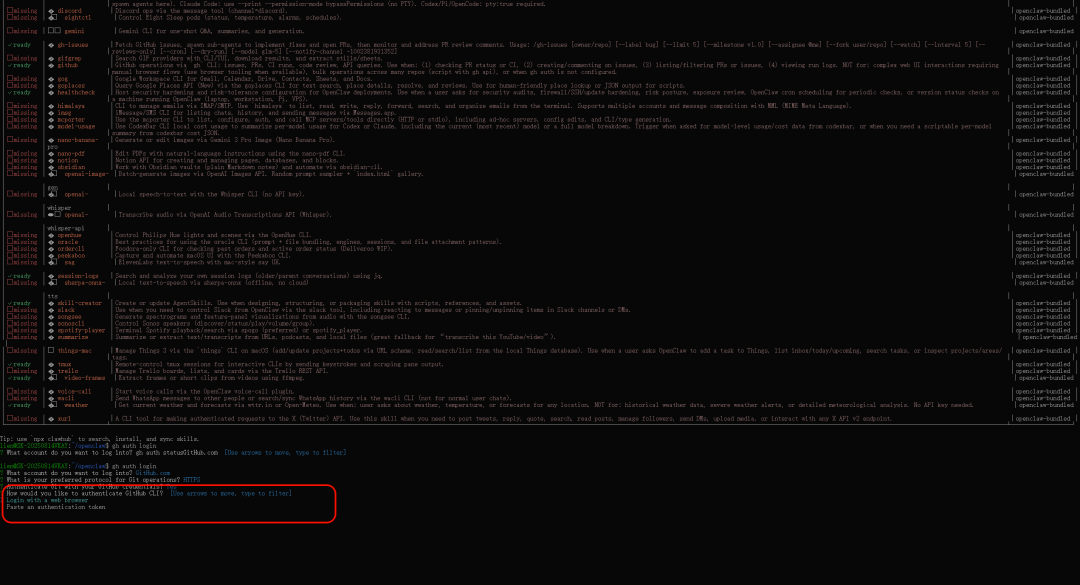

然后重新看 skills 状态

回到项目目录执行:

cd ~/openclawpnpm openclaw skills

重点看:

-

github -

gh-issues -

gitgrep -

video-frames

有没有从 missing 变成 ready。

这次并没有真正安装gh / ffmpeg / jq / ripgrep,只是又检查了一遍版本,所以 skills 还是停留在:

Skills (9/55 ready)

也就是说,目前还是这几个最有用:

-

feishu-doc -

feishu-drive -

feishu-perm -

feishu-wiki -

coding-agent -

healthcheck -

skill-creator -

tmux -

weather

这套已经够做:

-

飞书聊天助手

-

飞书文档 / 云盘 / wiki 辅助

-

基础代码生成

-

基础环境检查

-

天气查询

在 Ubuntu 里直接执行这条:

sudo apt update && sudo apt install -y gh ffmpeg jq ripgrep

执行之后查看

然后执行

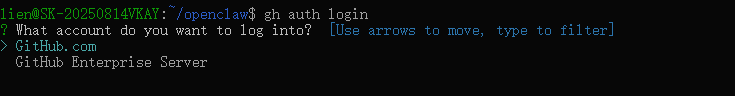

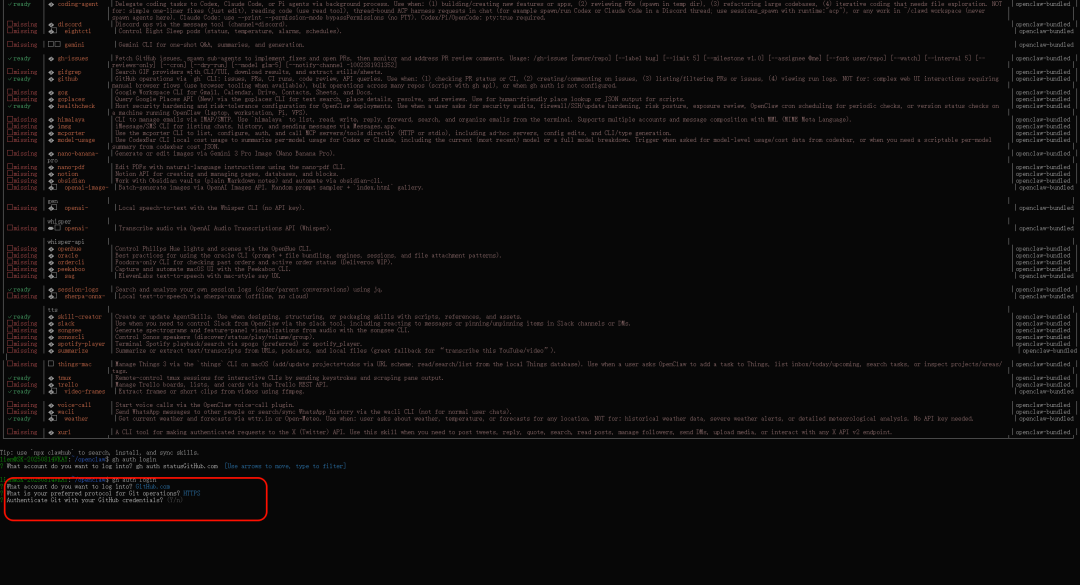

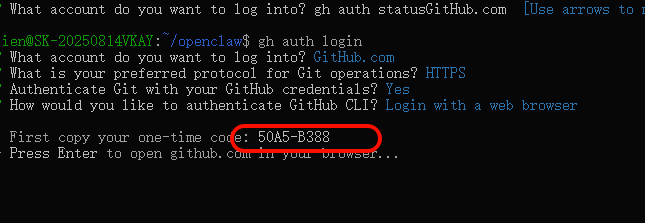

gh auth login

-

选 GitHub.com

-

然后按

Enter

后面再选:

-

HTTPS

-

Login with a web browser

授权完成后,终端会自动继续。

-

先记下这个验证码

50A5-B388 (这是我的,看自己的)

-

在当前终端里按 Enter

-

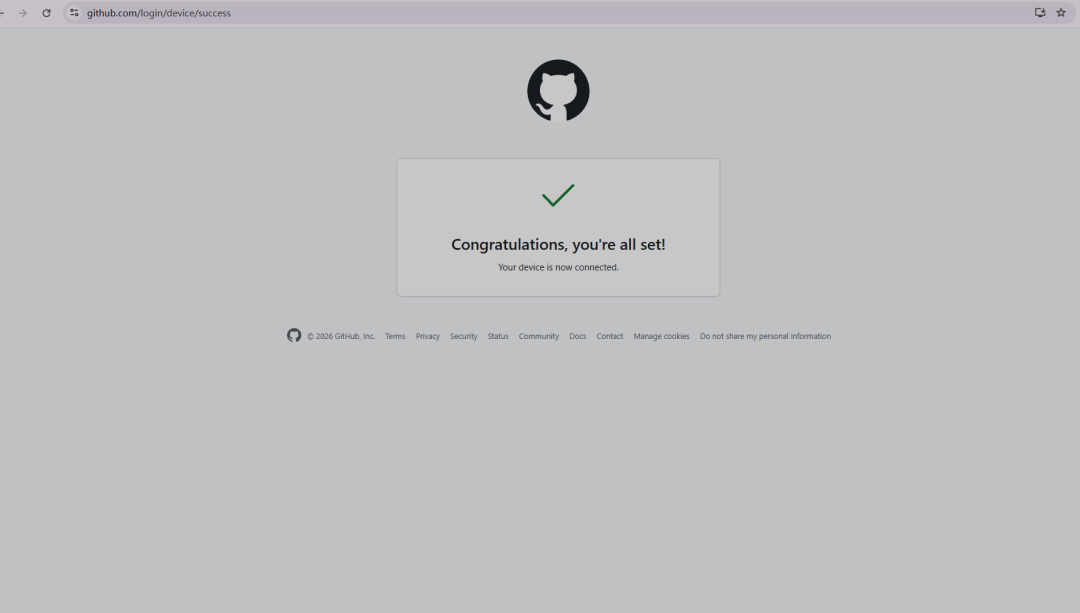

如果浏览器没自动打开,就手动在 Windows 浏览器 打开 GitHub 设备登录页面一般会跳到 GitHub 的 device login / activate 页面

-

登录你的 GitHub 账号

-

输入这串验证码:

50A5-B388

-

点授权 / 继续

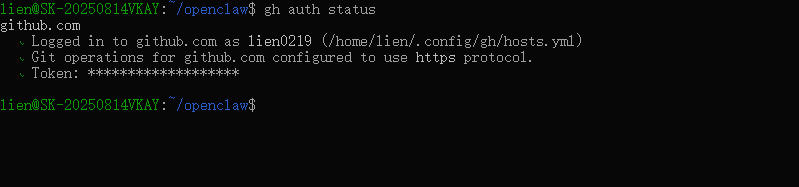

-

gh auth status

直接这样:

gh repo view 仓库名gh issue list --repo 仓库名

比如:

gh repo view openclawgh issue list --repo openclaw

把 openclaw 换成你自己的真实仓库,这样就可以帮你写代码提交代码修改代码了

其他skills

1. summarize

这个很实用,适合:

-

总结网页

-

总结本地文件

-

提取长文本内容

-

作为“发我一个链接/文档,你帮我概括”能力

这个优先级很高。

2. openai-whisper 或 openai-whisper-api

如果后面想做:

-

语音转文字

-

音频转录

-

视频字幕提取

那这组值得补。本地优先考虑 openai-whisper,云端就 openai-whisper-api

3. notion

如果你平时用 Notion 记笔记/做项目管理,这个很值。

4. slack

如果你后面还要接团队协作,Slack 值得补

反正skills根据自己需求补也很简单,其他的skills安装就不演示了

至此结束,安装以及使用问题都可以评论或私信询问,如果有帮助你还请点赞支持

更多推荐

已为社区贡献2条内容

已为社区贡献2条内容

所有评论(0)