openclaw + ollama(本地)本地搭建与问题解决

保存并退出(按 Ctrl+O 保存,enter 确认,Ctrl+X 退出 nano 编辑器)自定义安装得要node22+,apt默认安装是20的,建议先安装nvm在指定安装node。#配置文件位于 ~/.openclaw/openclaw.json,改这个文件。llama3.1-8b-32k是我自定义上下文的模型,可根据自己的更改。使用url访问,openclaw.json中找token。内存16

·

openclaw + ollama(本地)本地搭建与问题解决

配置

物理机:

Windows 11 专业版

32.0 GB ,处理器 AMD Ryzen 9 7845HX ,NVIDIA GeForce RTX 4060

虚拟机:

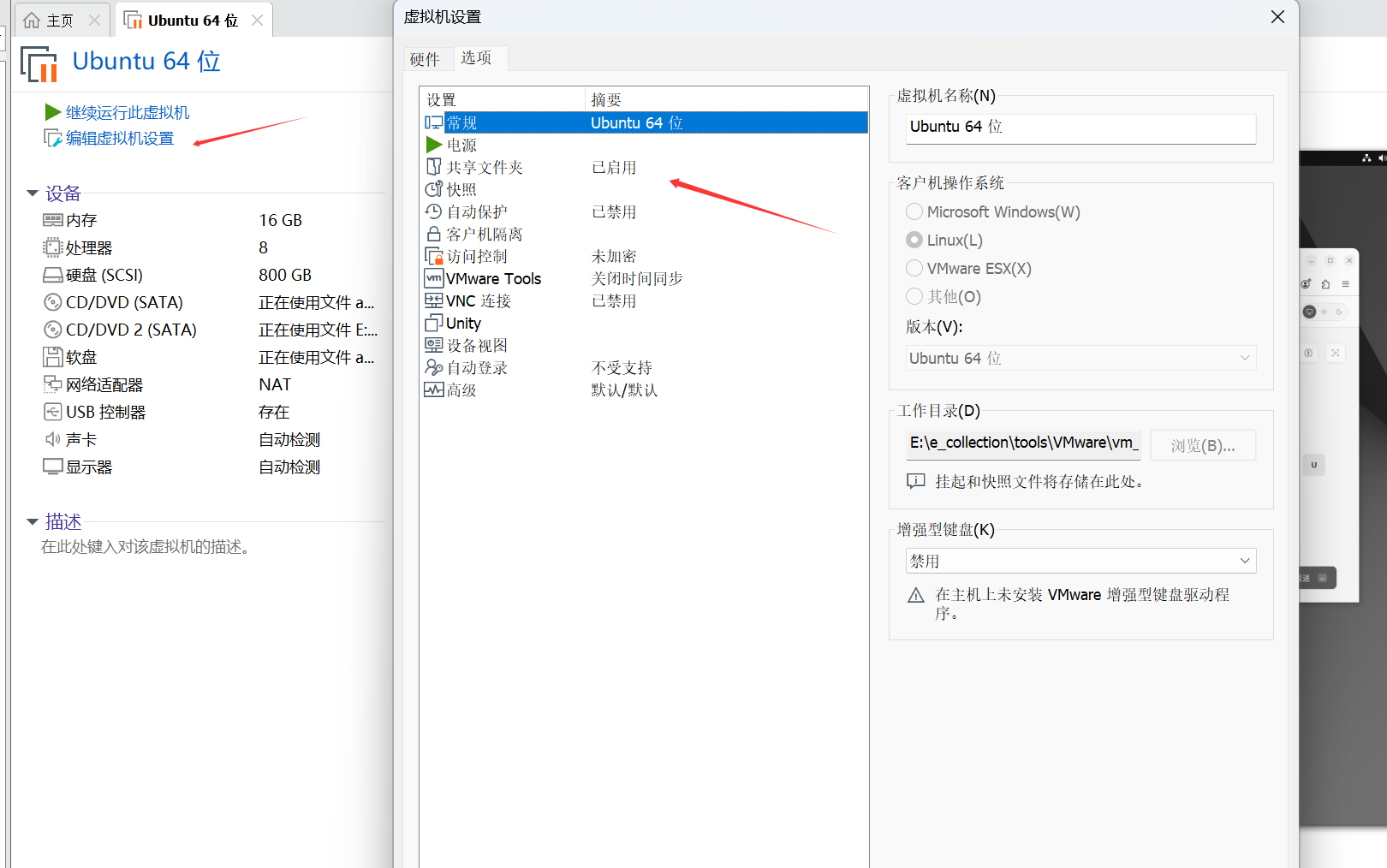

内存16g,处理器8内核1,硬盘80,net网络

还是要吐槽一下,一定要更新文档啊,全是错的,国内的教程也是纯过场,啥都没有

openclaw安装

#可以根据这个文档安装,但具体配置别看,都不更新的,浪费我两天时间

https://clawd.org.cn/start/getting-started

#直接用这个就行,傻瓜式,国内网也可以

macOS/Linux:

curl -fsSL https://clawd.org.cn/install.sh | bash

Windows (PowerShell):

iwr -useb https://clawd.org.cn/install.ps1 | iex注意:

自定义安装得要node22+,apt默认安装是20的,建议先安装nvm在指定安装node

# 使用 curl 安装

curl -o- https://raw.githubusercontent.com/nvm-sh/nvm/v0.39.7/install.sh | bash

#加载 nvm 环境变量(无需重启终端)

#直接在当前终端执行以下代码即可

export NVM_DIR="$HOME/.nvm"

[ -s "$NVM_DIR/nvm.sh" ] && \. "$NVM_DIR/nvm.sh" # 加载 nvm 核心功能

[ -s "$NVM_DIR/bash_completion" ] && \. "$NVM_DIR/bash_completion" # 加载命令补全

# 安装 Node.js 22 最新稳定版(以 22.2.0 为例,可替换为最新版本)

nvm install 22.2.0

# 安装最新 LTS 版本的 Node.js

nvm install --lts

openclaw自定义默认配置

openclaw-cn onboard --install-daemon

无法启动网关,自己手动前台启动

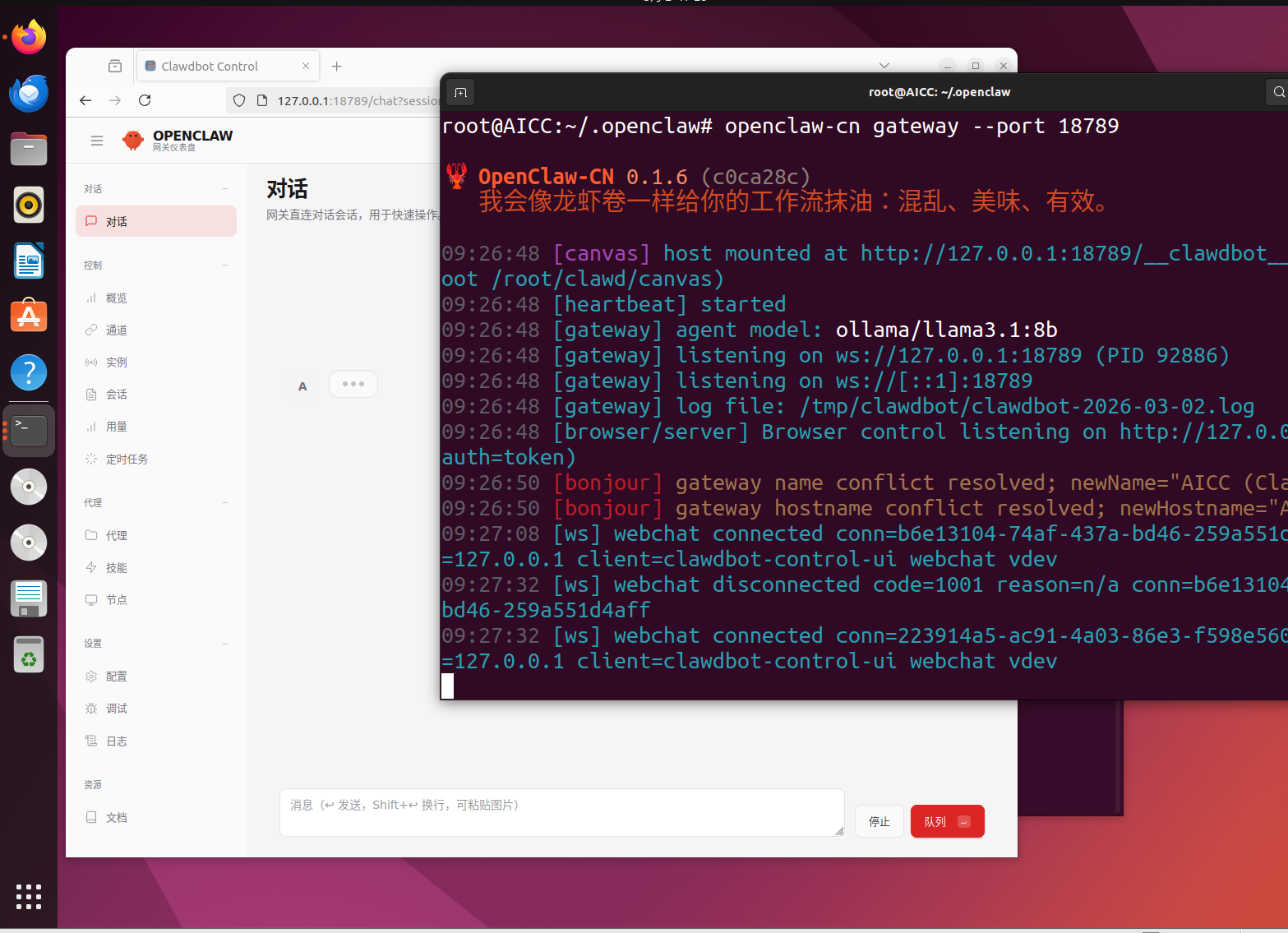

openclaw-cn gateway --port 18789ollama安装

#在这个网站直接下,或者用命令行下

https://ollama.com/download我ubuntu下载失败,访问不了

直接载github上下载ollama-linux-amd64.tar.zst

https://github.com/ollama/ollama/releases

vm共享文件夹

# 创建挂载点

sudo mkdir -p /mnt/hgfs

# 挂载所有共享(.host:/ 表示全部)

sudo vmhgfs-fuse .host:/ /mnt/hgfs -o allow_other

移到自己想放的位置

/opt/ollama

改权限

sudo chmod +x ollama

ollama模型

#OpenClaw支持的模型

https://www.open-clawai.com/zh/models

#可以根据这个下载,但别看配置全是错的

https://www.open-clawai.com/zh/models/ollama

ollama pull llama3.1:8bopenclaw + ollama(本地)结合

#配置文件位于 ~/.openclaw/openclaw.json,改这个文件

llama3.1-8b-32k是我自定义上下文的模型,可根据自己的更改openclaw.json直接删除重新创建

nano openclaw.json 粘贴进去

保存并退出(按 Ctrl+O 保存,enter 确认,Ctrl+X 退出 nano 编辑器)

{

"wizard": {

"lastRunAt": "2026-03-02T08:33:14.354Z",

"lastRunVersion": "0.1.6",

"lastRunCommand": "onboard",

"lastRunMode": "local"

},

"env": {

"OLLAMA_API_KEY": "ollama-local"

},

"models": {

"providers": {

"ollama": {

"baseUrl": "http://localhost:11434/v1",

"apiKey": "ollama-local",

"api": "openai-completions",

"models": [

{

"id": "llama3.1-8b-32k",

"name": "Llama 3.1 8B 32K context",

"reasoning": false,

"input": ["text"],

"cost": {

"input": 0,

"output": 0,

"cacheRead": 0,

"cacheWrite": 0

},

"contextWindow": 32768,

"maxTokens": 32768

}

]

}

}

},

"agents": {

"defaults": {

"model": {

"primary": "ollama/llama3.1-8b-32k"

},

"models": {

"ollama/llama3.1-8b-32k": {}

},

"workspace": "/root/clawd",

"compaction": {

"mode": "safeguard"

},

"thinkingDefault": "off",

"maxConcurrent": 4,

"subagents": {

"maxConcurrent": 8

}

}

},

"gateway": {

"port": 18789,

"mode": "local",

"bind": "loopback",

"auth": {

"mode": "token",

"token": "e9cb4ab34321009eb4d1bd02f48247687ccbd9b59f4fc651"

},

"tailscale": {

"mode": "off",

"resetOnExit": false

}

},

"skills": {

"install": {

"nodeManager": "npm"

}

},

"meta": {

"lastTouchedVersion": "0.1.6",

"lastTouchedAt": "2026-03-02T08:33:14.361Z"

}

}运行

使用url访问,openclaw.json中找token

http://127.0.0.1:18789/?token=e9cb4ab34321009eb4d1bd02f48247687ccbd9b59f4fc651

我这里配置不行用不了,不过完成任务就行

美图

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)