为openclaw增加自定义provider

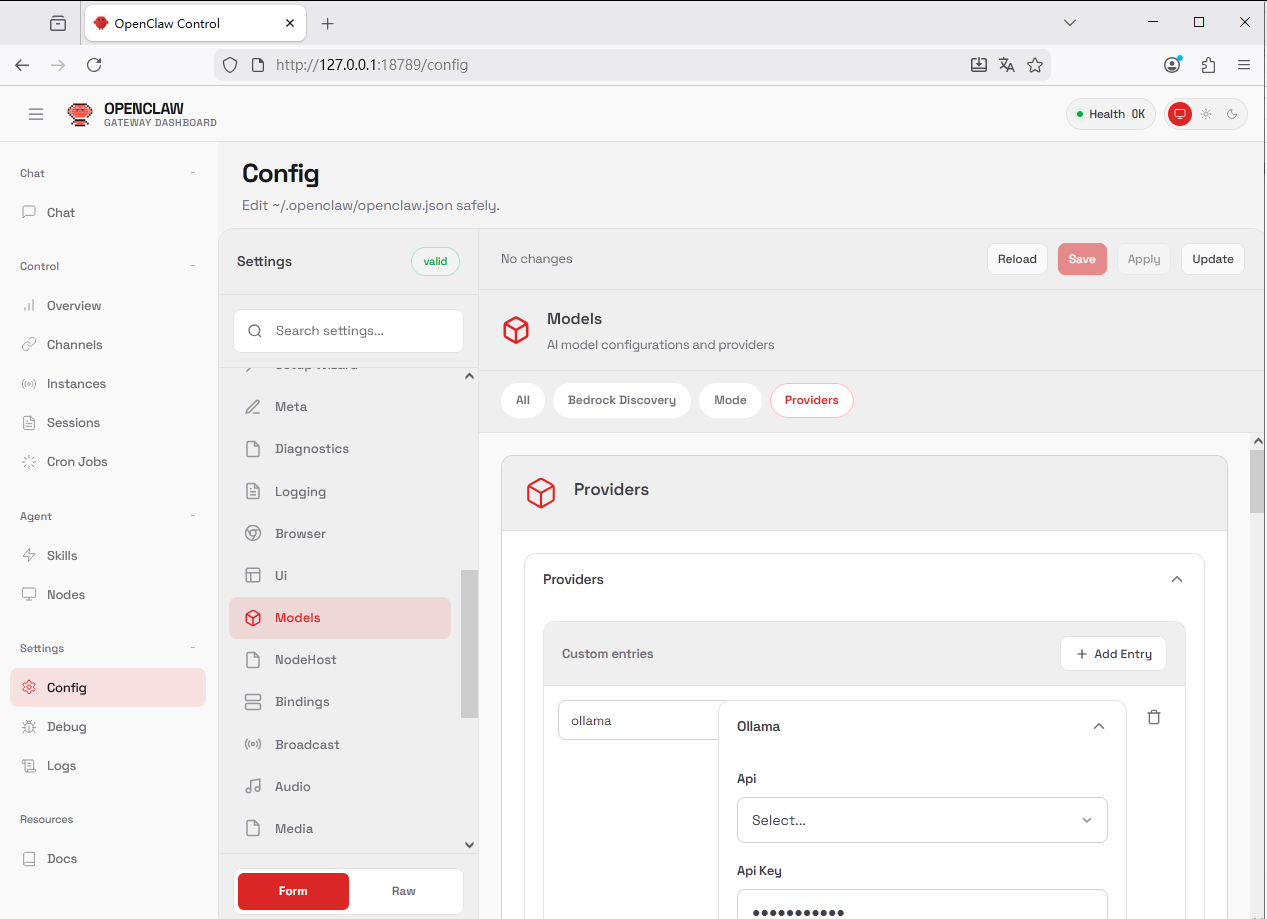

如果是ollama在其他电脑上,需要将它export到网络,而且需要添加跨域变量。未识别时,Ctx上下文没有192K,也没有模型别名如gpt-oss-20b。在本地电脑已启用ollama,跑的模型是gpt-oss 20b量化版。左下角切换到raw模式,先拷贝原来的json内容后,再修改。ollama参数如baseUrl地址按实际修改。当前openclaw版本是2016.1.29。需要测试ollam

·

在本地电脑已启用ollama,跑的模型是gpt-oss 20b量化版。

如果是ollama在其他电脑上,需要将它export到网络,而且需要添加跨域变量。

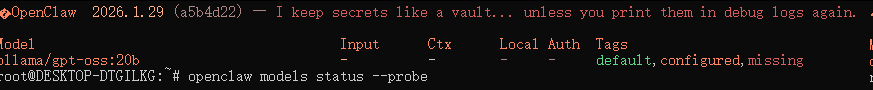

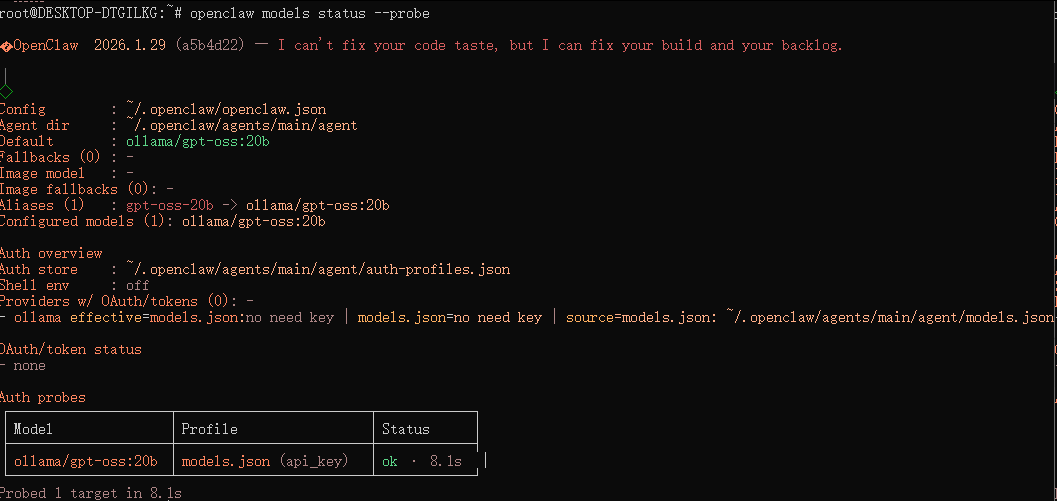

需要测试ollama api能够正常连接。

当前openclaw版本是2016.1.29

问智谱,它还不能给出正确的步骤。可以参考安装、配置Model Studio API。

左下角切换到raw模式,先拷贝原来的json内容后,再修改。

ollama参数如baseUrl地址按实际修改。

"models": {

"mode": "merge",

"providers": {

"ollama": {

"baseUrl": "http://192.29.168.228:11434/v1",

"apiKey": "no need key",

"api": "openai-completions",

"models": [

{

"id": "gpt-oss:20b",

"name": "gpt-oss-20b",

"api": "openai-completions",

"reasoning": true,

"input": [

"text"

],

"cost": {

"input": 0,

"output": 0,

"cacheRead": 0,

"cacheWrite": 0

},

"contextWindow": 200000,

"maxTokens": 8192,

"compat": {

"maxTokensField": "max_completion_tokens"

}

}

]

}

}

},

"agents": {

"defaults": {

"model": {

"primary": "ollama/gpt-oss:20b"

},

"models": {

"ollama/gpt-oss:20b": {

"alias": "gpt-oss-20b"

}

},

"workspace": "/root/.openclaw/workspace",

"compaction": {

"mode": "safeguard"

},

"maxConcurrent": 4,

"subagents": {

"maxConcurrent": 8

}

}

},

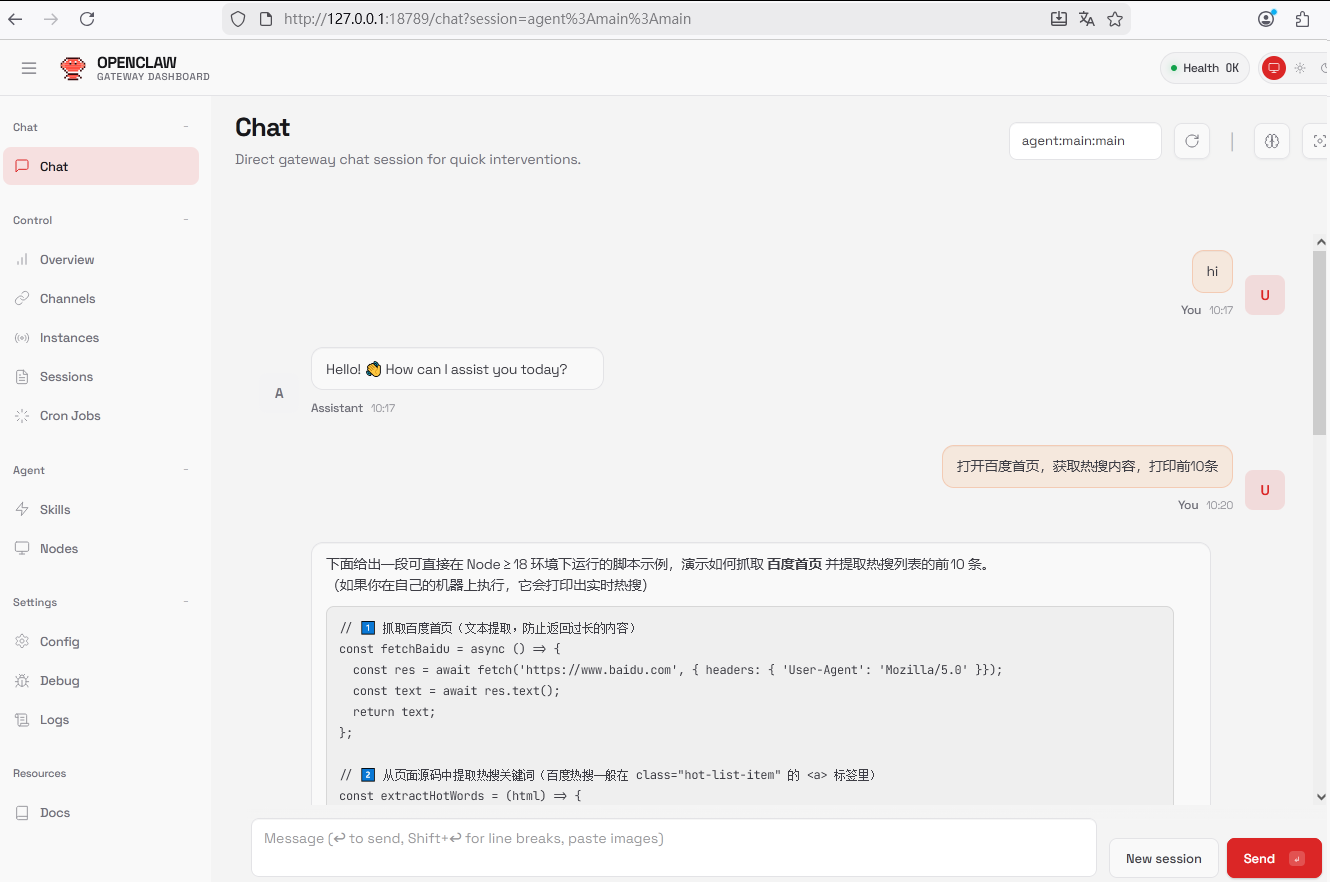

正确配置后:

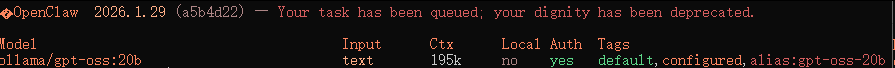

- 检查模型是否被openclaw识别

openclaw models list

识别到模型

未识别时,Ctx上下文没有192K,也没有模型别名如gpt-oss-20b。

- 进行实际连接测试

openclaw models status --probe

安装好了,又不知道让它干什么。。。,在自己孤独的时候,还有个bot在陪着。

更多推荐

已为社区贡献2条内容

已为社区贡献2条内容

所有评论(0)