Ollama 只安装 Ollama,本地快速部署谷歌开源大模型Gemma(基于Ollama)

运行curl -fsSL https://ollama.com/install.sh | sh。浏览器打开http://localhost:3000。需要先下载Ollama,版本要求0.1.26及以上。

·

参考:本地快速部署谷歌开源大模型Gemma(基于Ollama) - 知乎

确保系统更新:

Bash

sudo apt update && sudo apt upgrade

需要先下载Ollama,版本要求0.1.26及以上

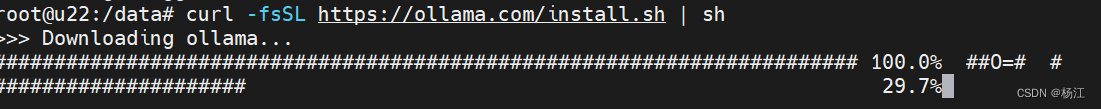

运行curl -fsSL https://ollama.com/install.sh | sh

监听 Ollama API 接口 11434端口

netstat -an|grep tcp|grep LIS

在127.0.0.1:11434

ollama run gemma:2b

ollama run gemma:2b

提问:

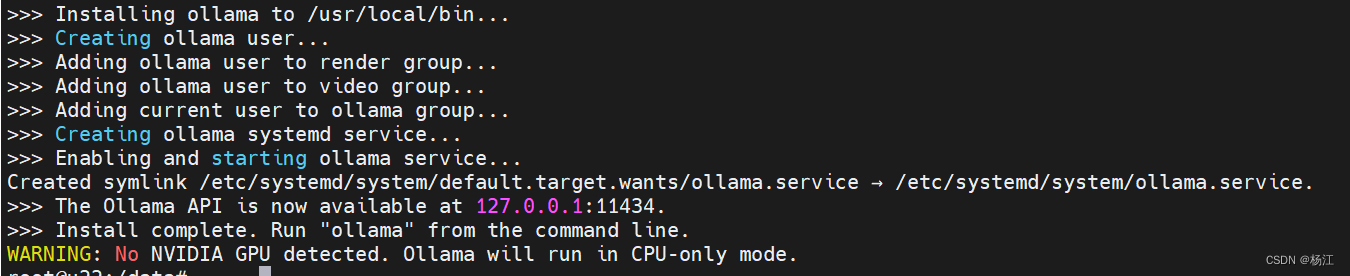

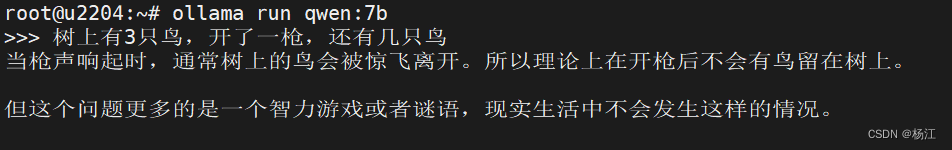

树上有3只鸟,开了一枪,还有几只鸟

没有GPU的情况下,14B的模型,每秒大概推理两个汉字了,时间效率上没法用

其他模型:

gemma:2b 1.7GB

qwen: 2.5GB 速度快

qwen:7b 4.5GB 速度凑合

qwen:14b 8.2GB 跑不动 很慢

https://ollama.ai/library/qwen/tags

更多推荐

已为社区贡献4条内容

已为社区贡献4条内容

所有评论(0)