通过ollama在本地部署大模型

在网站上下载并且安装好ollama。我这里是linux系统,指令很简单,在终端上输入安装好之后,可以查看ollama版本验证安装。在一个终端输入新开一个终端输入即可查看ollama版本。

·

下载ollama

在ollama网站上下载并且安装好ollama。我这里是linux系统,指令很简单,在终端上输入

curl -fsSL https://ollama.com/install.sh | sh安装好之后,可以查看ollama版本验证安装。在一个终端输入

ollama serve新开一个终端输入

ollama --version

即可查看ollama版本。

部署模型

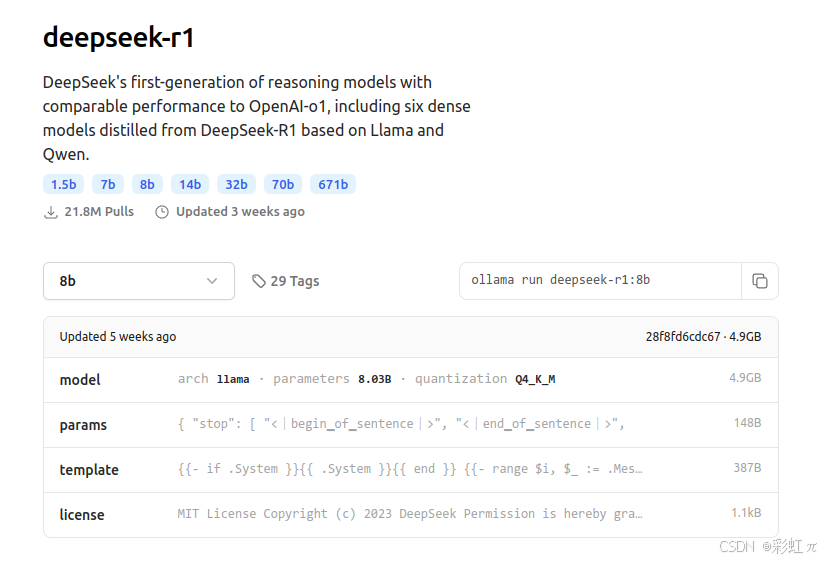

我自己显卡只有8G的显存,所以选择了Deepseekr1-8b的模型。如果大家有大显存的显卡可以部署更大参数的模型。

同样,首先运行ollama serve,新开一个终端输入指令。

ollama run deepseek-r1:8b

这里我预先装好了,想要退出的话,按住Ctrl+d就行了。

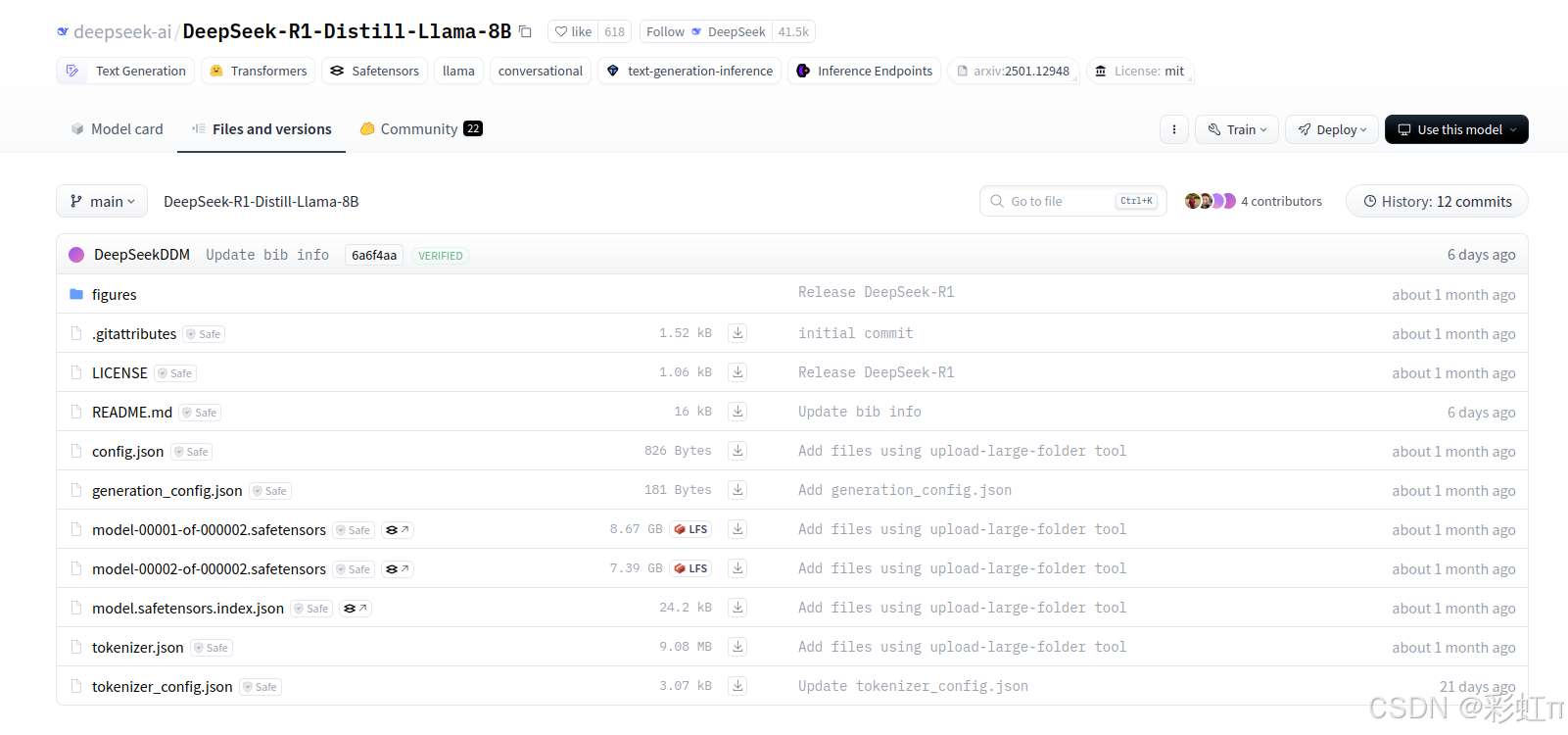

这样就通过ollama部署了大模型,不过这个8b的模型只占据5GB的空间,我觉得这是给它量化了,在Hugging Face的官网上,Deepseekr1-8b的模型有16GB。

在下一篇,我将分享如何部署自己的大模型,通过微调的,还有这个原本的8b模型。

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)