ollama 对于离线模型的支持可以是GGUF format 的(通过modelfile 进行构建),实际上还有一种就是对于下载好的模型直接

进行打包,然后通过配置进行加载(OLLAMA_MODELS 环境变量)

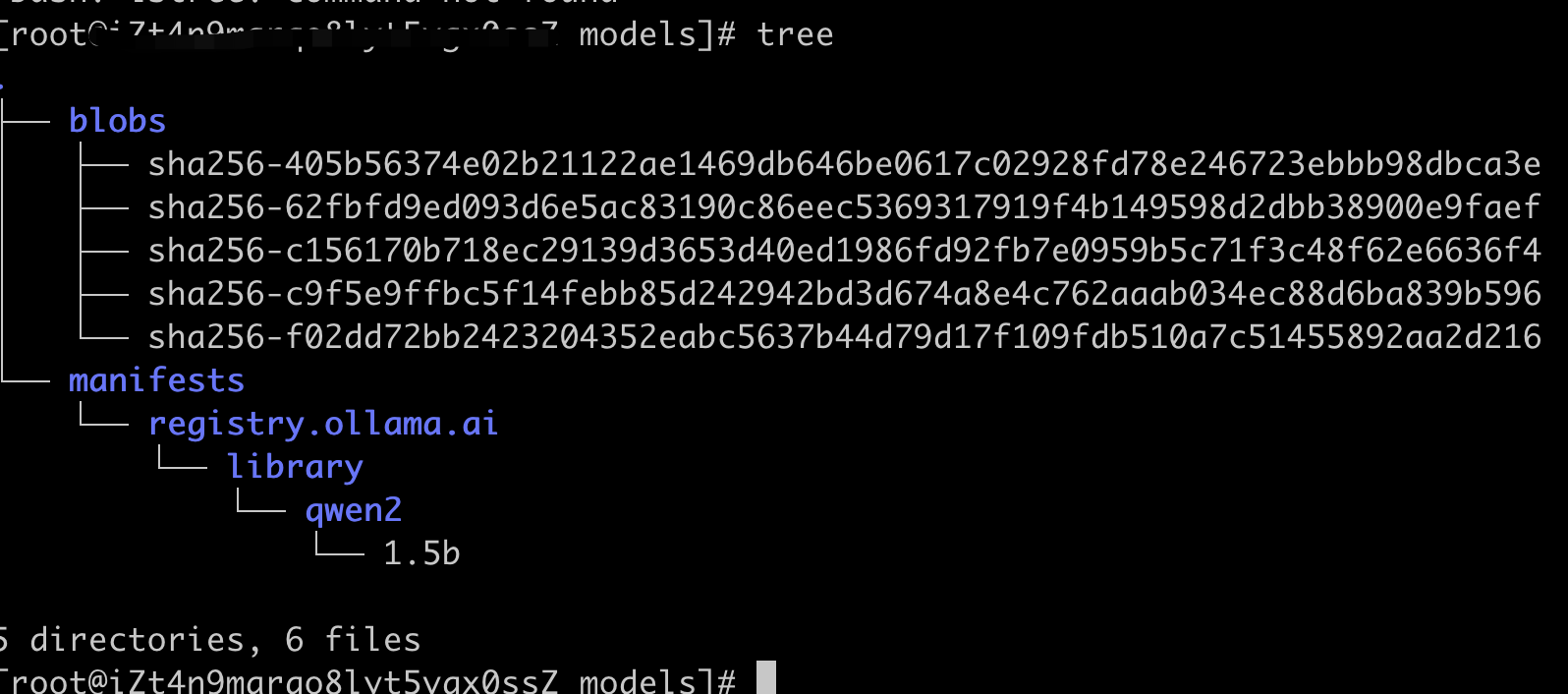

下载的模型数据

- 模型数据结构

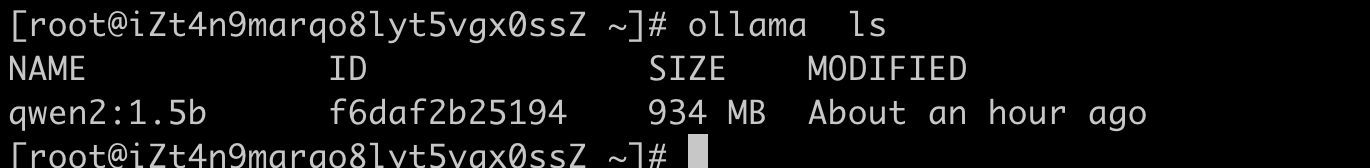

- 通过直接复制加载的模型

参考服务配置

- systemd 服务配置

注意对于OLLAMA_MODELS 定义的文件夹的权限的配置

参考资料

https://github.com/ollama/ollama/blob/main/docs/import.md

https://github.com/ollama/ollama/blob/main/docs/modelfile.md

https://github.com/ggerganov/llama.cpp/blob/master/README.md#prepare-and-quantize

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)