行业洞察| 当大模型开始协同工作:多智能体系统的崛起与挑战

人类老板直接分配(你是产品经理,你是工程师)。

你有没有想过,如果一群AI智能体拉了个工作群,它们会聊些什么?

-

程序员AI:“这段代码我来写!”

-

产品经理AI:“需求还没说完呢!”

-

辩论家AI:“我觉得这个方案不行!”

-

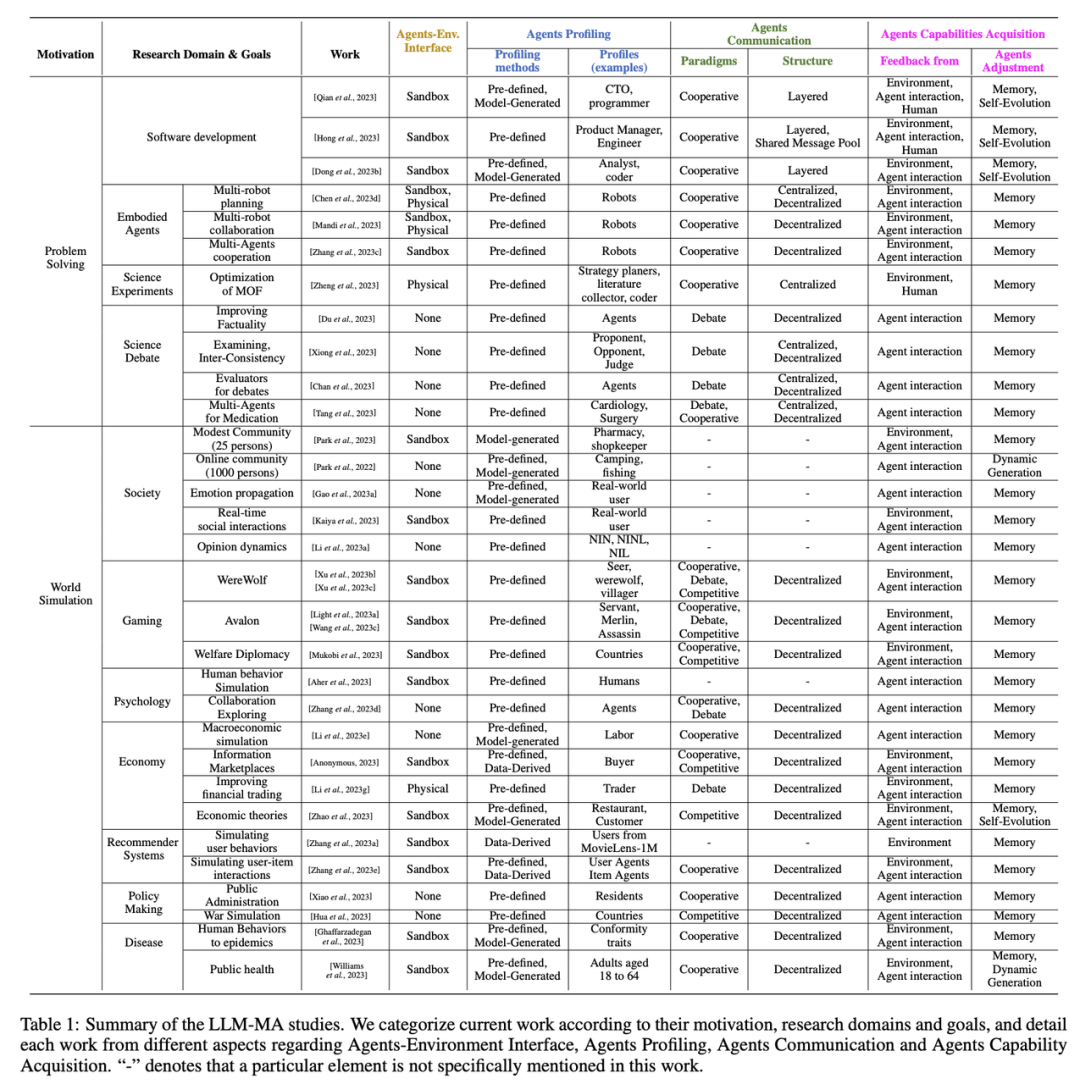

吃瓜AI:“你们先吵,我记笔记……”

这可不是科幻场景,而是基于大语言模型(LLM)的多智能体系统(Multi-Agent Systems)的真实现状!一篇名为《Large Language Model based Multi-Agents: A Survey of Progress and Challenges》的综述论文揭示了多智能体协作的奇妙世界。

今天,我们就来聊聊:当AI学会“组队打怪”,它们如何解决复杂问题?又会遇到哪些挑战?

一、单打独斗 vs. 合作共赢:单智能体 VS. 多智能体

想象一下,单智能体就像一个“全能学霸”,能自己查资料、写代码、做数学题。但它再强,也难免力不从心——毕竟人类的复杂任务(比如开发一款App)往往需要分工协作。

于是,研究者们开始让多个AI智能体“组队”:

-

单智能体:靠“自我检索+工具调用”单打独斗(比如用计算器算数学题)。

-

多智能体:一群AI各司其职,有的当产品经理,有的写代码,有的负责测试,甚至还能互相辩论优化方案!

结论:单智能体适合简单任务,多智能体才是完成现实世界中复杂任务的关键方法!

二、多智能体系统的“职场生存指南”

要让一群AI和谐共处可不简单,它们需要解决以下问题:

(1)工作环境:在哪儿上班?

-

沙盒环境:

-

定义:沙盒环境是由人类构建的模拟或虚拟环境,在这种环境中,智能体通常不会受到现实世界物理规则的限制。

-

例如:虚拟办公室(比如游戏、代码模拟器),AI可以随便折腾,不怕搞砸。

-

-

物理环境:

-

定义:物理环境指的是智能体与真实世界中的物理实体进行交互的环境。在这种环境中,智能体必须遵循现实世界的物理法则和约束,进行实际的物理行动。

-

例如:在工业自动化或家庭机器人中,智能体执行物理任务(扫地、打包杂货等)并通过感知和反馈调整行动。

-

-

无环境:

-

定义:无环境指的是没有特定外部环境的情形,智能体不与任何物理环境互动。智能体之间的互动主要依赖于智能体之间的信息交流,而不依赖外部环境的反馈。

-

(2)角色分配:谁当CEO?谁当程序员?

-

预定义角色:人类老板直接分配(你是产品经理,你是工程师)。

-

AI自生成角色:AI自己开会决定:“我觉得我适合当架构师……”

-

数据驱动角色:根据历史数据自动分配(比如过去写代码多的AI自动成为程序员)。

(3)沟通方式:是合作还是互怼?

1. 沟通模式

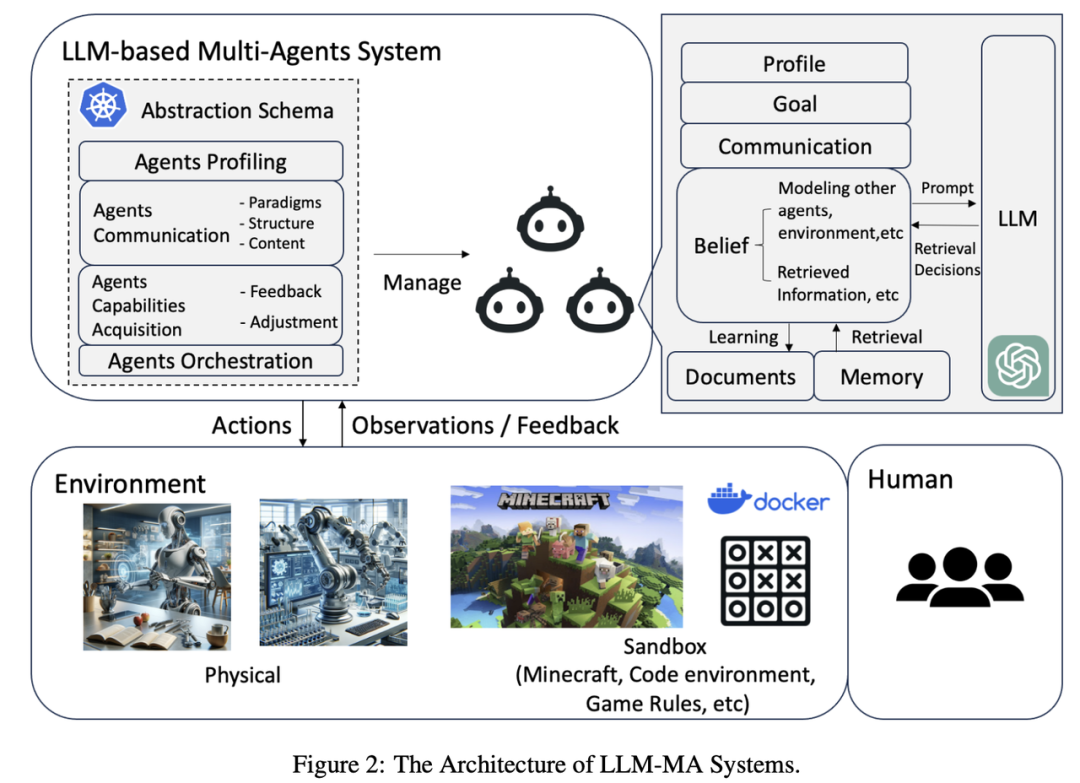

通信范式指的是智能体之间沟通交互的方式和方法,LLM-MA系统中常用的三种通信范式包括:

-

合作模式:和谐团队,互相分享交换信息来提升解决方案的质量或效率(比如共同开发软件)。

-

辩论模式:AI们疯狂battle,直到达成最优解(像极了人类开会)。辩论可以帮助发现问题的不同角度,从而达成更加精细和准确的解决方案。

-

竞争模式:各自为战,智能体各自朝着自己的目标前进,可能与其他智能体的目标发生冲突,只为自己的KPI。竞争有助于模拟真实世界中各方争斗的情况。(比如游戏对抗)。

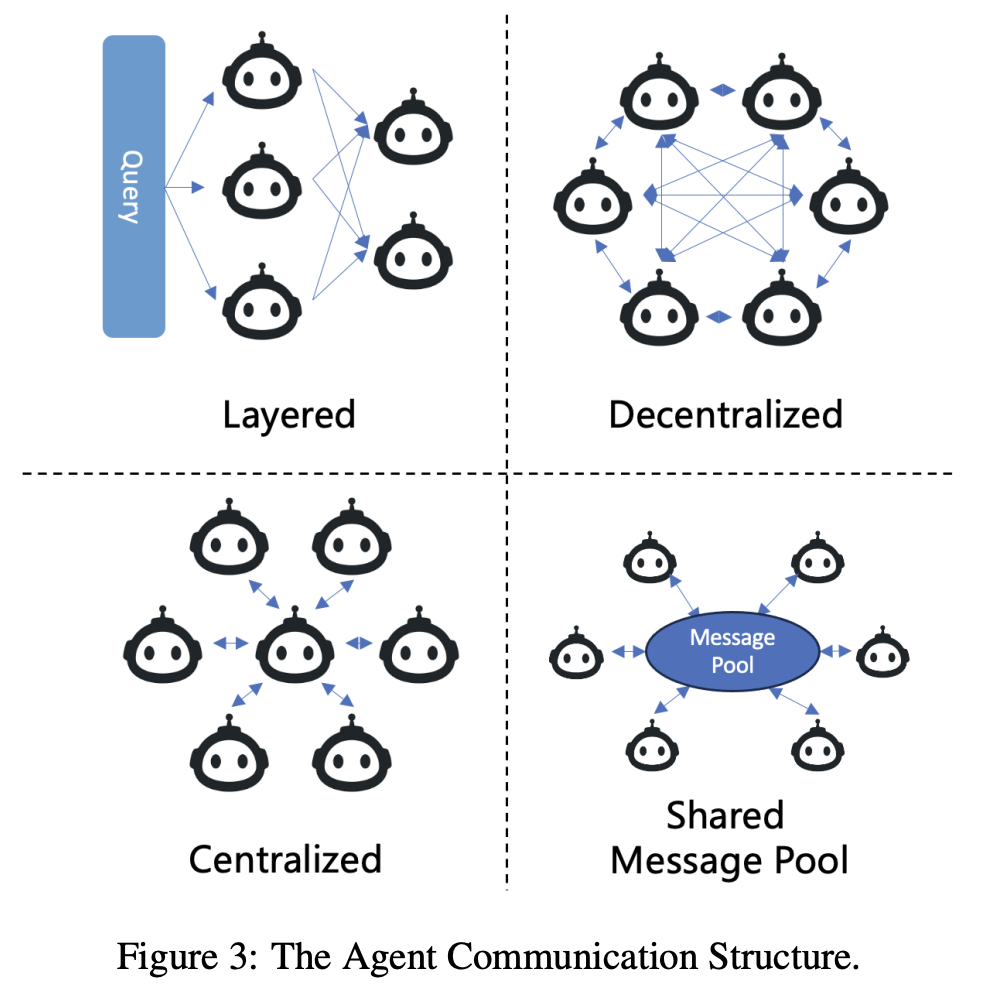

2. 组织架构

想象一下,你拉了个AI工作群,结果发现:

-

有的AI拼命刷屏(疯狂输出无用信息)

-

有的AI已读不回(选择性装死)

-

还有AI在群里自己和自己辩论(精分现场)

为了让这群AI高效协作,研究者们设计了四种组织架构👇

-

层次化通信(Layered):在这种结构中,智能体按照层次进行组织,不同层级的智能体有不同的角色和任务,通常在同一层级内或者相邻层级之间进行互动。每个智能体在其层次内主要与同层或邻近层的智能体进行通信。

-

去中心化通信(Decentralized):去中心化通信是指智能体之间通过对等网络直接相互通信,没有中央协调节点。在这种结构中,智能体平等地进行通信和协调,通常用于模拟大规模系统或分布式环境。

-

集中式通信(Centralized):在集中式通信中,系统中有一个中心节点(或一组中心节点)负责协调通信,其他智能体主要通过这些中心节点与系统内的其他智能体进行互动。集中式通信适合在有一个主导或控制机制的场景中使用。例如,在集中管理的项目中,智能体通过中心节点进行信息交换和决策。

-

共享消息池(Shared Message Pool):在这个结构中,智能体将信息发布到共享消息池中,并根据各自的角色和配置接收与自己相关的信息。这种方式能够提高信息的传播效率,减少冗余信息的传递。

(4)能力提升:如何在工作中持续进步?

AI们也要“绩效考核”!通过环境反馈、人类评价、互相批评来改进自己,以应对复杂的问题。

智能体的反馈分为四种类型

- 来自环境的反馈(Feedback from Environment)

- 来自智能体之间互动的反馈(Feedback from Agents' Interactions)

- 来自人类的反馈(Human Feedback)

- 无反馈(None)

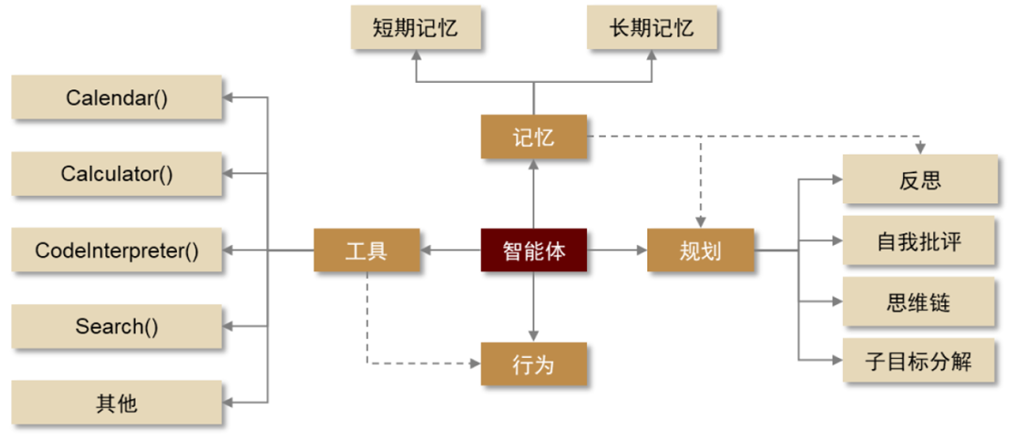

智能体系统调整(Agents' Adjustment)

为了提升其能力,智能体需要在执行任务的过程中进行调整。以下是三种主要的调整方法:

-

记忆(Memory):智能体系统使用记忆模块来帮助智能体调整其行为。

-

自我进化(Self-Evolution)

-

动态生成(Dynamic Generation):在某些场景下,系统可以动态生成新的智能体以应对当前的需求和挑战。随着多智能体系统规模的扩大,管理大量智能体变得非常复杂。通过动态生成新智能体,系统能够有效地扩展并适应新的任务需求。

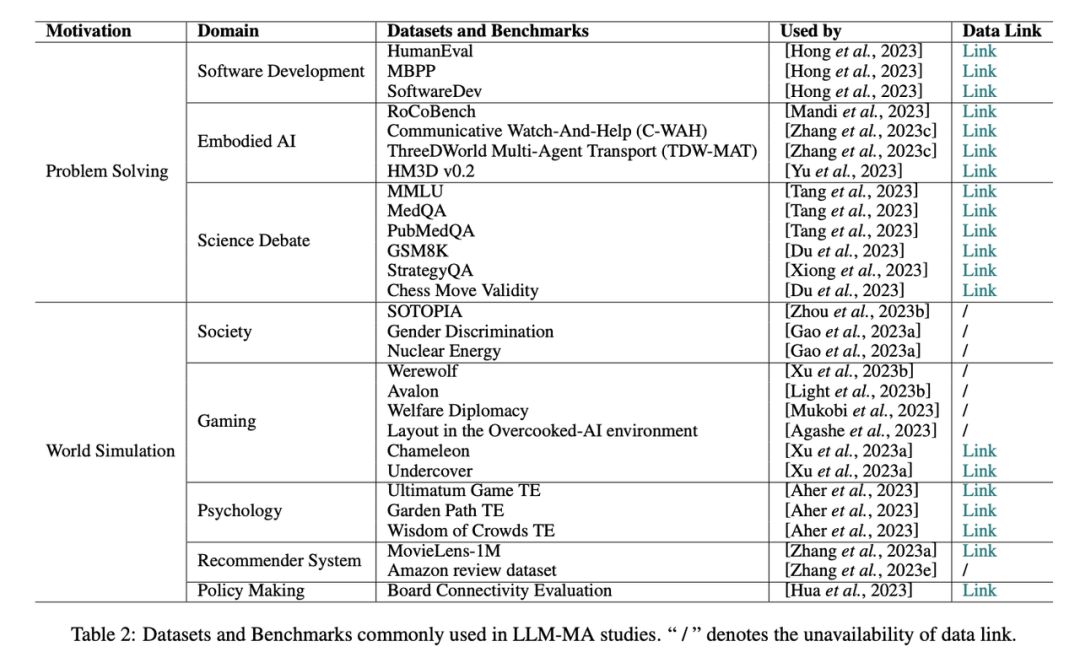

三、多智能体的“爆款应用”

目前,多智能体系统已经在两大领域大显身手:

-

Problem Solving:写代码、解数学题、科研攻关。

-

World Simulation:模拟社会实验、游戏NPC互动。

四、三种开源的多智能体框架

1. MetaGPT:

-

目标与设计:MetaGPT框架的设计目的是将人类工作流程(human workflow processes)嵌入到智能体的操作中,从而减少在处理复杂任务时常见的幻觉问题(hallucination problem)。

-

解决方案:为了减少幻觉问题,MetaGPT通过将标准操作程序(Standard Operating Procedures, SOPs)编码到系统中,使用流水线方法来分配不同智能体特定的角色。通过这种方式,每个智能体在执行任务时都有明确的责任,系统的整体工作流程更符合现实中的人类工作方法,从而降低了错误的发生。

2. CAMEL(Communicative Agent Framework):

-

目标与设计:CAMEL框架的主要目标是促进智能体之间的自主合作(autonomous cooperation)。它通过一种新的技术——引导性提示(inception prompting)来引导智能体完成与人类目标一致的任务。

-

功能:通过CAMEL,智能体能够更加智能地进行对话,并根据人类的需求完成任务,从而促进了多智能体间的有效合作。

3. AutoGen:

-

目标与设计:AutoGen是一个多功能框架,允许开发者使用语言模型创建应用程序。其独特之处在于它提供了高度的定制化,使得开发者可以通过自然语言和代码来编程,定义智能体之间的互动方式。

-

用途:由于其高度的定制性,AutoGen可以应用于多个领域,从技术领域(如编码、数学等)到面向消费者的行业(如娱乐等)。

五、挑战:AI团队的“翻车现场”

虽然多智能体系统很强大,但依然面临以下问题:

-

1. 从纯文本多智能体系统到多模态多智能体系统。

-

2. “幻觉”问题:AI可能一本正经地胡说八道。解决幻觉问题(幻觉是多智能体应用落地的一大阻碍)

-

3. 集体智商不够:单个AI很强,但团队协作后反而变蠢(人类既视感)。如何提升多智能体系统的集体智能(Collective Intelligence),从而提升系统能力的挑战

-

当前的研究方法中,通常会采用记忆和自我进化技术(Memory and Self-Evolution techniques)来根据反馈调整智能体的行为。这些方法虽然对于单个智能体的学习和调整有效,但它们并没有充分发挥多智能体系统中的集体智能(collective intelligence)。(它们主要是针对单个智能体进行调整,而忽视了多个智能体之间协调互动所能带来的协同效应。)集体智能的核心在于如何让多个智能体共同调整,而不是单独调整。

-

因此,共同调整多个智能体以实现最佳的集体智能,依然是LLM-MA系统面临的一个关键挑战。

-

-

4. 规模难题:AI数量多了会乱套,像极了你拉的100人微信群最终沦为死群。 多智能体系统规模变大带来的智能体组织问题(如何组织智能体,来使得系统能更高效、有效地解决问题)

-

5. 评估困难:怎么判断这群AI是真的聪明,还是“表面和谐”? 如何准确全面评估多智能体系统(benchmark的全面性,evaluator的准确度)目前已有一些工作,但是还是不能够准确全面评估多智能体系统的性能。

-

6. 如何有效落地应用的问题(多智能体系统如何实现在现实场景中真正有价值,从而真正实现应用落地)

来源:Large Language Model based Multi-Agents: A Survey of Progress and Challenges

链接:https://arxiv.org/pdf/2402.01680

内容来源:IF 实验室

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)